Опубликованный в прошлом месяце доклад специалистов пролил свет на новую методику отслеживания пользователей. Она основывается на использовании легитимного механизма, связанного с протоколом TLS (Transport Layer Security) — неотъемлемой частью современных HTTPS-соединений.

Техника получила название TLS Session Resumption (RFC 8447), этот механизм был создан в середине 2000-х годов, он позволяет серверам TLS запоминать прошлые сессии пользователя. Такой метод позволяет избежать лишней затраты ресурсов серверов.

Существует три способа поддержки серверами TLS Session Resumption. С помощью ID сессии, механизма билетов сессий (session tickets) и pre-shared ключей (pre-shared keys, PSKs).

Первые два совместимы со старым TLS 1.2, а вот третий был специально разработан для нового и более защищенного стандарта TLS 1.3. Во всех трех случаях у владельцев серверов есть возможность установить срок, в течение которого сервер помнит сессию пользователя.

Трое немецких специалистов из Гамбургского университета опубликовали исследование, согласно которому недобропорядочные рекламные компании могут задействовать механизм TLS Session Resumption для отслеживания пользователя во время веб-серфинга.

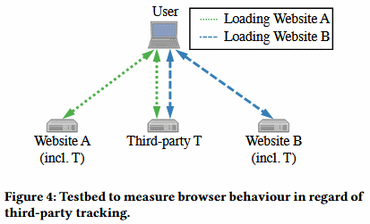

Концепт довольно прост — если рекламная компания загружает рекламу с помощью сервера TLS (HTTPS), то она может активировать TLS Session Resumption для этого сервера. После того как пользователь посетил условный сайт А, где располагалась реклама, установилось соответствующее соединение TLS.

Когда юзер посещает условный сайт Б, на котором находится реклама от той же компании, это соединение остается открытым, что позволяет отслеживать переходы пользователя по ресурсам.

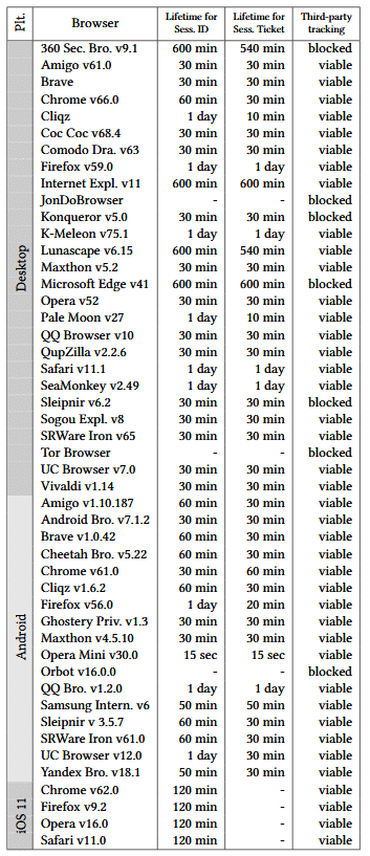

Эксперты провели исследование 45 десктопных и мобильных браузеров, в результате чего стало понятно — отслеживание работает в случае с 38 браузерами. Соответствующая табличка воздействия на браузеры также была опубликована исследователями:

С полным исследованием можно ознакомиться по этой ссылке (PDF).