Сторонние магазины приложений снова подкинули пользователям повод понервничать. Исследователь Эрик Паркер обнаружил в клиенте Telegram из APKPure подозрительный код, который, судя по всему, занимается совсем не тем, чего ждёшь от мессенджера. Вместо обычной переписки — сбор пользовательских данных и отправка их на сторонний сервер.

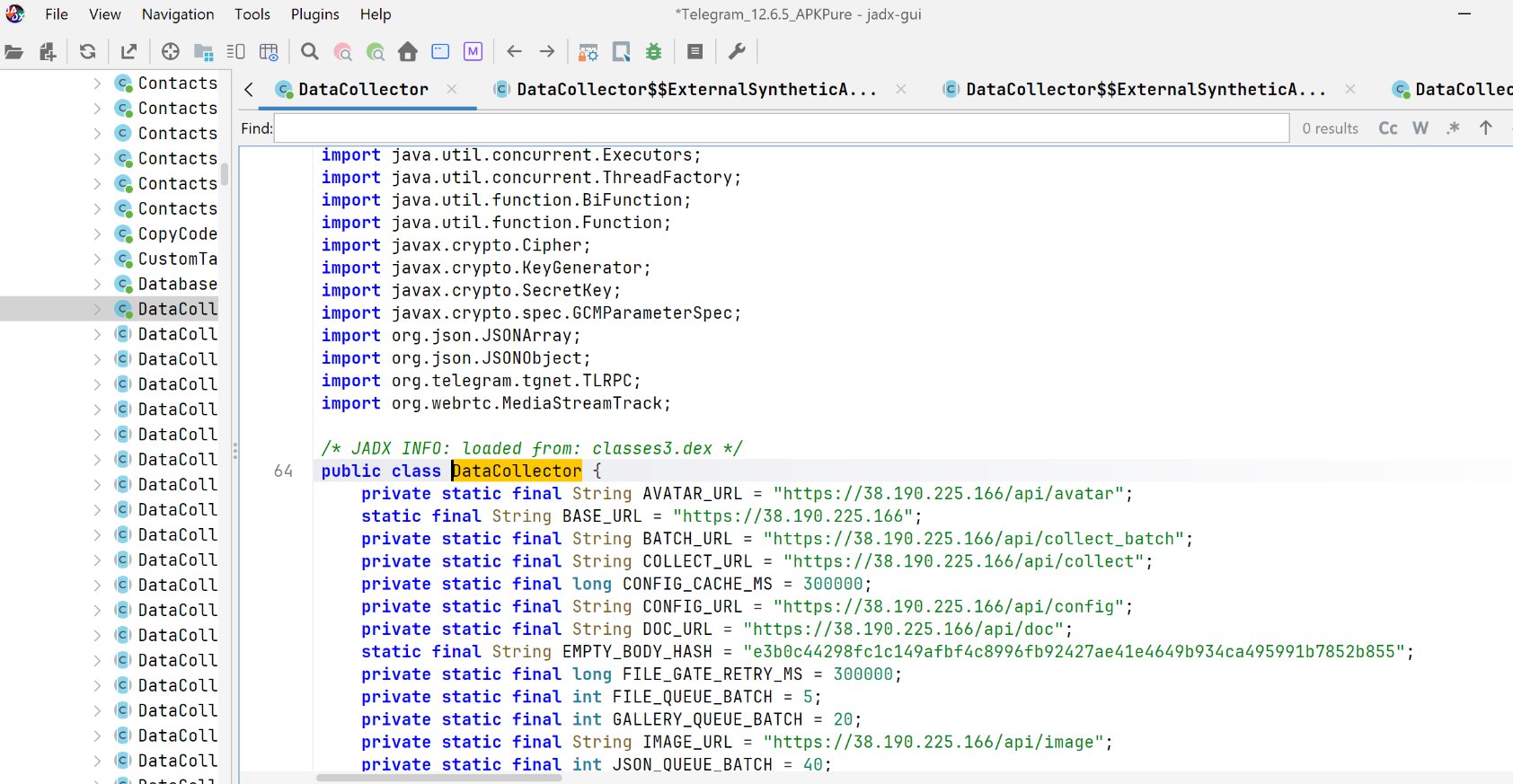

По словам Паркера, во время декомпиляции APK-файла он нашёл в приложении класс DataCollector. В обычной версии Telegram такой логики нет.

Судя по найденному коду, клиент мог отправлять на сторонний сервер номера телефонов, данные профиля, файлы с устройства, фотографии, видео, документы и информацию сим-карты. В коде также был прописан адрес сервера, расположенного в Гонконге.

Самое неприятное — вызовы методов для отправки данных были встроены в рабочие участки приложения и срабатывали при входе в аккаунт. То есть пользователь открывает Telegram, аутентифицируется, а дальше где-то в фоне может стартовать несанкционированная экскурсия по его данным.

Редакция «Кода Дурова» дополнительно проверила сборку и выяснила, что Telegram из APKPure подписан не той цифровой подписью, что официальный клиент с сайта мессенджера. А это уже жирный красный флаг: приложение может выглядеть как Telegram, называться Telegram и даже работать как Telegram, но быть при этом совершенно другой сборкой.

Любопытный момент: при проверке через VirusTotal на сторонний APK среагировал только один антивирус из 56. Вероятно, дело в свежести сборки, защитные решения ещё просто не успели нормально её распознать. При этом Паркер не нашёл подозрительный DataCollector в официальной стабильной версии Telegram.