Одни алгоритмы искусственного интеллекта атакуют, другие защищают, создавая невидимую арену противостояния, где системы соревнуются в скорости и хитрости. Рассмотрим, как именно инструменты ИИ ускоряют разведку и генерацию атак и одновременно усиливают механизмы обнаружения и блокировки.

- 1. Введение

- 2. Использование ИИ злоумышленниками

- 3. Искусственный интеллект в киберзащите

- 4. Риски внедрения ИИ в средства защиты информации

- 5. Противостояние ИИ против ИИ

- 6. Выводы

Введение

В прогнозах российских игроков рынка информационных технологий и информационной безопасности на 2026 год искусственный интеллект занял первые строки по частоте упоминаний.

Рисунок 1. Основные темы прогнозов на 2026 год: развитие киберугроз

Такая ситуация связана не только с активным внедрением технологий машинного обучения в цифровые сервисы, но и с их влиянием на развитие киберугроз и инструментов защиты.

Рисунок 2. Основные темы прогнозов на 2026 год: развитие средств защиты информации

Согласно исследованию ONSIDE при поддержке Just AI, в 2025 году объём российского рынка генеративного искусственного интеллекта увеличился более чем втрое по сравнению с 2024 годом: с 13 до 58 млрд руб. Такой рост отражает переход рынка от стадии экспериментов и пилотных проектов к масштабированию и промышленному внедрению технологий.

Рынок при этом остаётся далёким от насыщения. По оптимистичному сценарию уже в 2026 году его объём может увеличиться примерно в два раза, а к 2030 году приблизиться к 780 млрд руб. Реализация такого прогноза связана со следующим:

- масштабированием пилотных внедрений;

- интеграцией ИИ-агентов и мультиагентных систем в бизнес-процессы компаний;

- формированием устойчивой практики использования технологий искусственного интеллекта в корпоративной ИТ-инфраструктуре.

Расширение применения искусственного интеллекта в информационных системах напрямую влияет и на сферу информационной безопасности. По мере распространения таких технологий их роль возрастает как в инструментах атак, так и в средствах противодействия им.

Злоумышленники применяют ИИ для автоматизации подготовки атак, масштабирования фишинговых кампаний, ускорения анализа инфраструктуры целей и т. д. Такие сценарии демонстрируют, что ИИ способен повышать эффективность и скорость действий злоумышленников на всех этапах атак.

В то же время искусственный интеллект внедряется в средства защиты информации. Алгоритмы выявляют аномалии в поведении пользователей и сетевого трафика, коррелируют события из разных источников и автоматически блокируют подозрительную активность. Это делает ИИ важным инструментом для обнаружения и предотвращения угроз в реальном времени.

Однако интеграция ИИ в защитные системы несёт собственные риски. Компании, использующие такие технологии, могут сталкиваться с отравлением обучающих данных, промпт-инъекциями и другими специализированными воздействиями на модели.

Получается, что ИИ одновременно задействован по обе стороны противостояния. К этому мнению пришли и спикеры форума GIS DAYS 2025: наступает эпоха «ИИ против ИИ», где алгоритмы будут противостоять друг другу в киберпространстве. Рассмотрим детально, какие задачи он позволяет решать злоумышленникам и какие функции выполняет в системах информационной безопасности (ИБ).

Использование ИИ злоумышленниками

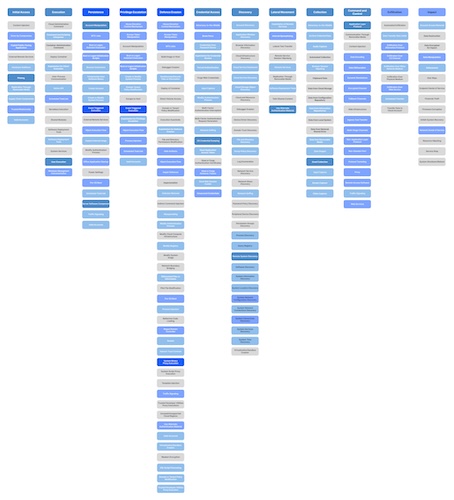

Еще в 2024 Positive Technologies составил тепловую карту и оценил, как скоро киберпреступники смогут применить ИИ для решения задач каждой тактики, техники и подтехники в базе MITRE ATT&CK. Согласно проведённому анализу, потенциальное применение искусственного интеллекта охватило 100 % тактик MITRE ATT&CK и более половины техник — 59 %. Это показало, что в перспективе такие технологии могут найти применение практически на всём периметре:

- бордовый: уже известные случаи применения;

- красный: может применяться в ближайшее время;

- оранжевый: может применяться в обозримом будущем, после решения ряда проблем;

- жёлтый: теоретически применение возможно, но в обозримом будущем почти недостижимо;

- серый: применение ИИ не оправдано или не принесёт существенной пользы.

Рисунок 3. Тепловая матрица MITRE ATT&CK Positive Technologies

Появление больших языковых моделей (LLM) и инструментов вроде ChatGPT, доступных для широкой аудитории, существенно изменило ландшафт киберугроз. После выхода ChatGPT 4 число атак за год увеличилось в несколько раз, что наглядно демонстрирует прямое влияние таких технологий на эффективность преступных схем.

В 2024 году была введена подтехника T1588.007, фиксирующая использование генеративных инструментов искусственного интеллекта, включая большие языковые модели, в кибератаках. Появление этой классификации отражает закрепление нового положения: преступники начали применять ИИ в практических сценариях, а не только в теоретических экспериментах.

Публикуемые новости подтверждают эту тенденцию: злоумышленники продолжают активно использовать технологии ИИ для планирования, организации и проведения атак, что делает киберугрозы более масштабными и сложными для обнаружения.

Снижение порога входа для проведения атак

Если ранее для проведения сложной атаки требовались значительные технические навыки и опыт, сегодня даже пользователи с минимальными знаниями могут использовать ИИ под свои цели.

Риск связан и с темпом, с которым злоумышленники осваивают и адаптируют эти технологии под свои задачи. Инструменты на базе ИИ быстро интегрируются в сценарии атак: автоматизируется подготовка фишинговых кампаний, повышается качество социальной инженерии, ускоряется поиск уязвимостей и генерация эксплойтов и др.

Автоматизация атак

Методы машинного обучения позволяют анализировать большие массивы данных, выявлять скрытые закономерности и обнаруживать уязвимости в информационных системах. С помощью специальных алгоритмов анализируются сетевые топологии, версии программного обеспечения и патч-уровни, что позволяет выявлять слабые места быстрее, чем при традиционных методах ручного тестирования.

Яркий пример — недавнее исследование учёных из Стэнфорда. Агент с ИИ взламывал компьютерные сети университета в течение 16 часов. Он просканировал сеть, нашёл ошибки в конфигурации и недочёты в безопасности серверов и сервисов, продемонстрировав свою способность быстрее и в большем объёме находить слабые места в инфраструктуре, чем человек. ИИ превзошёл 9 из 10 участников-людей.

На основе анализа определяются приоритетные цели, выстраивается последовательность дальнейших действий, проводится дополнительная разведка в отношении потенциальных жертв и их инфраструктуры. Собранная информация применяется для подготовки адресных сценариев атак, включая создание убедительного контента для фишинговых кампаний и других методов социальной инженерии.

Генерация контента для атак

При необходимости ИИ может генерировать любой контент для атаки. Массовое применение дипфейков в преступных схемах стало заметным в середине 2025 года. Широкое распространение получили схемы с просьбами о денежной помощи от якобы знакомых жертвы: с использованием поддельных голосов и видеоизображений.

Разработка вредоносных программ

ИИ используется для разработки вредоносных программ, способных адаптироваться к действующим защитным механизмам. Недавний пример: хактивистская группировка Forbidden Hyena начала использовать технологии ИИ для разработки своих инструментов при атаках на российские компании. BI.ZONE Threat Intelligence отметил, что использование ИИ было заметно по структуре вредоносного кода. В скриптах присутствовали отладочные строки, подробные комментарии и информативные названия переменных. Обфускация, стандартные приёмы запутывания кода, которые обычно используют злоумышленники при самостоятельной разработке, отсутствовала.

Искусственный интеллект в киберзащите

Согласно исследованию, масштабное внедрение технологий искусственного интеллекта в России началось сравнительно недавно. Тем не менее уже сегодня их применение охватывает широкий спектр отраслей и компаний. Все четыре ключевых направления (генеративный ИИ, речевые технологии и обработка естественного языка (NLP), компьютерное зрение и рекомендательные системы) внедряются повсеместно. А в последние два года этот процесс ускорился: около 70 % компаний сфокусировались на интеграции технологий ИИ в свои бизнес-процессы.

В 2025 году Positive Technologies проанализировала матрицу MITRE D3FEND, граф знаний, поддерживаемый корпорацией MITRE и предназначенный для систематизации методов защиты в кибербезопасности. Цель анализа: определить, в каких тактиках и техниках используются ИИ-технологии для противодействия атакам. Результаты показали, что такие технологии уже используются для широкого спектра задач обеспечения ИБ:

- Синий — ИИ уже применяется.

- Голубой — ИИ может применяться.

- Серый — применение ИИ не оправдано или не принесёт существенной пользы.

Вендор отметил, что 100 % тактик и 65 % техник матрицы MITRE ATT&CK будут покрываться техниками защиты, усиленными с помощью ИИ.

Рисунок 4. Карта покрытия MITRE ATT&CK техниками MITRE D3FEND, в которых возможно применение ИИ

Согласно опросу «АМ Медиа», проведённому среди зрителей и участников эфира «Практика применения машинного обучения и ИИ в ИБ», искусственный интеллект может применяться для решения разных задач.

Рисунок 5. Какие задачи в ИБ зрители готовы автоматизировать с помощью ИИ?

Конечно, выделить отдельную область применения ИИ сложно, поскольку технологии пронизывают все механизмы обнаружения и реагирования. Поэтому имеет смысл рассмотреть, как эти технологии уже интегрированы в ИБ, какие реальные задачи они решают в существующих средствах защиты информации.

Автоматизация рутины

ИИ поддерживает общий тренд на автоматизацию и снижение требований к компетенциям аналитиков, снижая их когнитивную нагрузку за счёт обработки повторяющихся и формализуемых операций:

- первичного разбора событий информационной безопасности;

- классификации инцидентов;

- корреляции журналов регистрации;

- приоритизации срабатываний средств защиты информации.

Алгоритмы машинного обучения анализируют телеметрию и выявляют отклонения от типового профиля поведения без постоянного участия оператора. Это позволяет структурировать поток событий и сократить объём ложноположительных срабатываний. Обработка естественного языка применяется для анализа текстовых уведомлений, тикетов и отчётов, обеспечивая консолидацию данных из различных источников. Генеративные модели используются для подготовки черновиков отчётов и формализации рекомендаций на основе накопленной базы знаний.

Как пример можно вспомнить MaxPatrol SIEM, в котором используется подсистема Behavioral Anomaly Detection (BAD), обеспечивающая поддержку принятия решений и выявление аномалий. В основе этого модуля — машинное обучение. BAD работает как система second opinion: сравнивает активность процессов и их действия с легитимными действиями, присваивает всем событиям risk score. Для этого модуль анализирует каждое поступающее из ОС событие с помощью множества атомарных ML-моделей. В этом случае ИИ существенно облегчает работу при первичном анализе событий, акцентируя внимание на наиболее рискованных.

Можно вспомнить AI-консультанта в «Форпосте». Пользователь задаёт вопросы по выявленным уязвимостям, а LLM формирует ответы, например, с указанием рекомендуемой версии для обновления, оценки критичности уязвимостей и др. Платформа обращается к ИИ не абстрактно, а на основе результатов проведённого сканирования. Ответ формируется с учётом выявленных проблем безопасности, опираясь на конкретные данные.

Классификация и описание инцидентов

ИИ позволяет систематизировать и классифицировать инциденты информационной безопасности, анализируя события из разных источников, выявляя типовые сценарии атак и формируя контекст для расследования. После создания инцидента он автоматически классифицируется в реальном времени с помощью модели ML для правильного выбора услуги, категории и подкатегории на основе содержимого поля темы. Это сокращает время реакции аналитиков и снижает вероятность ошибок.

В конце 2025 года, например, группа компаний «Солар» вывела на рынок новый продукт — Solar SIEM, который объединяет две ключевые технологии в одном решении: SIEM и SOAR. В нём реализован ИИ-ассистент, помогающий автоматизировать обработку событий и анализ инцидентов. По данным разработчиков, использование такой технологии позволяет сократить до 90 % трудозатрат на детектирование и реагирование.

Поиск уязвимостей и анализ защищённости

ИИ анализирует конфигурации, открытые сервисы и компоненты, сопоставляет их с базами известных уязвимостей, выявляет потенциальные точки эксплуатации и моделирует цепочки атак. Это ускоряет аудит, снижает ошибки и обеспечивает мониторинг изменений в инфраструктуре, особенно в сложных распределённых и облачных системах.

В качестве примера расскажем об интервью, где Антон Иванов, директор по исследованиям и разработке «Лаборатории Касперского», рассказал о совместном проекте со Сбером. Агентская система ИИ полностью автоматизированно проверяет уровень защищённости сети, проводит пентестинг серверов, узлов и устройств, приоритизирует уязвимости и выявляет неправильные конфигурации. Всё это работает круглосуточно, семь дней в неделю.

Инструменты детекции генеративного контента

С ростом популярности дипфейков и синтетических голосов возникает необходимость выделить отдельный раздел, посвящённый их распознаванию. Сгенерированный контент трудно идентифицировать без использования специальных технических средств.

Инструменты детекции позволяют выявлять искусственно созданный контент и оценивать его подлинность. Алгоритмы анализируют визуальные и аудио-паттерны, фиксируют характерные артефакты генерации. Они проверяют синхронизацию движений губ с речью, непрерывность микродвижений лица и другие признаки, которые сложно воспроизвести при синтезе. В аудиозаписях моделями выявляются аномалии интонации, временные и спектральные несоответствия, характерные для сгенерированного голоса.

Как пример — в ноябре 2025 года МТС Web Services представила детектор дипфейков для медиа, социальных сетей и мессенджеров. Аудиопоток обрабатывается моделью MWS AI, обученной на естественной речи и дообученной на синтетических записях для выявления характерных признаков сгенерированного голоса. Визуальные данные анализируются с помощью детектора VisionLabs для распознавания искусственно созданных изображений и видео. Высокая точность распознавания позволяет решить задачи:

- автоматически выявлять поддельные ролики до их публикации;

- фильтровать синтетический контент в медиа, социальных сетях и мессенджерах;

- предотвращать распространение материалов, способных вводить аудиторию в заблуждение;

- снижать риск массовых панических реакций при распространении фейковых видео о катастрофах или чрезвычайных происшествиях;

- применять технологии распознавания синтетического контента для защиты информационного пространства.

Другие вендоры и разработчики также предпринимают активные меры по противодействию синтетическому контенту. Так, Сбер готов предоставлять свои технологии автоматического выявления дипфейков другим участникам рынка, о чём было объявлено на форуме «Диалог о фейках 3.0». «Яндекс» подключился к просветительскому проекту «Цифровой ликбез», подготовив урок для школьников о распознавании дипфейков и защите от связанных с ними угроз. Материал рассчитан на детей от 6 лет, но может быть полезен и взрослым, включая родителей и педагогов, которые обучают цифровой безопасности.

Эти инициативы демонстрируют, что задачи распознавания синтетического контента и повышения цифровой грамотности решаются комплексно: через внедрение технологий детекции и образование пользователей, что усиливает защиту информационного пространства.

Риски внедрения ИИ в средства защиты информации

Качество данных остаётся ключевым фактором риска: неполные записи, дубли, различия в семантике событий и настройки трекинга между платформами могут искажать выводы моделей, снижая точность классификации и приоритизации инцидентов. Важна также этика и соблюдение приватности: сбор и обработка данных должны соответствовать законодательству и ожиданиям пользователей, включая анонимизацию и согласие.

Риски внедрения ИИ подтверждаются новостями. В прошлом году 83 % компаний зафиксировали хотя бы один инсайдерский инцидент. Ранее источником риска был преимущественно человеческий фактор: умысел или неосторожность. Сегодня всё чаще инциденты создают автономные ИИ-агенты, встроенные в корпоративные системы. Например, их внедрение в SOC и DevOps формирует новый класс рисков: опасность смещается с генерации текста на выполнение реальных действий (удаление ресурсов, изменение кода, обход систем защиты).

Это говорит о том, что модели ИИ могут быть непрозрачны, поэтому интерпретируемость алгоритмов критична для принятия решений командой продукта. Интеграция ИИ в существующие процессы требует времени: необходимо обучить сотрудников, установить метрики эффективности и определить зоны ответственности. Без этого риск неправильного использования технологий или ошибок в анализе инцидентов остаётся высоким.

Противостояние ИИ против ИИ

Конкретные случаи противостояния искусственного интеллекта друг с другом остаются закрытыми: мы не нашли информацию в открытых достоверных источниках о подробностях таких ситуаций. Но нам удалось найти несколько подходов, в которых противостояние алгоритмов заложено на уровне сценариев их применения.

Один из таких подходов реализуется в формате Red Team и Blue Team. В этой модели один алгоритм имитирует действия атакующей стороны: проводит разведку, формирует сценарии эксплуатации уязвимостей и генерирует варианты атак. Второй алгоритм выполняет роль защитной системы: анализирует поведение, находит признаки вторжения и формирует механизмы противодействия. В результате обе системы адаптируются к действиям друг друга, что позволяет тестировать устойчивость защитных механизмов в условиях динамической атаки.

Рассмотрим на примере покупок.

Red Team AI. Взломщик скопировал сайт любимого интернет-магазина, создал точную копию страницы оплаты и прислал вам ссылку на «акцию». Вы заходите, вводите данные карты, не замечая подмены, потому что сайт оформлен привычно.

Blue Team AI. Алгоритм проверяет URL, сравнивает сертификаты, анализирует поведение сайта и уведомляет: «Эта страница не принадлежит магазину, адрес и сертификат отличаются, платёж будет небезопасным». «Защитник» видит контекст, который вы упускаете.

Противостояние ИИ заложено в генеративно-состязательных сетях (Generative Adversarial Networks, GAN). Архитектура состоит из двух нейронных сетей. Первая сеть, генератор, формирует данные. Вторая сеть, дискриминатор, анализирует результат и определяет, являются ли данные подлинными или сгенерированными. Обе модели обучаются одновременно: генератор пытается создавать всё более реалистичные данные, а дискриминатор совершенствует методы их обнаружения.

Одной из первых широко известных реализаций генеративной модели для изображений стала DCGAN (Deep Convolutional GAN, 2015 год). Несмотря на возраст, эта архитектура до сих пор используется как в академических исследованиях, так и на практике для генерации изображений.

Наиболее известной и активно развивающейся моделью остаётся StyleGAN. Она работает с изображениями высокого качества и имеет множество расширений и модификаций, позволяющих гибко применять её в разных задачах. StyleGAN переняла из модели Progressive Growing of GANs технику поэтапного увеличения разрешения изображения: генерация начинается с низкого разрешения и постепенно усложняется, что улучшает реалистичность конечного результата.

В отличие от классических систем машинного обучения, где модель учится на примерах и стремится минимизировать ошибку, GAN обучается на «взаимной ошибке». Такое обучение построено на постоянном соперничестве алгоритмов и используется для повышения качества моделей и устойчивости систем распознавания.

Выводы

Злоумышленники, использующие искусственный интеллект, действуют быстрее организаций, так как их операции не ограничены внутренними согласованиями или нормативными требованиями. Цели ставятся и реализуются средствами ИИ практически мгновенно. Это сокращает цикл подготовки атаки и увеличивает вариативность техник, создавая давление на защитные механизмы не за счёт новых классов угроз, а из-за ускорения их разработки и масштабирования.

Разработчики решений по кибербезопасности интегрируют ИИ в продукты постепенно, ориентируясь на прикладные задачи защиты. Такой подход позволяет формировать адаптивные системы, способные блокировать действия автоматизированных угроз, сохраняя эффективность несмотря на ограничения, связанные с нормативными и этическими требованиями.

В противостоянии «ИИ против ИИ» решает не только мощность алгоритмов, но и способность систем быстро учиться и адаптироваться к новым условиям. Победит тот ИИ, который сможет эффективнее использовать свои ресурсы и корректно реагировать на неожиданные изменения среды.