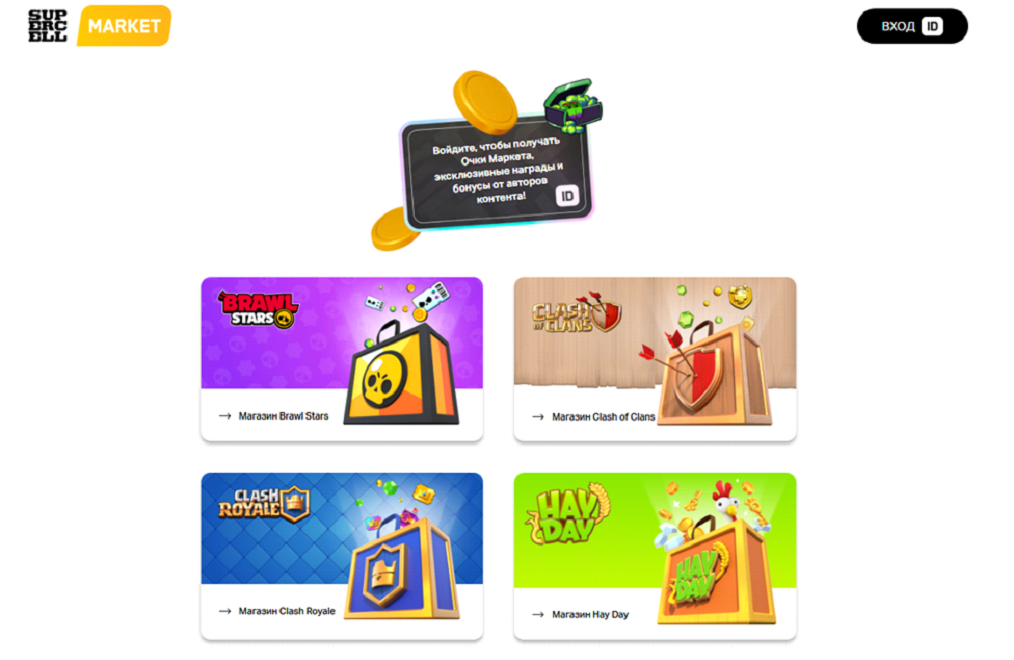

Компания Эфшесть/F6 зафиксировала фишинговые атаки на детей и подростков, играющих в мобильные проекты Supercell. Под удар попали пользователи Brawl Stars, Clash of Clans, Clash Royale и других игр студии. В схеме используется как минимум девять активных фишинговых доменов. Среди них есть русскоязычный сайт, который имитирует официальный магазин Supercell.

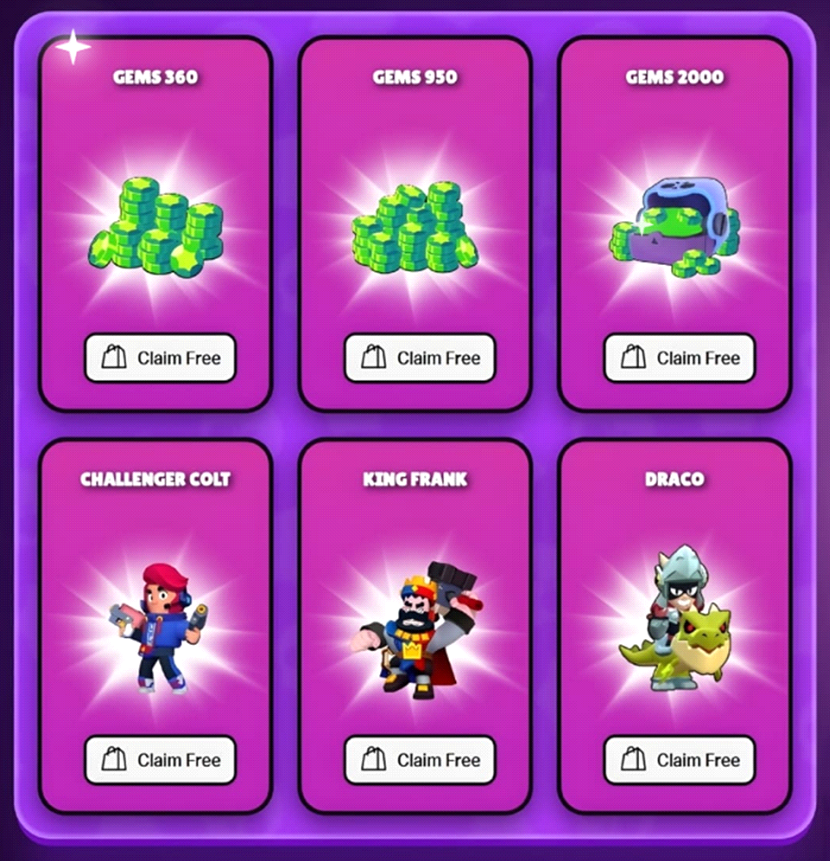

Мошенники играют на простой и рабочей приманке — бесплатных бонусах. В соцсетях они размещают объявления якобы от имени Supercell Store и обещают уникальные акции, бесплатные гемы, скины, бусты и другие внутриигровые подарки. Причём предложения выглядят заметно щедрее, чем настоящие акции разработчика.

Ссылки из таких публикаций ведут на фишинговые сайты. Их адреса похожи на настоящие, а оформление копирует стиль Brawl Stars и других игр Supercell. После перехода пользователя просят ввести ID игрового аккаунта, затем выбрать приз — например гемы, скин или специальную акцию.

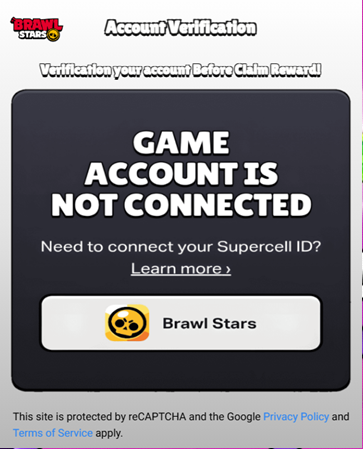

Дальше начинается основная часть схемы: для получения подарка ребёнка или подростка просят пройти верификацию через поддельную форму Google-аккаунта и подтвердить номер телефона. Так злоумышленники получают доступ к учётной записи Supercell. После этого аккаунт можно перепродать на сторонних площадках.

Похожую схему Эфшесть/F6 фиксирует и в отношении игроков Clash of Clans.

Эксперты отмечают, что такие атаки особенно хорошо работают против молодой аудитории. Дети чаще реагируют на обещания бесплатных бонусов и могут не заметить подмену сайта или подозрительную форму входа.