Российская компания ООО «СИС разработка» (MFASOFT) выпустила программный модуль (агент) для входа в Windows. Теперь доступ к рабочему столу клиентского компьютера или сервера можно дополнительно защитить одноразовым паролем или пуш-уведомлением. Агент входит в состав программного комплекса MFASOFT Secure Authentication Server (SAS) версии 1.15 и уже доступен всем заказчикам с правами на использование этой версии.

При развертывании централизованных решений для многофакторной аутентификации часто требуется усилить аутентификацию при входе в операционные системы семейства

Microsoft Windows дополнительным фактором – одноразовым паролем или пуш-уведомлением. Это помогает защитить от несанкционированного доступа файлы на локальных и сетевых дисках, а также информацию в приложениях, установленных на компьютере.

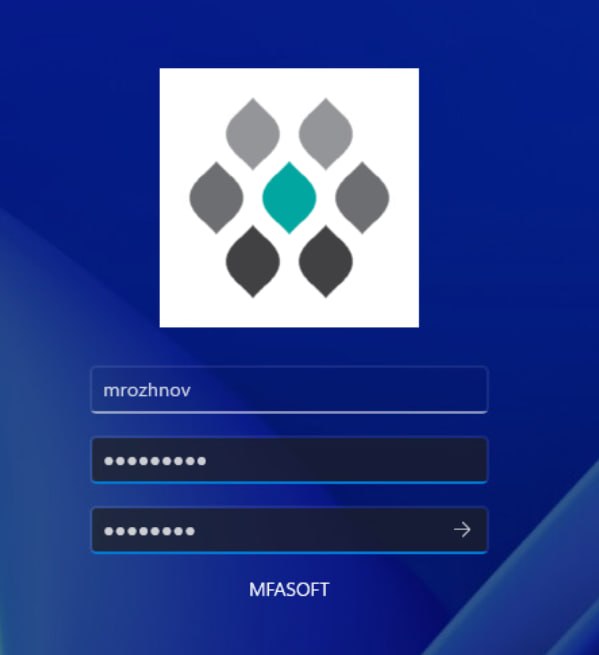

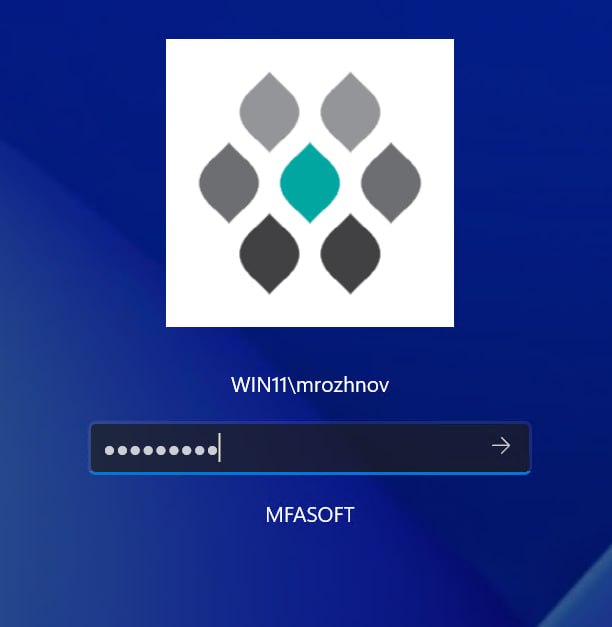

Для решения этой задачи компания MFASOFT разработала модуль MFASOFT Logon, который представляет собой поставщик учетных данных (Credential Provider) для модуля Winlogon операционных систем Windows. При входе в Windows пользователь вводит свои логин и пароль, а если правила MFASOFT Logon требуют проверки второго фактора, то еще и значение одноразового пароля с токена HOTP/TOTP или символ-селектор для отправки пуш-уведомления либо одноразового пароля по СМС, в мессенджер или по электронной почте.

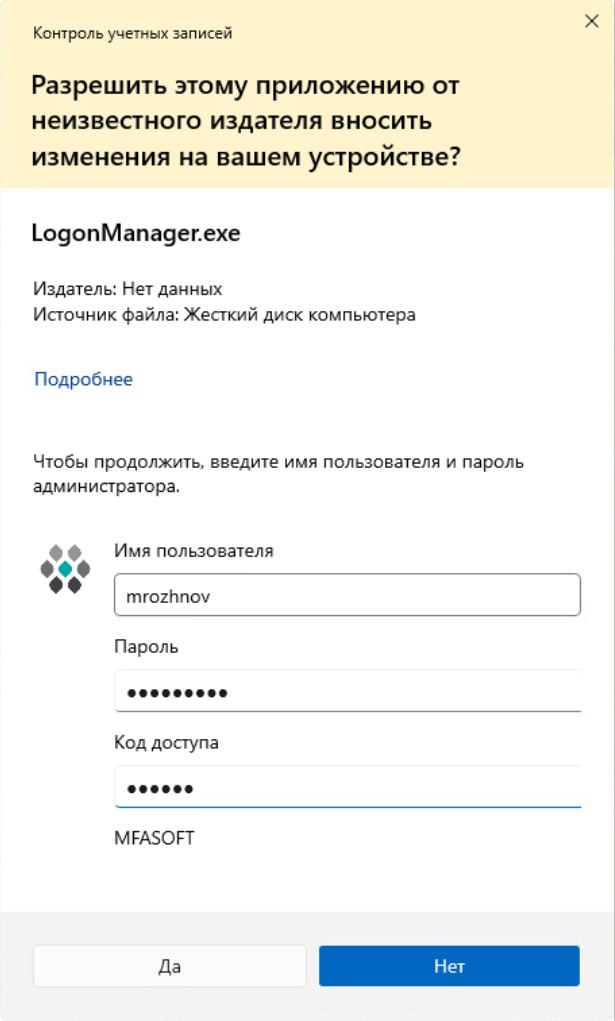

MFASOFT Logon позволяет проверять второй фактор при локальном или удаленном (по протоколу RDP) интерактивном входе в Windows, при исходящем подключении к удаленному рабочему столу, при вызове механизма контроля учетных записей (User Account Control, UAC), а также при входе в заблокированный сеанс, причем проверку второго фактора для локальных и доменных администраторов можно отключить. Модуль совместим с операционными системами Microsoft Windows 10 и 11, а также Microsoft Windows Server (в варианте установки Server with Desktop Experience) 2019, 2022 и 2025. Доступны русский и английский языки интерфейса, а также установка собственного логотипа на экране входа.

Соединение агента с сервером аутентификации SAS защищено с помощью TLS, при этом агент может проверять действительность сертификата (срок действия, цепочку, Common Name и список отозванных сертификатов). Отказоустойчивость поддерживается за счет использования нескольких серверов аутентификации, которые можно указывать в конфигурации модуля MFASOFT Logon. Чтобы упростить настройку решения, когда пространство IP-адресов клиентских компьютеров сильно фрагментировано, а также ускорить включение режима bypass (временное отключение проверки второго фактора), был разработан агент TVP (Token Validator Proxy). Он работает как посредник между компьютерами с модулем MFASOFT Logon и серверами аутентификации SAS. TVP поставляется в виде готового контейнера Docker, поэтому его можно запустить на самых разных программных платформах.

«Машины под Windows по-прежнему преобладают в информационных системах многих наших заказчиков, поэтому этот агент давно ждали. При разработке нашего комплекса мы сделали акцент на снижении совокупной стоимости владения, включая расходы на поддержку и скрытые издержки, вызванные простоями. Поэтому нам было важно, чтобы MFASOFT Logon доставлял минимум хлопот пользователям и администраторам, – отмечает Михаил Рожнов, технический директор MFASOFT».

MFASOFT (ООО «СИС разработка») – российская компания, которая создает программное обеспечение для централизованной защиты доступа к корпоративным ресурсам на основе многофакторной аутентификации. Ее программный комплекс MFASOFT Secure Authentication Server (SAS) включен в реестр российского ПО и сертифицирован ФСТЭК России по 4 уровню доверия. Продукт разработан на мультиплатформенном открытом стеке технологий, который обеспечивает скорость развертывания, масштабируемость и отказоустойчивость. Удобство управления достигается благодаря многоуровневой мультиарендности, гибкой системе ролей доступа, встроенным средствам автоматизации, самообслуживания и аудита, а также целостному подходу к жизненному циклу аутентификаторов. SAS можно развернуть локально в корпоративной инфраструктуре или использовать как сервис через облачных провайдеров MFASOFT.