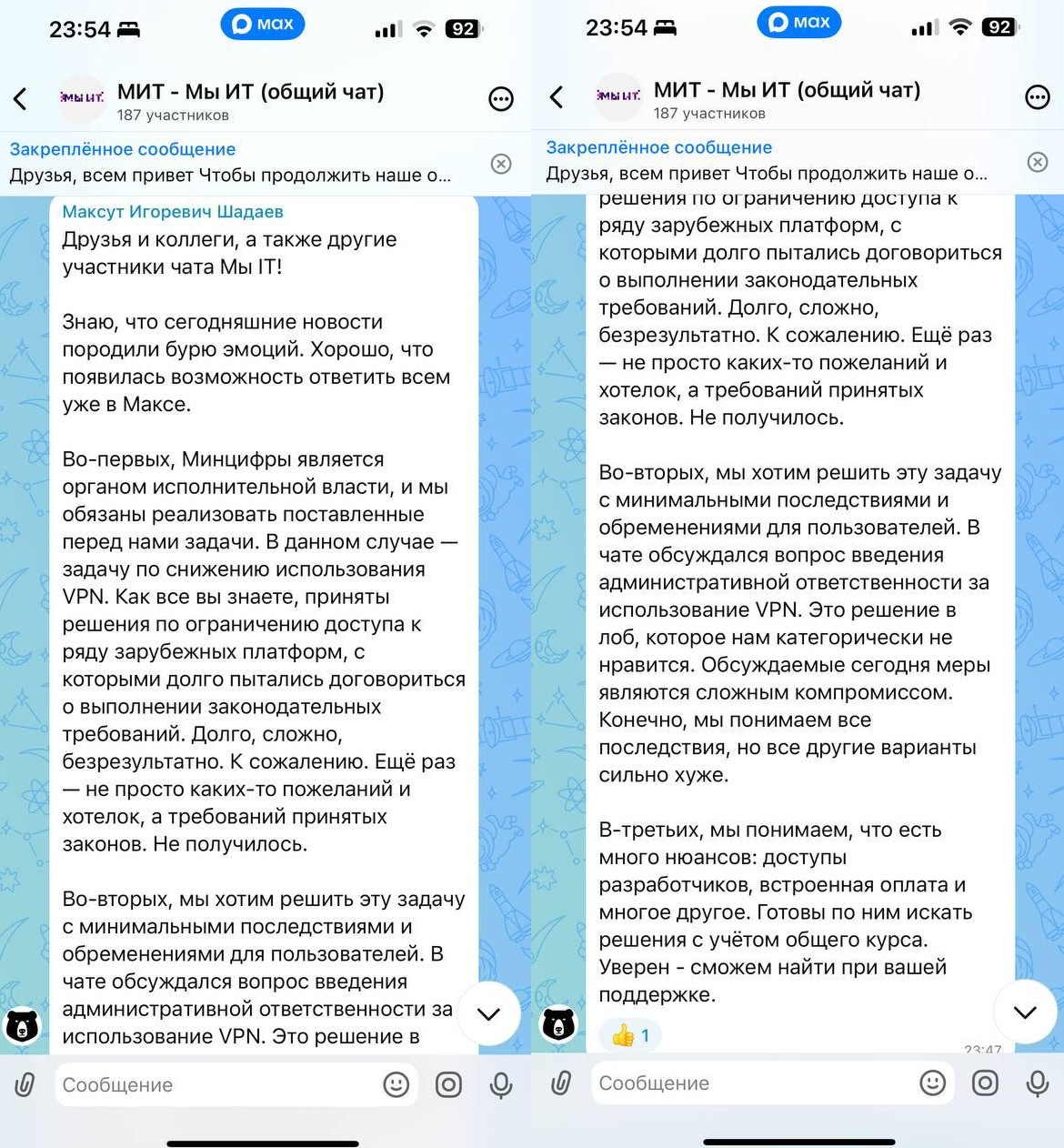

Как заявил министр цифрового развития, связи и массовых коммуникаций Максут Шадаев в разговоре с сообществом «МИТ — Мы ИТ», перед ведомством поставлена задача сократить использование VPN. Для этого готовится ряд мер, однако идея введения административной ответственности за использование таких сервисов, по словам главы министерства, ему «категорически не нравится».

По его словам, причиной стало то, что, несмотря на ограничения, введённые в отношении ряда платформ, пользователи продолжают ими пользоваться.

ТАСС приводит следующую цитату из выступления Шадаева:

«Минцифры является органом исполнительной власти, и мы обязаны реализовать поставленные перед нами задачи. В данном случае — задачу по снижению использования VPN.

Как все вы знаете, приняты решения по ограничению доступа к ряду зарубежных платформ, с которыми долго пытались договориться о выполнении законодательных требований. Долго, сложно, безрезультатно. К сожалению. Еще раз — не просто каких-то пожеланий и хотелок, а требований принятых законов. Не получилось».

Для этого ведомство разработало ряд мер, которые, как отметил глава Минцифры, стали «нелёгким компромиссом». По его словам, они должны создать минимум неудобств для пользователей. Введение административной ответственности не рассматривается: «Это решение в лоб, которое нам категорически не нравится».

Среди таких мер, как сообщает «Коммерсантъ», — исключение из «белых» списков сайтов, которые остаются доступными пользователям при включённом VPN. Речь идёт, в частности, о банках, маркетплейсах и соцсетях.

По данным издания, письмо с таким обращением уже направлено компаниям. Однако МТС и Wildberries в комментариях для «Коммерсанта» опровергли введение подобных ограничений. Во «Вкусно — и точка» сообщили, что их сайт не работает при включённом VPN.

Независимый эксперт в сфере искусственного интеллекта и информационных технологий Алексей Лерон оценил долю российских пользователей, регулярно использующих VPN, в 39%. При этом применение таких сервисов для доступа к отечественным платформам создаёт проблемы для работы «белых списков».

Независимый эксперт Алексей Учакин в комментарии для РБК отметил, что выделить VPN-трафик возможно, однако на практике это сложно и чревато ложными срабатываниями.

Также ограничения на покупки и оплату подписок в AppStore через счета мобильной связи некоторые эксперты связывают с попыткой лишить пользователей возможности оплачивать подписки на платные VPN-сервисы. Хотя формально причиной называлось возвращение в AppStore российских приложений, ранее удалённых оттуда из-за санкций.