Опасения ФБР по поводу вторжения «русских хакеров» в процесс выборов президента США подогрел новый отчёт Check Point. Исследователи компании полагают, что Россия вкладывает немалые средства в создание инструментов кибершпионажа.

Update: Опубликованные в отчете гипотезы вызвали много вопросов сторонних экспертов, поэтому компания приняла решения отозвать его на переработку и уточнение. Мы будем обновлять материал по мере поступления новой информации.

По словам Check Point, команде специалистов удалось раскрыть весь масштаб «российской машины для кибератак» — как она организована, какие огромные деньги в неё вливаются.

Исходя из предоставленной компанией информации, Россия построила целую экосистему, способную направлять атаки волнами. Check Point считает, что эта система разрабатывалась годами и теперь от атак России на США будет практически невозможно защититься.

Исследователи Check Point поставили себе задачу — среди множества атак и образцов вредоносных программ найти общие черты и паттерны, чтобы в конечном счёте прийти к пониманию масштабов всей экосистемы «российской машины для кибератак».

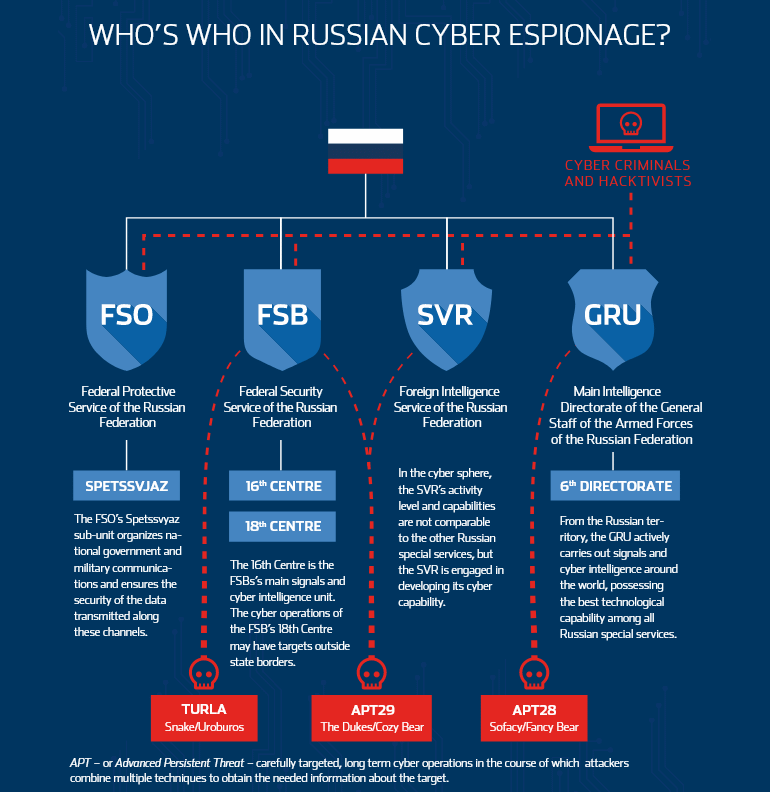

Эксперты искали связь между правительственными киберпреступными группами, работающими на разные российские агентства: ФСО, ФСБ, ГРУ. Но в результате Check Point наткнулась на нечто другое.

Аналитики компании заявили, что вышли на хорошо организованную структуру, которую создавали и обкатывали годами. Эта структура якобы призвана осуществлять координированные кибероперации, при этом детектирование и перехват злонамеренных операций затруднили настолько, насколько это возможно.

«Результаты исследования действительно удивляют. Мы нашли доказательства огромных вложений России в разведывательные операции в цифровом пространстве», — подводят итог специалисты Check Point.

Помимо этого, проанализировав около 2 тыс. образцов вредоносов, команда Check Point пришла к выводу, что российские правительственные хакеры редко используют один и тот же код. Если это происходит, то только между группами, работающими на одну спецслужбу.

Исследователи также создали интерактивную карту, которая отражает связь между образцами вредоносных программ из России.