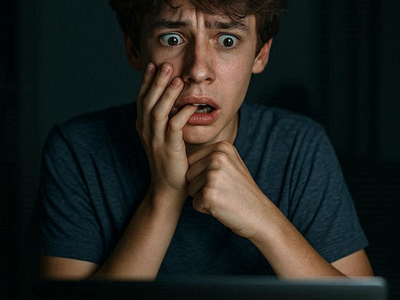

Эксперты «Перспективного мониторинга» выяснили: мошенники всё активнее давят не на системы, а на психику. Причём бьют по самым уязвимым — детям, подросткам и пожилым людям. В мае специалисты зафиксировали рост схем, где главную роль играют паника, доверие и срочность.

Один из популярных сценариев — родственник в беде, только теперь звонят не бабушкам, а детям.

Злоумышленники представляются полицейскими, врачами или знакомыми семьи и сообщают, что родители якобы попали в ДТП или отделение полиции. Дальше всё по классике: срочно найди дома деньги, карты, ценности и передай курьеру. Ребёнок напуган, проверить информацию не успевает, мошенникам только это и нужно.

Похожая схема работает и в мессенджерах. Взламывается аккаунт подростка, после чего его друзьям и родственникам летят просьбы срочно одолжить денег. Знакомый профиль снижает бдительность, деньги уходят не другу, а в карман злоумышленникам.

Отдельная кормушка — игры. Детям предлагают скачать взломанные версии популярных тайтлов, бесплатную валюту или моды. На деле вместе с подарком на устройство может прилететь вредоносная программа, которая крадёт данные, перехватывает сообщения и коды подтверждения или позволяет управлять гаджетом.

Есть и беспроигрышные конкурсы от имени блогеров: оплатите доставку, комиссию или подтверждение выигрыша — и, конечно, получите не приз, а тишину. Летом добавляется ещё одна приманка: выгодная подработка для подростков. Ссылки для оформления ведут на фишинговые анкеты, где собирают персональные данные, включая сведения о родителях.

Особенно активно мошенники эксплуатируют экзаменационный сезон. Под видом сотрудников школ или ведомств они пугают подростков проблемами с ЕГЭ и требуют подтвердить данные или прислать СМС-коды. Параллельно работают сайты и боты с продажей ответов на ЕГЭ за 799-5000 рублей. После оплаты жертва получает пустой архив или вредоносный файл под видом PDF.