Игра для мобильной операционной системы Android, которую уже успели установить 50 тысяч пользователей, крадет учетные записи от аккаунтов Google и Facebook. Помимо этого, приложение передает злоумышленникам информацию о пользователях.

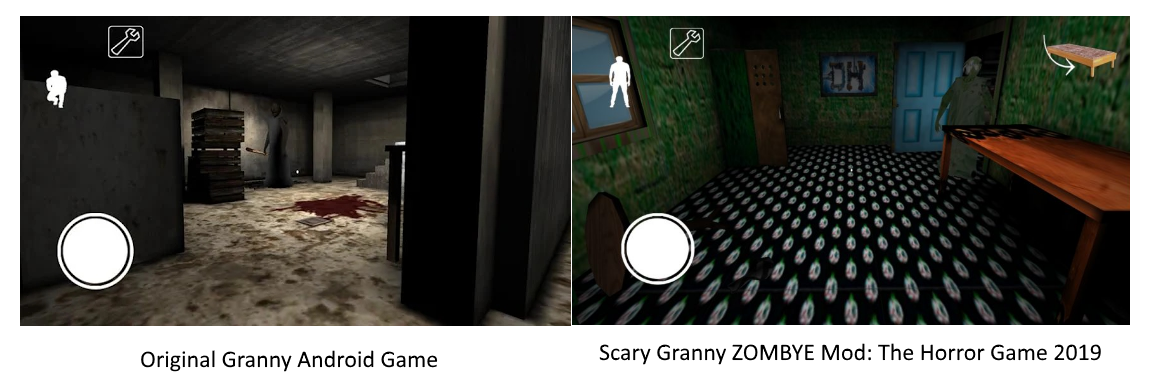

Речь идет об игре в жанре хоррор под названием «Scary Granny ZOMBYE Mod: The Horror Game 2019 (Scary Granny)». Она разработана таким образом, чтобы паразитировать на успехе более популярной Android-игры — Granny.

Оригинальная Granny значительно известнее своего вредоносного клона — ее установили более 100 миллионов пользователей.

Scary Granny полностью предоставляет заявленные возможности, что помогает избежать подозрений со стороны пользователей, а заодно обойти фильтры официального магазина приложений Google Play Store.

Исследователи из компании Wandera проанализировали данное приложение и обнаружили фишинговые возможности, а также факт утечки данных пользователей. Об этом сразу же сообщили Google, которая удалила Scary Granny из Play Store 27 июня.

На сохраненную в кеше страницу игры можно посмотреть по этой ссылке.

По словам экспертов, игры выжидала до двух дней, прежде чем активировать свои вредоносные функции. Также известно, что приложение похищало пользовательские данные лишь в том случае, если его запускали на старых версиях Android.

Утечка личной информации не грозила тем людям, которые использовали полностью обновленные новые версии ОС Android.

Scary Granny пыталась обеспечить себе постоянное присутствие на смартфоне или планшете, запрашивая разрешение на запуск после старта самой операционной системы.

В дальнейшем злонамеренная игра использовала целый спектр известных киберпреступных схем: накладывала фишинговые окна поверх форм для входа в учетные записи Google, собирала информацию об аккаунте пользователя и отправляла ее злоумышленнику.

При этом в руки преступника попадали такие серьезные данные, как адреса электронной почты для восстановления аккаунтов, номера телефонов, даты рождения, файлы cookies и токены для входа.