В американском App Store обнаружили цифрового оборотня. В топ самых скачиваемых бесплатных приложений для iPhone неожиданно ворвалась программа «Сириус», которая маскируется под таймер для работы по методу Pomodoro. Вот только пользователи быстро заподозрили, что за фасадом приложения для повышения продуктивности скрывается совсем другой сервис — клиент ВТБ.

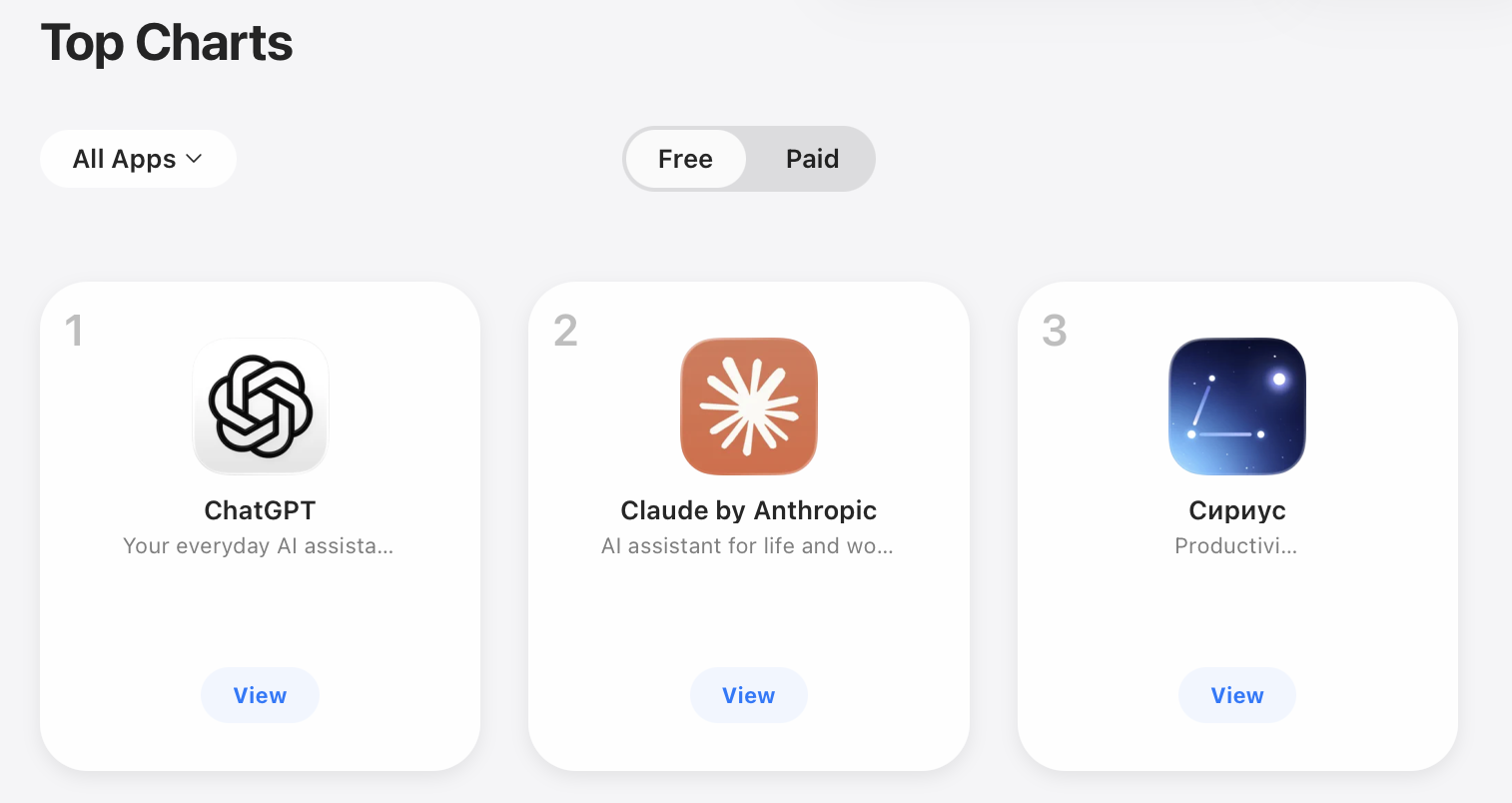

На момент обнаружения «Сириус» занимал третье место среди бесплатных приложений в американском App Store, уступая только популярным ИИ-чат-ботам и отдельным хитам вроде сервисов, связанных с шоу Love Island.

Сам по себе такой успех уже выглядел странно: приложение доступно только на русском языке и вряд ли могло органически набрать миллионы загрузок среди американских пользователей.

Официально «Сириус» позиционируется как помощник для управления задачами. В описании говорится о классическом Pomodoro-таймере, аналитике продуктивности, отчётах с фотографиями и голосовыми заметками, а также умных рекомендациях для повышения эффективности.

Однако активность в Telegram и анализ приложения указывают на другое назначение. По данным профильных изданий, «Сириус» может являться замаскированным клиентом российского банка ВТБ.

После введения западных санкций ВТБ лишился возможности официально распространять свои приложения через App Store. Поэтому банк уже не первый раз использует альтернативные схемы публикации мобильных клиентов под видом совершенно других сервисов. Ранее аналогичные приложения появлялись под названиями, никак не связанными с банковской сферой, а затем исчезали после обнаружения модераторами Apple.