Google решила серьёзнее взяться за Android-приложения, которые зря расходуют заряд аккумулятора в фоне. С 1 марта 2026 года в Play Store могут появляться предупреждения, если приложение излишне расходует батарею из-за чрезмерной фоновой активности.

Речь идёт не о нормальных сценариях вроде музыки, навигации или загрузки большого файла.

Проблема в приложениях, которые удерживают процессор активным, даже когда экран выключен и пользователь ничего не делает. Для этого Android использует механизм partial wake lock: он нужен, чтобы приложение могло завершить важную задачу, пока телефон находится в режиме ожидания.

Но если разработчик плохо настроил работу приложения, оно может слишком долго не давать устройству перейти в энергосберегающий режим. Пользователь в этот момент ничего не видит; просто позже замечает, что заряд куда-то исчез.

Google теперь будет отслеживать такие случаи. Приложение могут посчитать проблемным, если оно удерживает wake lock больше двух часов за сутки при выключенном экране. Но наказание последует не за единичный сбой: такой сценарий должен повторяться более чем в 5% пользовательских сессий за 28 дней.

Источник: Android Police

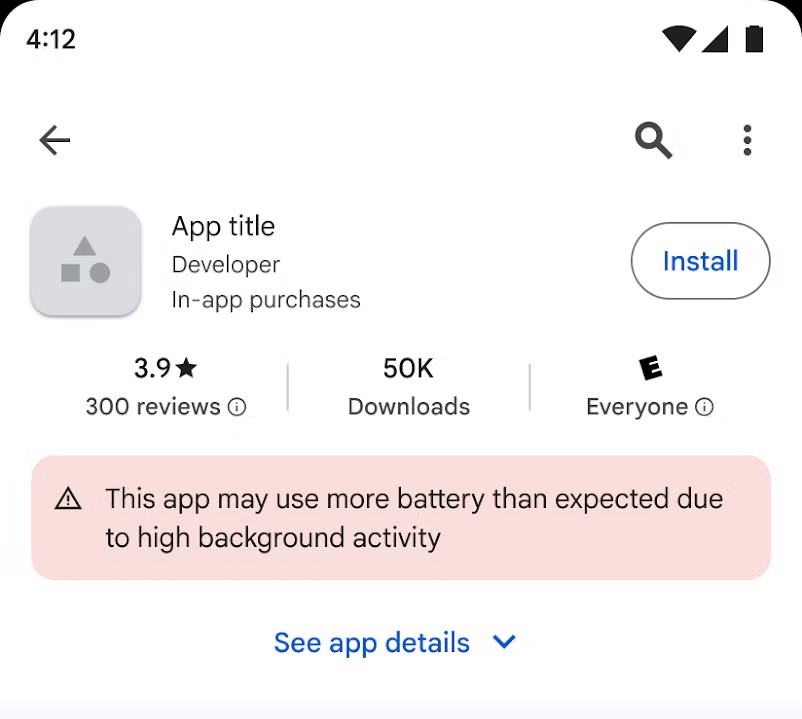

Если приложение не пройдёт проверку, на его странице в Google Play может появиться предупреждение о повышенном расходе батареи. Для пользователя это будет простой сигнал: приложение может быстро посадить смартфон.

Кроме того, такие приложения могут потерять позиции в рекомендациях и похожих подборках Google Play.