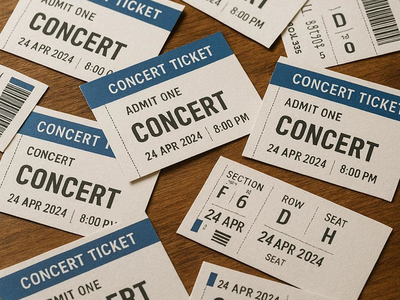

Компания «Эфшесть»/F6 сообщила о заметной активизации мошенников, продающих фейковые билеты на концерты в России и за рубежом. При этом злоумышленники меняют тактику: если раньше они чаще использовали фишинговые сайты, то в 2026 году основная активность сместилась в мессенджеры и социальные сети.

Аферисты активно используют бренды как российских, так и зарубежных исполнителей. В 2026 году злоумышленники изменили подход.

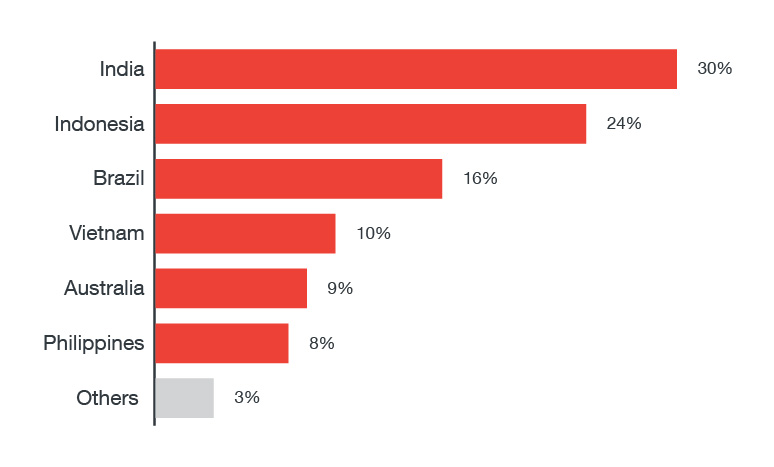

Раньше они чаще предлагали поддельные билеты через фишинговые ресурсы или сайты-двойники популярных агрегаторов, а теперь основными каналами стали мессенджеры и соцсети. Объявления о продаже билетов на мероприятия в России обычно размещают за 1–5 дней или даже за несколько часов до концерта, а на зарубежные события — за 2–3 месяца.

Количество таких объявлений напрямую зависит от интереса к мероприятию. В среднем перед каждым концертом появляется около 300 публикаций, выполненных по единому шаблону и размещённых с подставных аккаунтов, которые затем быстро удаляют.

«Переписка с "продавцом" происходит в личных сообщениях. Злоумышленники охотно и дружелюбно отвечают на вопросы потенциальных покупателей. При продаже билетов на зарубежные концерты "продавцы" обычно уверяют, что передача билетов покупателю будет проводиться через официальный сайт организатора концерта», — говорится в сообщении компании.

После этого мошенники просят перевести деньги любым удобным способом и обещают отправить квитанцию после поступления платежа. Когда пользователь оплачивает «билет», его просят «подождать подтверждения» или сообщают о якобы возникших «проблемах с поддержкой».

В F6 рекомендуют покупать билеты на концерты, спектакли и другие мероприятия только через официальные ресурсы. Любые предложения в мессенджерах, социальных сетях и на досках объявлений следует рассматривать как потенциально мошеннические.

Помимо билетов на концерты и спектакли, злоумышленники уже давно освоили продажу фейковых авиабилетов. В таких схемах целью часто становится не только получение денег за несуществующие билеты, но и кража платёжных реквизитов. Кроме того, продажа поддельных билетов уже давно стала частью схем с фальшивыми свиданиями.