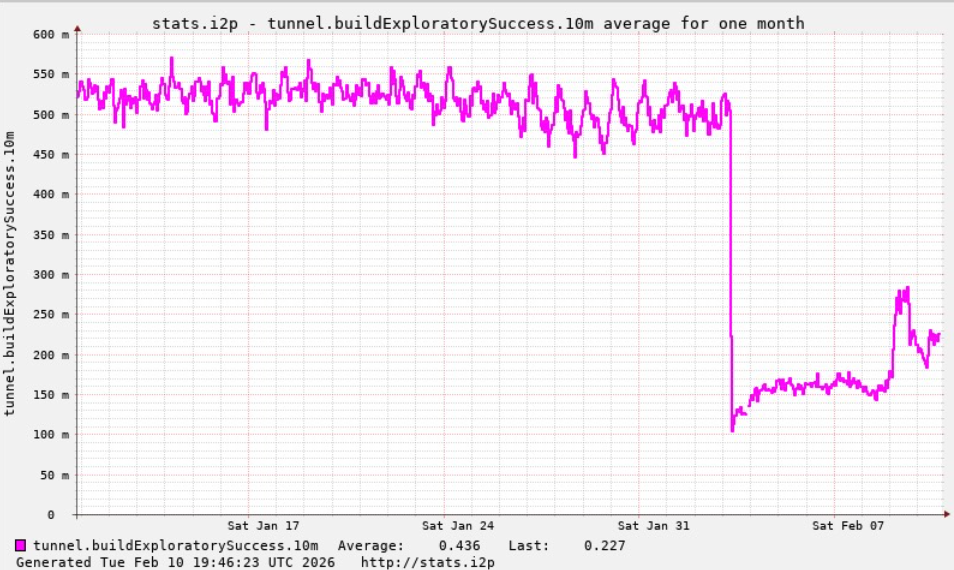

Последнее время пользователи I2P массово жалуются на сбои: при повышении нагрузки роутеры виснут, временами анонимная сеть вообще выпадает из доступа. Как оказалось, причиной тому внезапное нашествие 700 тыс. ботов Kimwolf.

Попытки многочисленных зараженных устройств присоединиться к I2P-сети, в которой, как выяснил KrebsOnSecurity, ежедневно активны лишь 15-20 тыс. узлов, стали забивать каналы, как при DDoS-атаке.

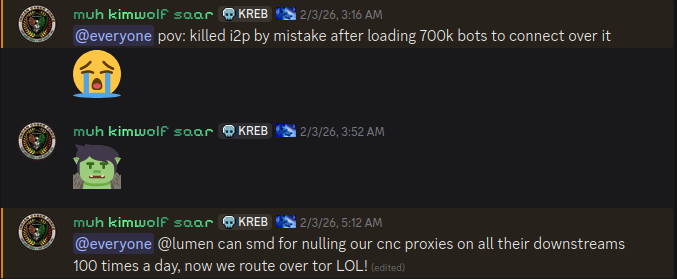

Ботоводы Kimwolf сами не ожидали такого эффекта: ведь они просто хотели опробовать I2P в качестве резервного варианта C2-связи — на случай отказа основной командной инфраструктуры стараниями правоохраны и законопослушных провайдеров.

В итоге было решено отказаться от этой идеи и поэкспериментировать с Tor.

В настоящее время I2P-сеть все еще работает вполсилы. Обновления подготовлены и развертываются, на следующей неделе ситуация должна улучшиться.

Объявившийся в конце прошлого года IoT-ботнет Kimwolf быстро возрос: в январе в его состав уже входило более 2 млн зараженных устройств. Новобранец используется в основном для проксирования вредоносного трафика и проведения DDoS-атак.

В американской компании Synthient отслеживают новую угрозу и недавно заметили, что численность мощного ботнета сократилась на 600 тыс. устройств.