Как сообщило Управление по организации борьбы с противоправным использованием информационно-коммуникационных технологий МВД России (УБК МВД), злоумышленники начали использовать символы из разных алфавитов, необычные знаки и смешанный регистр, чтобы обходить автоматические системы защиты мессенджеров и маскировать массовые рассылки.

О такой тактике маскировки предупреждает официальный телеграм-канал УБК МВД «Вестник киберполиции России».

Однако, как иронизируют авторы канала, странные сочетания символов и хаотичный регистр сами по себе становятся одним из самых заметных признаков злонамеренной активности. Особенно если к сообщениям прикреплены APK-файлы или архивы, за которыми могут скрываться зловреды.

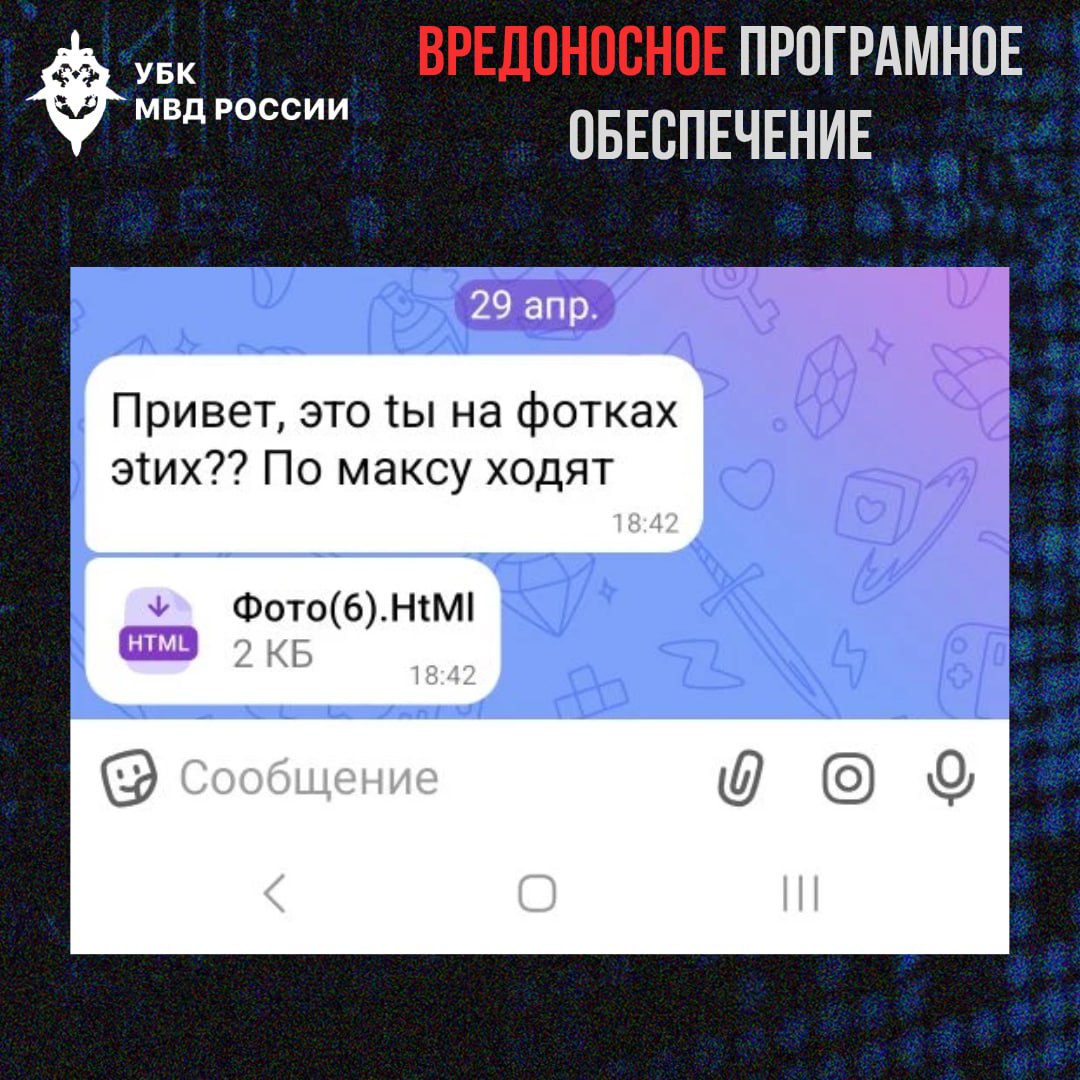

О вредоносной кампании по распространению трояна Mamont УБК МВД сообщало ещё в начале августа 2025 года. Тогда злоумышленники маскировали установочный файл зловреда под фото и видео. В феврале 2026 года Mamont начали распространять под видом ускорителя Telegram.

В начале марта злоумышленники начали переносить активность и на другие платформы, в частности на российскую МАКС. Причём речь идёт не об отдельных пользователях, а о целых сообществах — домовых, родительских, дачных и других чатах.