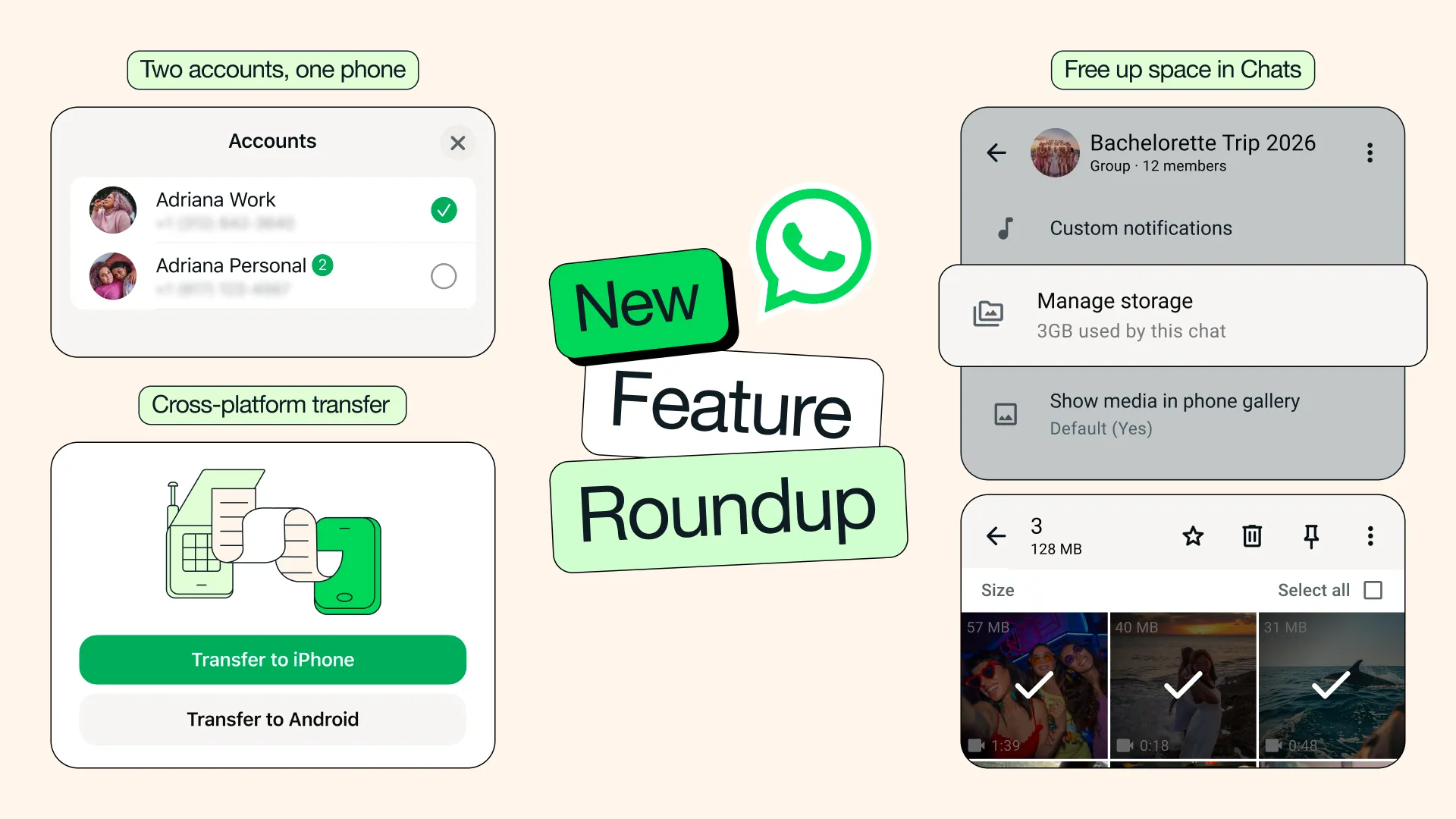

Пользователи WhatsApp (принадлежит Meta, признанной экстремистской и запрещенной в России) на iPhone наконец дождались функции, которая уже давно стала привычной для Android: теперь в приложении можно одновременно использовать два аккаунта на одном устройстве. Для владельцев iPhone это, пожалуй, одно из самых заметных обновлений за последнее время.

Новая функция позволяет без лишней суеты переключаться между двумя учётными записями прямо внутри приложения.

WhatsApp будет показывать, какой аккаунт активен в данный момент, а перед отправкой сообщений интерфейс дополнительно подскажет, от какого профиля пользователь пишет. Это должно снизить риск неловких ситуаций, когда рабочее сообщение случайно улетает не туда.

Но на двух аккаунтах обновление не заканчивается. В WhatsApp также доработали перенос чатов между устройствами. Причём речь идёт не только о переходе внутри одной экосистемы, но и о миграции между iPhone и Android. Судя по описанию, процесс должен стать заметно проще и надёжнее, а история переписки будет переноситься с меньшим количеством боли для пользователя.

Ещё одно полезное нововведение касается памяти устройства. Мессенджеры давно умеют незаметно разрастаться за счёт голосовых сообщений, фотографий и видео, WhatsApp тут не исключение. Теперь пользователям обещают более удобный доступ к управлению хранилищем: можно зайти в конкретный чат, открыть раздел «Управление хранилищем» и удалить крупные файлы, которые занимают слишком много места.

Кроме того, появилась возможность удалять медиафайлы внутри отдельного чата, не затрагивая при этом саму текстовую переписку. То есть фотографии и видео можно почистить, а сообщения оставить на месте. Для тех, кто не хочет расставаться с историей общения, но при этом постоянно борется за свободную память на смартфоне, это действительно полезная мелочь.

Отдельный акцент Meta делает на интеграции Meta AI. В WhatsApp появятся инструменты на базе генеративного ИИ, которые помогут и с изображениями, и с текстами. Например, ИИ сможет редактировать фотографии: удалять фон, менять стиль изображения или убирать лишние объекты из кадра.

Также заявлена функция Writing Help — своеобразный ИИ-помощник для текста. Если пользователь не знает, как начать сообщение или хочет сделать ответ более формальным и аккуратным, система сможет предложить черновик и помочь с формулировками.