Как показало исследование Positive Technologies, киберпреступники начали активно внедрять искусственный интеллект (ИИ) в свою деятельность. Уже в самом ближайшем будущем киберпреступники смогут найти ИИ применение во всех тактиках из базы MITRE ATT&CK, а также в 59% ее техник.

Как отмечают авторы исследования, до недавнего времени злоумышленники применяли ИИ не очень активно: он использовался лишь в 5% техник MITRE ATT&CK и еще для 17% применение такого инструментария признавалось перспективным.

Все изменило появление больших языковых моделей (LLM) и инструментов вроде ChatGPT, которые легальны и общедоступны. После выхода ChatGPT 4 количество фишинговых атак за год выросло в 13 раз.

Как особо обратили внимание аналитики, популярности инструментов ИИ у киберпреступников способствует также тот факт, что LLM не имеют ограничений, которые бы препятствовали генерации с их помощью вредоносного кода или инструкций. В итоге такие инструменты довольно широко используются для создания различных программных зловредов.

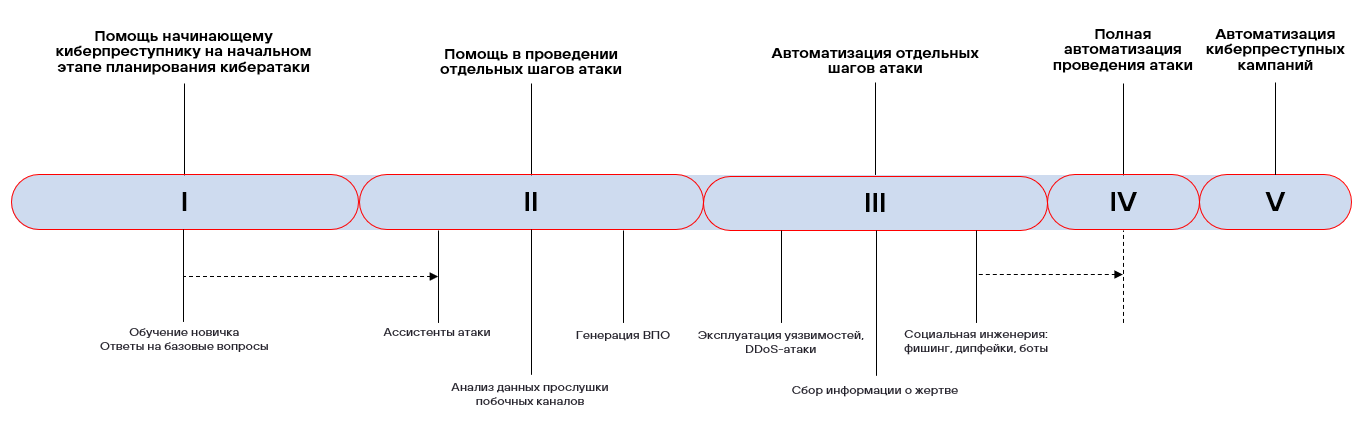

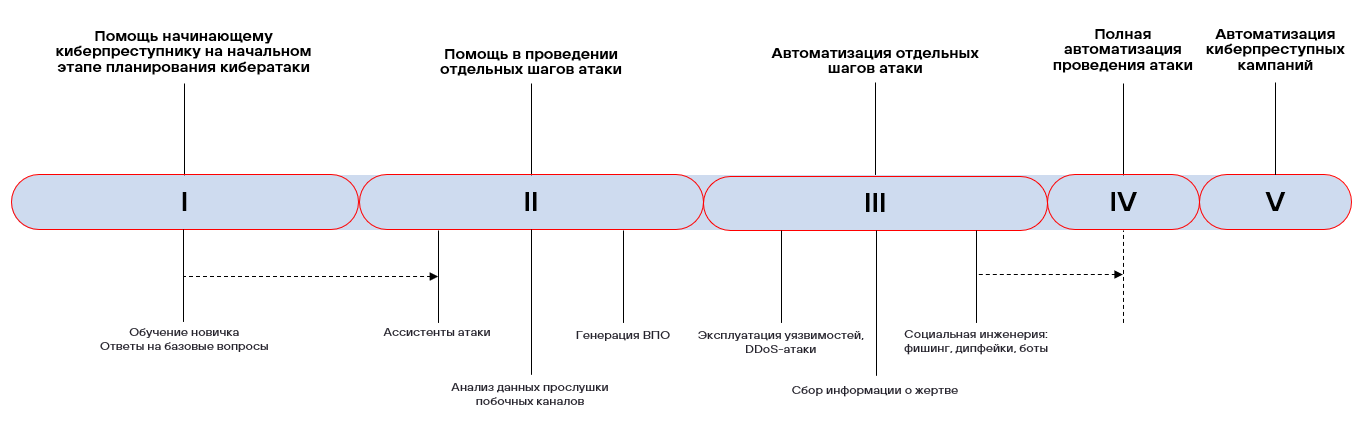

Обращение к большим языковым моделям помогает начинающим киберпреступникам, ускорять подготовку к атакам. Злоумышленник может с их помощью уточнить, не упустил ли он чего-то или изучить различные подходы к реализации определенных шагов в ходе той иной акции.

Продвинутые инструменты поиска помогут начинающему злоумышленнику подобрать необходимую информацию и найти ответы на базовые вопросы. Особенно авторы исследования обращают внимание на ситуацию в развивающихся странах, где компании и госучреждения защищены хуже.

Среди методов атак, где малоопытные злоумышленники применяют ИИ наиболее широко, авторы исследования выделили фишинг, социальную инженерию, атаки на веб-приложения и слабые пароли, SQL-инъекции, а также сетевой сниффинг. Они не требуют глубоких технических знаний и их легко осуществлять с помощью публично доступных инструментов.

Благодаря ИИ уже на текущем уровне технологий можно автоматически генерировать фрагменты вредоносного кода, фишинговые сообщения, разного рода дипфейки, которые делают более убедительными привычные сценарии атак социальной инженерии, автоматизировать отдельные этапы кибератак, среди которых авторы исследования особо выделили управление ботнетами. Однако развить и создать новые инструменты ИИ для автоматизации и масштабирования кибератак пока могут только опытные злоумышленники.

«Пока что ни об одной атаке нельзя сказать, что она была полностью проведена искусственным интеллектом. Тем не менее мир информационной безопасности постепенно движется к автопилотированию как в защите, так и в атаке. Мы прогнозируем, что с течением времени киберпреступные инструменты и модули с ИИ будут объединяться в кластеры для автоматизации все большего числа этапов атаки, пока не смогут покрыть большую часть шагов», — предупреждают авторы исследования.

Если злоумышленникам удастся автоматизировать проведение атак на выбранную цель, следующим шагом может стать применение инструментов для самостоятельного поиска целей. Опытным киберпреступникам ИИ даст инструментарий для сбора данных о потенциальных жертвах из разных источников, причем в короткие сроки.

ИИ активно применяется при эксплуатации уязвимостей, причем потенциал данных инструментов реализован еще далеко не полностью. ИИ помогает создавать ботов, с высокой степенью точности имитирующих поведение людей. Активно используются в ходе атак и дипфейки, которые уже достигли довольно высокого уровня правдоподобия. Их применяют в ходе атак как на обычных людей, так и на компании.

«Высокий потенциал искусственного интеллекта в кибератаках — не повод для паники, — комментирует ситуацию аналитик исследовательской группы департамента аналитики Positive Technologies Роман Резников. — Нужно реалистично смотреть в будущее, изучать возможности новых технологий и системно заниматься обеспечением результативной кибербезопасности. Логичная контрмера атакующему ИИ — более эффективный ИИ в защите, который поможет преодолеть нехватку специалистов для защиты от кибератак через автоматизацию многих процессов».