ИИ-бот OpenAI теперь умеет читать проекты, над которыми работают программисты в macOS-приложениях. Новая возможность снимает необходимость копипастить код в запросы к ChatGPT на оказание помощи в решении текущих проблем.

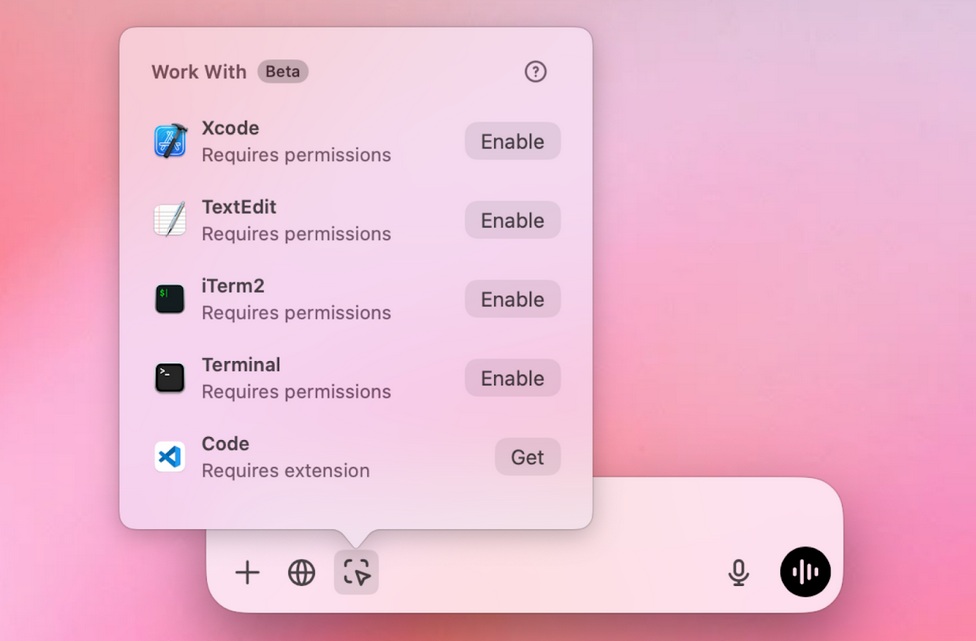

Механизм Work with Apps («Работа с приложениями») пока поддерживает VS Code, Xcode, TextEdit, Terminal и iTerm2. Бета-версия доступна пользователям ChatGPT Plus и Teams, тестирование в Enterprise и Edu запустят в следующем месяце; состоится ли порт на Windows, пока неизвестно.

Для работы с большинством перечисленных приложений ChatGPT требуется доступ к API специальных возможностей macOS (Accessibility); это разрешение всегда можно откатить в настройках чат-бота. Работа с VS Code потребует установки специального расширения.

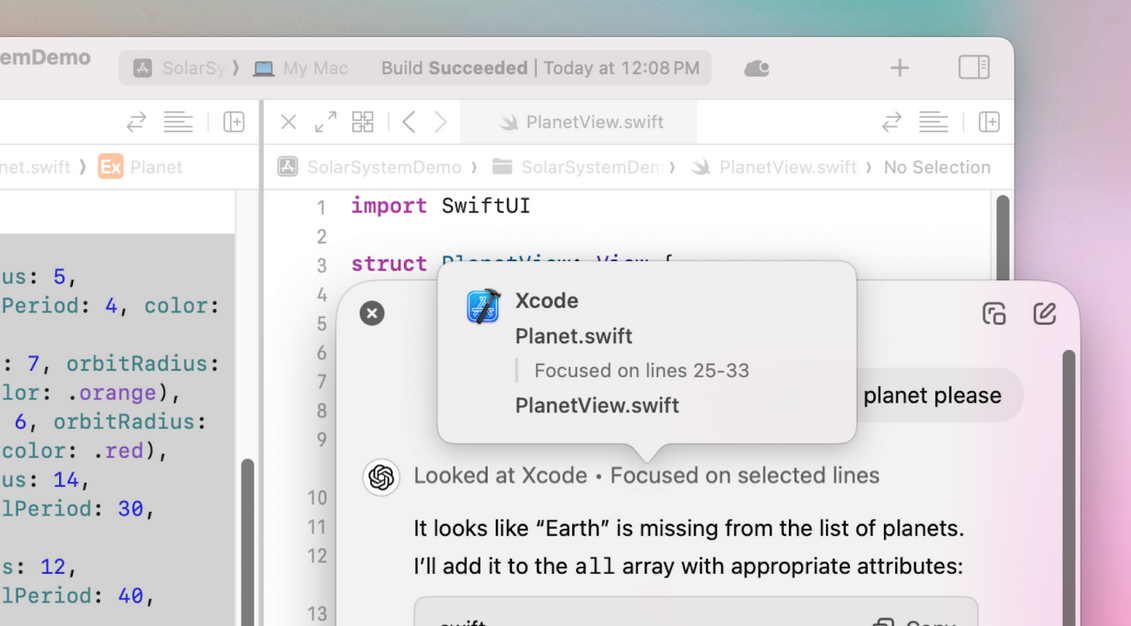

Когда функция активна, ChatGPT автоматически приобщает контент из приложения к входящему сообщению. Можно поставить фокус на определенном фрагменте кода, и умный помощник подскажет, как его скорректировать.

Так, в ходе тестов он помог исправить инструмент моделирования, создаваемый в Xcode: тот упорно исключал Землю из Солнечной системы. Написанная ИИ строка кода при этом соответствовала формату проекта.

К сожалению, вносить свои исправления в текущие разработки, как это делают Cursor или GitHub Copilot, чат-бот OpenAI пока не научился.

«Это [Work with Apps] не агент, а способ взаимодействия с инструментами программирования, список которых будет расширяться, — пояснил для TechCrunch руководитель по десктопным продуктам компании Александер Эмбирикос (Alexander Embiricos). — Думаю, он может стать ключевым элементом агентских систем. Суть в том, что ChatGPT понимает весь ваш контент и может помочь в работе с ним».

Нельзя не отметить, что бурный рост популярности ИИ, в том числе в России, несет в себе определенные риски. Большие языковые модели (БЯМ, LLM) могут взломать и заставить выдавать неправильные ответы; они не застрахованы от ошибок, к тому же склонны к галлюцинациям.

Расширение использования ИИ-помощников также грозит появлением новой зависимости. Привычка полагаться на подобные подпорки вполне может привести к снижению уровня знаний и навыков не только у профессионалов, но и у тех, кто идет им на смену.