Эксперты F.A.C.C.T. зафиксировали вредоносную рассылку, использующую имя Минцифры РФ. Злоумышленники запугивают россиян, побуждая загрузить инфостилера под видом сертификатов, без которых якобы 30 января отвалятся госуслуги и онлайн-банкинг.

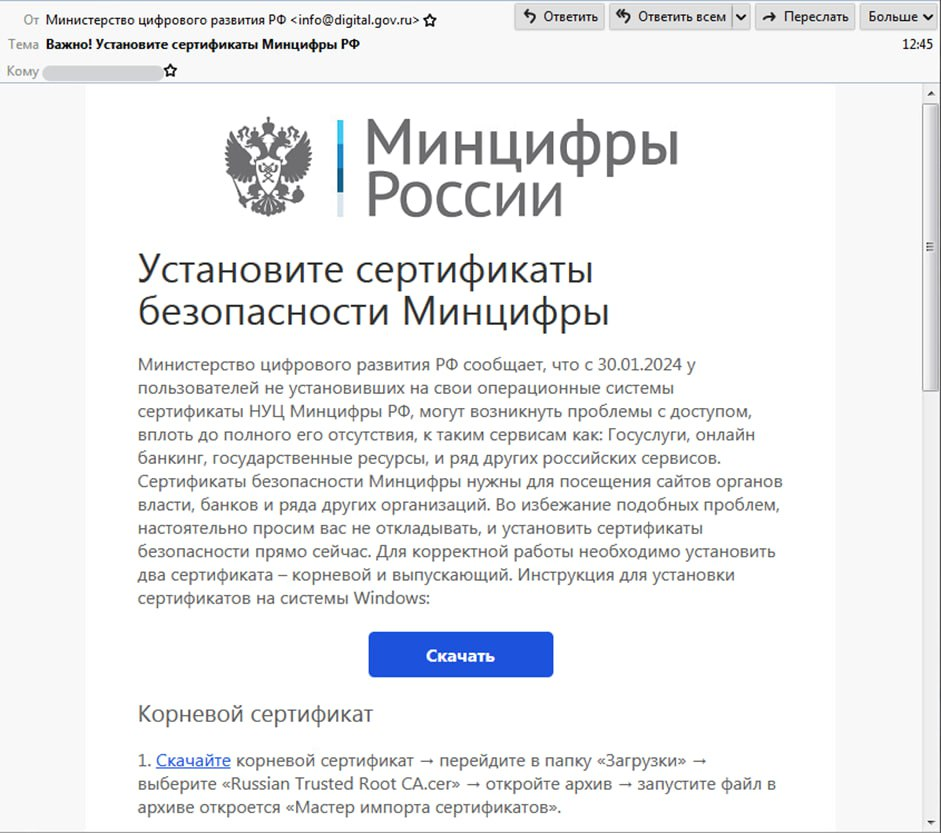

Поддельные письма, по словам аналитиков, выдержаны в стиле официального уведомления и написаны почти без ошибок. Чтобы скрыть истинный адрес отправителя, используется спуфинг.

При переходе по встроенной ссылке на машину жертвы загружается RAR-архив с двумя одинаковыми экзешниками — загрузчиком MetaStealer. Различаются лишь имена файлов, да и то незначительно: russian_trusted_root_ca.cer.exe и russian_trusted_sub_ca.cer.exe (вредоноса распознают 42 антивируса из 70 на VirusTotal по состоянию на 30 января).

Похитителя информации MetaStealer использует также APT-группа Sticky Werewolf, однако эксперты не обнаружили признаков ее причастности к данной рассылке. На черном рынке зловред доступен в двух версиях: для macOS и Windows.