Квантовые компьютеры, DeepFake и генеративный ИИ — Лаборатория кибербезопасности Сбера опубликовал объемный отчет о том, какие технологии будут влиять на кибербезопасность в ближайшие 10 лет. В документе 40 страниц, каждая технология имеет красный, желтый или синий уровень опасности.

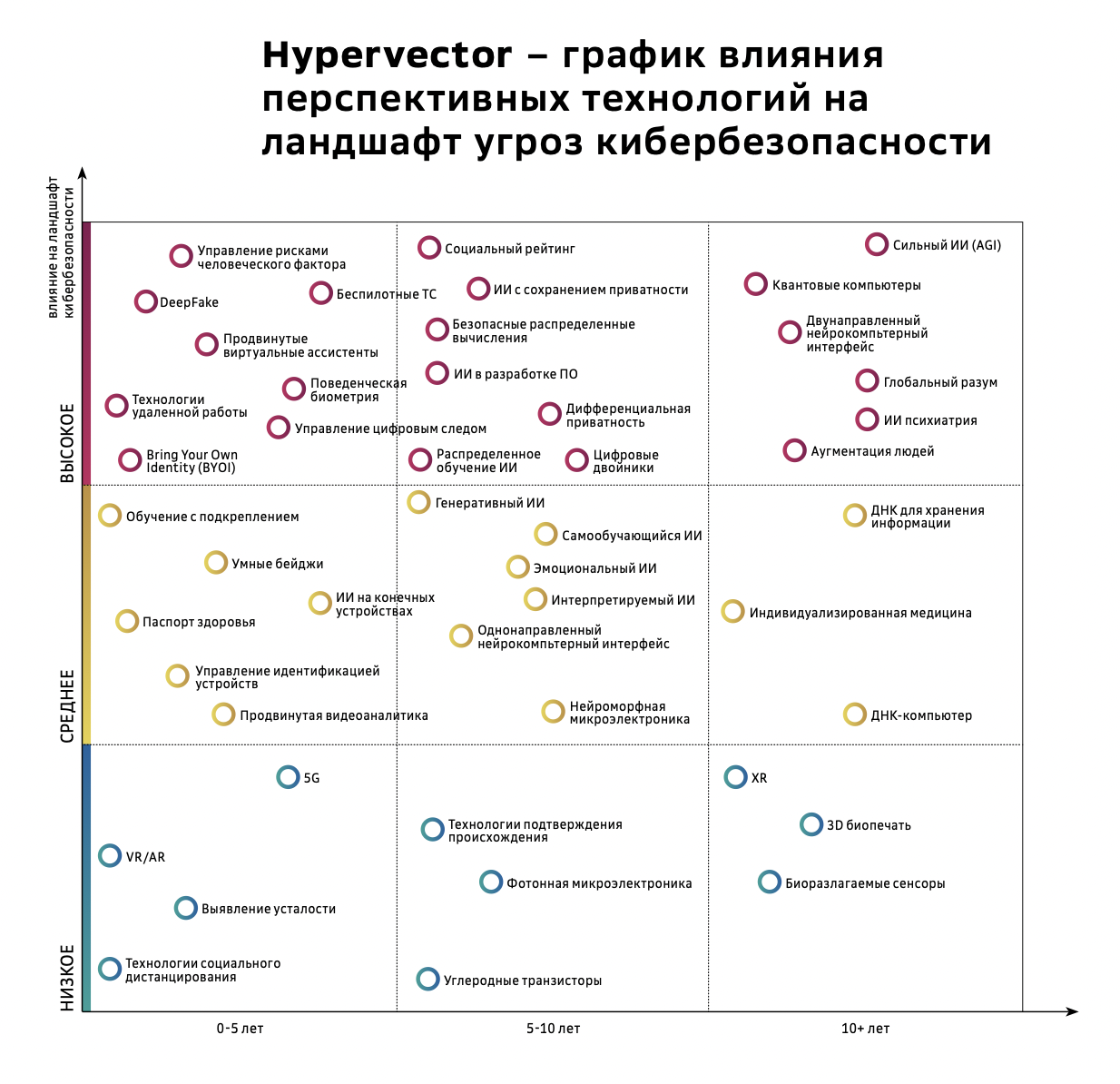

В аналитический отчёте (PDF) “Прогноз влияния перспективных технологий на ландшафт угроз кибербезопасности” три градации влияния той или иной новой технологии: от высокого (красного цвета) до низкого (сине-зеленого).

В Hypervector 2022 также указан временной период, когда технология, предположительно, достигнет зрелости и начнёт применяться массово.

Более того, для каждой из технологий приведены примеры возможных угроз или её использования в кибербезопасности.

1. Горизонт до 5 лет: Управление рисками человеческого фактора, так как проблема противодействию атакам на человека является крайне актуальной как для отдельных компаний, так и для индустрии кибербезопасности в целом.

В этот период потребуется выработка методов оценки подверженности различным рискам, эффективного обучения тактикам противодействия угрозам и выработки навыков кибергигиены у сотрудников и клиентов.

2. Горизонт 5-10 лет: ИИ с сохранением приватности и безопасные распределенные вычисления.

Технологии напрямую касаются безопасности данных и их исследование и разработка поможет компаниям реализовать новые сервисы, связанные с предоставлением доступа и обменом данными и обучением более точных и масштабных моделей ИИ, не порождая угроз нарушения приватности и конфиденциальности.

3. Горизонт более 10 лет: Artificial General Intelligence (AGI), так как возникновение этой технологии способно породить масштабные угрозы (вплоть до экзистенциальных) как в кибербезопасности, так и за ее пределами.

Также AGI способен оказать существенное влияние на саму сферу кибербезопасности в случае его применения для защиты от угроз.

Большинство из рассмотренных в отчете технологий можно отнести к одной из трех категорий: технологии ИИ, технологии вычислений, технологии взаимодействия с вычислительными устройствами, приходят к выводам исследователи.

По мнению экспертов, именно их развитие будет оказывать наиболее существенное влияние на развитие других сопутствующих технологий и возможностей их применения в различных сферах жизни, экономики и бизнеса.