Расширения и приложения DuckDuckGo теперь блокируют всплывающие окна Google, предлагающие аутентифицироваться с помощью Google Аккаунта. По словам разработчиков, задача — уберечь пользователей от надоедливых pop-up и усилить их конфиденциальность.

Напомним, за DuckDuckGo не только одноимённый поисковик, но ещё и сервис электронной почты (как с помощью сервиса DuckDuckGo защитить E-mail от слежки), мобильные приложения и расширения для браузеров.

Более того, в октябре вышла первая публичная бета-версия собственного браузера DuckDuckGo для macOS.

Вчера вечером в Twitter компания сообщила о нововведении: теперь все аддоны и приложения блокируют всплывающие окна Google, в которых предлагается аутентифицироваться на сайтах с помощью аккаунта в системе интернет-гиганта.

Безусловно, кому-то это может показаться удобным. Вам не нужно создавать новую учётную запись, вы просто заходите на сайт через Google Аккаунт. Но у такого подхода есть и минусы: страдает конфиденциальность, поскольку Google может в этом случае отслеживать активность в веб-приложениях и на сайтах.

Различные тесты DuckDuckGo показали, что Google собирает данные, хотя и не использует их в рекламных целях.

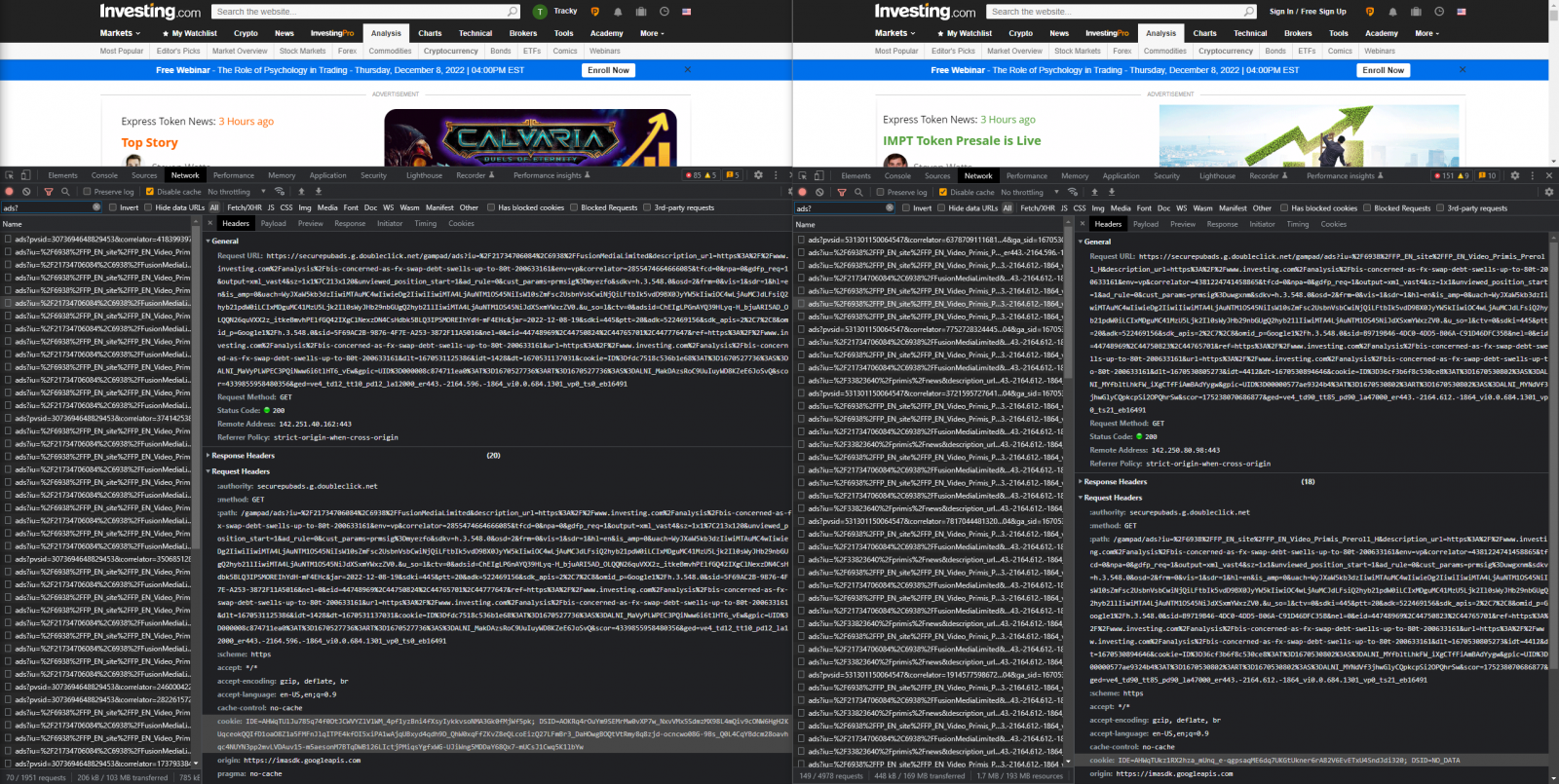

Например, в одном из случаев (на ресурсе investing.com) Google отправляла множество запросов на https://securepubads.g.doubleclick.net/gampad/ads?. В DuckDuckGo считают такое поведение рисками для конфиденциальности.