Эксперты в области кибербезопасности рассказали об интересном методе, который позволяет получить контроль над аккаунтами пользователей WhatsApp, а также добраться до их личных сообщений и списков контактов. Трюк рассчитан на переадресацию вызовов и отправку одноразового пароля посредством звонка.

Как известно, операторы связи позволяют переадресовывать вызовы на другие телефонные номера, а мессенджер WhatsApp допускает отправку кодов верификации через вызов.

Основатель и гендиректор компании CloudSEK Рахул Саси предупреждает, что с помощью этих двух составляющих злоумышленники могут получать контроль над WhatsApp-аккаунтами пользователей.

Исследователи из BleepingComputer подтвердили, что метод рабочий, однако воспользоваться им смогут только подготовленные хакеры. В целом процесс взлома занимает несколько минут, однако стоит учитывать, что атакующему необходимо знать номер жертвы и применить социальную инженерию.

Прежде всего, по словам Саси, злоумышленник должен убедить жертву позвонить на телефонный номер, который содержит MMI-код (Man Machine Interface). Такие коды, начинающиеся со «звёздочки» и заканчивающиеся «решёткой», операторы связи используют для включения переадресации вызовов.

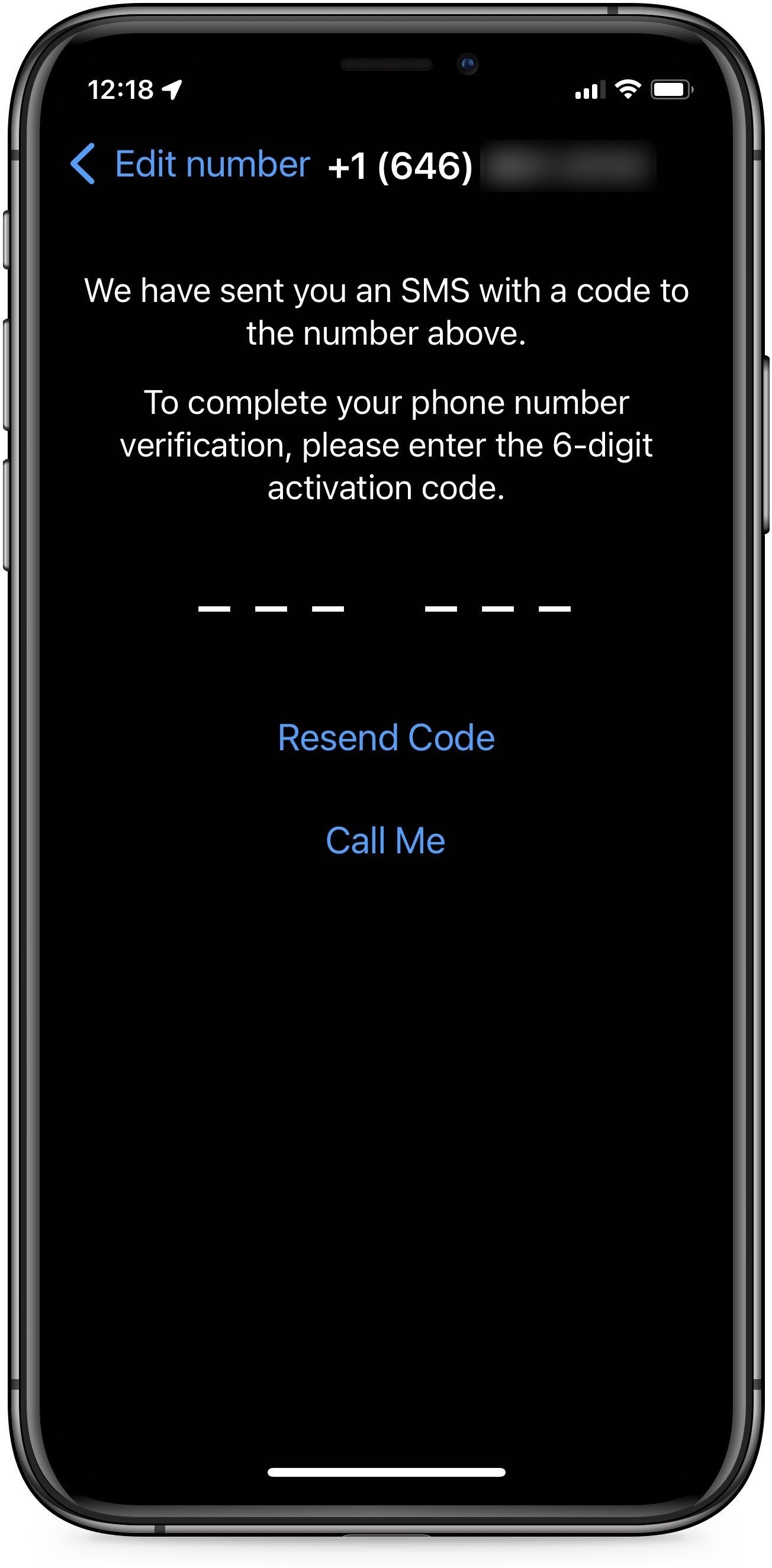

«Сначала вы получаете звонок от атакующего, который убеждает вас позвонить на номер, начинающийся с **67*10 или *405*10. В течение буквально нескольких минут вы выйдете из учётки WhatsApp, а злоумышленник получит полный контроль над ней», — объясняет специалист.

Суть в том, что атакующий входит в аккаунт с помощью доставки кода верификации посредством звонка от службы WhatsApp. Единственное серьёзное препятствие в этой схеме можно легко обойти, владея методами социальной инженерии.

Защититься от этого вектора проще некуда — достаточно активировать двухфакторную аутентификацию (2FA) в WhatsApp.