Исследователи продемонстрировали, по их словам, «первую бесконтактную атаку на ёмкие сенсорные экраны». Метод получил имя “GhostTouch“, а его суть заключается в использовании электромагнитных помех (EMI) для имитации нажатий на сенсорных экранах.

О GhostTouch рассказали исследователи из Дармштадтского и Чжэцзянского университетов. Согласно описанию в соответствующем отчёте, техника избавляет условного атакующего от необходимости иметь физический доступ к устройству для нажатий на экране.

Электромагнитные помехи злоумышленник может задействовать для отправки команд не только «тапов», но и свайпов (пролистывания) в определённом месте сенсорного экрана. С помощью этого вектора атакующий может управлять целевым девайсом.

GhostTouch работает на расстоянии до 40 мм и опирается на чувствительность сенсорных экранов к электромагнитным помехам. Идея сводится к инъекции таких сигналов в прозрачные электроды, встроенные в сенсорный экран. Именно так можно регистрировать события касаний экрана.

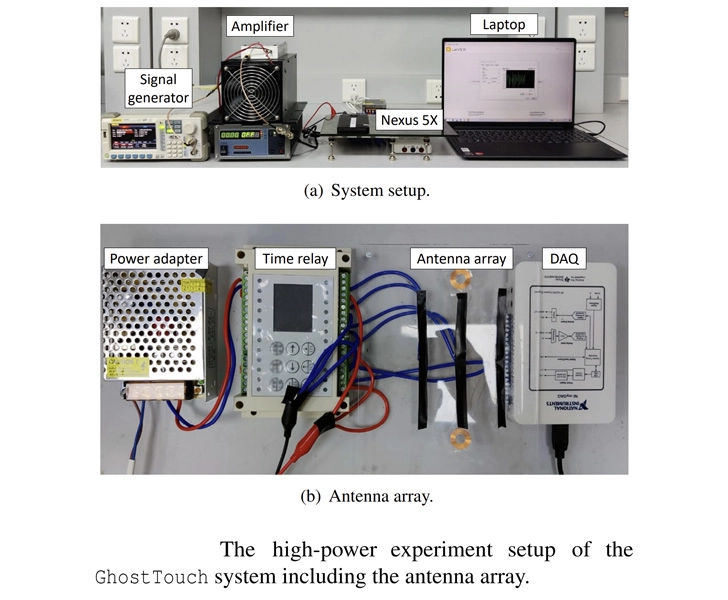

Набор для тестирования GhostTouch, который использовали исследователи, включал электростатическую пушку для генерации сильного сигнала, который впоследствии отправлялся на антенну для передачи электромагнитного поля на сенсорный экран телефона.

Манипулируя сигналом, можно вызывать различные события: нажатие, нажатие и удерживание, свайп. Простейший пример реализации: злоумышленник может подключить устройство пользователя к сомнительной сети Wi-Fi, заставить девайс пройти по вредоносной ссылке и даже ответить на телефонный звонок.

Специалисты выяснили, что к GhostTouch уязвимы следующие модели смартфонов: Galaxy A10s, Huawei P30 Lite, Honor View 10, Galaxy S20 FE 5G, Nexus 5X, Redmi Note 9S, Nokia 7.2, Redmi 8 и iPhone SE (2020 года выпуска).