Рост цен на оперативную память уже дошёл до того, что люди начали задаваться почти философским вопросом: а можно ли вообще запустить компьютер без RAM? Именно это решил проверить YouTube-блогер PortalRunner. Интересно, что ответ оказался не совсем отрицательным.

Компьютер без оперативной памяти действительно можно заставить работать, но радоваться тут особенно нечему: пользоваться такой машиной в реальной жизни почти невозможно.

По сути, весь эксперимент быстро превращается в наглядное объяснение, зачем вообще нужна RAM и почему без неё современный десктоп моментально откатывается куда-то в далёкое прошлое.

Для начала PortalRunner попробовал обойтись минимальным объёмом памяти и переложить нагрузку на своп-файл. Другими, словами заставить систему активнее использовать накопитель вместо оперативки. Формально такой сценарий и так знаком любому компьютеру, когда RAM заканчивается, но на практике это работает мучительно медленно.

Была и ещё одна попытка — использовать вместо обычной RAM видеопамять со старых видеокарт. Звучит изобретательно, но итог примерно тот же: скорость всё равно не та, а полноценной заменой оперативной памяти такой подход не становится.

Самая забавное начинается позже, когда автор эксперимента решает зайти с другой стороны и использовать только кеш процессора. Он действительно намного быстрее обычной оперативки, но его катастрофически мало по современным меркам. Речь тут идёт не о гигабайтах, а о десятках мегабайт — объёме, который для 2026 года выглядит почти музейным.

В итоге эксперимент неожиданно превращается в путешествие во времени. Чтобы уложиться в такие ограничения, приходится буквально вспоминать подходы из 1980-х: ручную оптимизацию ассемблерного кода, предельно простую графику, минимализм во всём. Современный софт в такие рамки просто не помещается, поэтому запускать приходится что-то совсем крошечное.

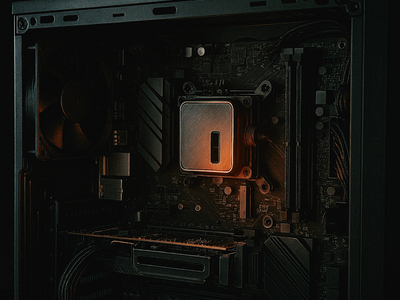

И да, в финале всё это всё-таки заработало. После долгих манипуляций со старой материнской платой, BIOS и кучей низкоуровневой магии PortalRunner сумел запустить программу, работающую исключительно в кеше процессора. Этой программой оказалась Snake, что, в общем, довольно символично. Не Photoshop, не браузер, не Windows, а старая добрая «змейка».

Отдельная ирония в том, что для такого эксперимента пришлось искать довольно старое железо. На новых платах с UEFI подобные трюки провернуть заметно сложнее. Более того, одна из попыток вообще закончилась неудачной прошивкой BIOS и фактически убитой машиной.