Исследователь в области кибербезопасности, известный как Chaotic Eclipse или Nightmare Eclipse, опубликовал демонстрационные эксплойты (proof-of-concept) для двух пока не исправленных уязвимостей в Microsoft Windows. Новые баги получили названия YellowKey и GreenPlasma: первый позволяет обойти BitLocker, второй связан с повышением привилегий.

YellowKey исследователь описывает почти как «бэкдор» в BitLocker. Проблема проявляется в среде восстановления Windows — WinRE.

По словам автора, уязвимость затрагивает Windows 11, Windows Server 2022 и Windows Server 2025 и может дать доступ к зашифрованному диску без привычной аутентификации.

Независимый исследователь Кевин Бомонт подтвердил работоспособность YellowKey и рекомендовал использовать ПИН-код для BitLocker и пароль BIOS как меры снижения риска. Однако сам Chaotic Eclipse утверждает, что настоящая первопричина проблемы шире, а сценарий атаки якобы возможен даже при TPM+PIN — правда, этот вариант PoC он не опубликовал.

Аналитик Уилл Дорманн из Tharros Labs также подтвердил, что YellowKey является вполне рабочим эксплойтом. По его словам, проблема связана с обработкой NTFS-транзакций в связке со средой восстановления Windows. В результате вместо обычного WinRE может открыться командная строка, причём диск к этому моменту уже остаётся разблокированным.

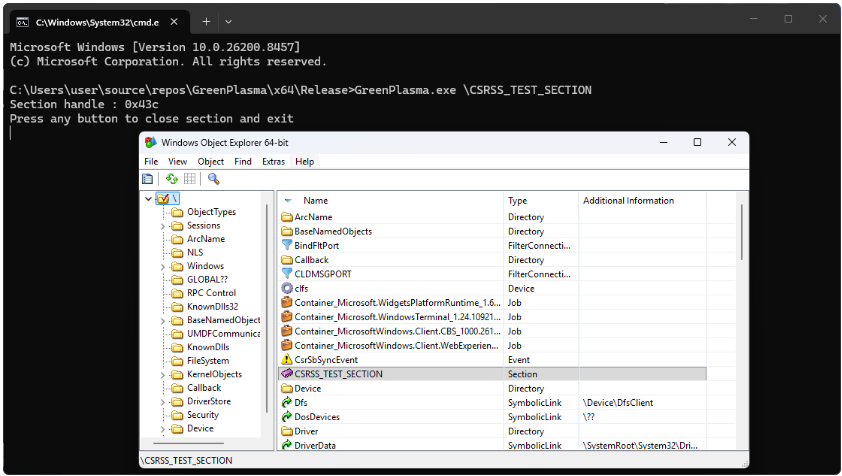

Вторая уязвимость, GreenPlasma, относится к повышению прав. Исследователь описывает её как проблему в Windows CTFMON, позволяющую непривилегированному пользователю создавать определённые объекты памяти в доверенных местах. Выложенный PoC неполный, но автор прямо намекает: достаточно умные смогут довести его до полноценного получения SYSTEM.

Это уже не первый выпад Chaotic Eclipse против Microsoft. Ранее он раскрывал BlueHammer и RedSun — локальные уязвимости повышения прав, которые, по сообщениям, вскоре начали эксплуатироваться в реальных атаках. Причина публичных сливов, по словам исследователя, всё та же: недовольство тем, как Microsoft обрабатывает баг-репорты.

Более того, к следующему вторнику патчей исследователь анонсировал для компании большой сюрприз.