Злоумышленники начали использовать новую двухэтапную схему для кражи учётных записей на Госуслугах и в онлайн-банках. Формальным поводом для запуска атаки служит якобы обновление медицинских данных. Эта схема применяется не только против россиян, но и против граждан Белоруссии.

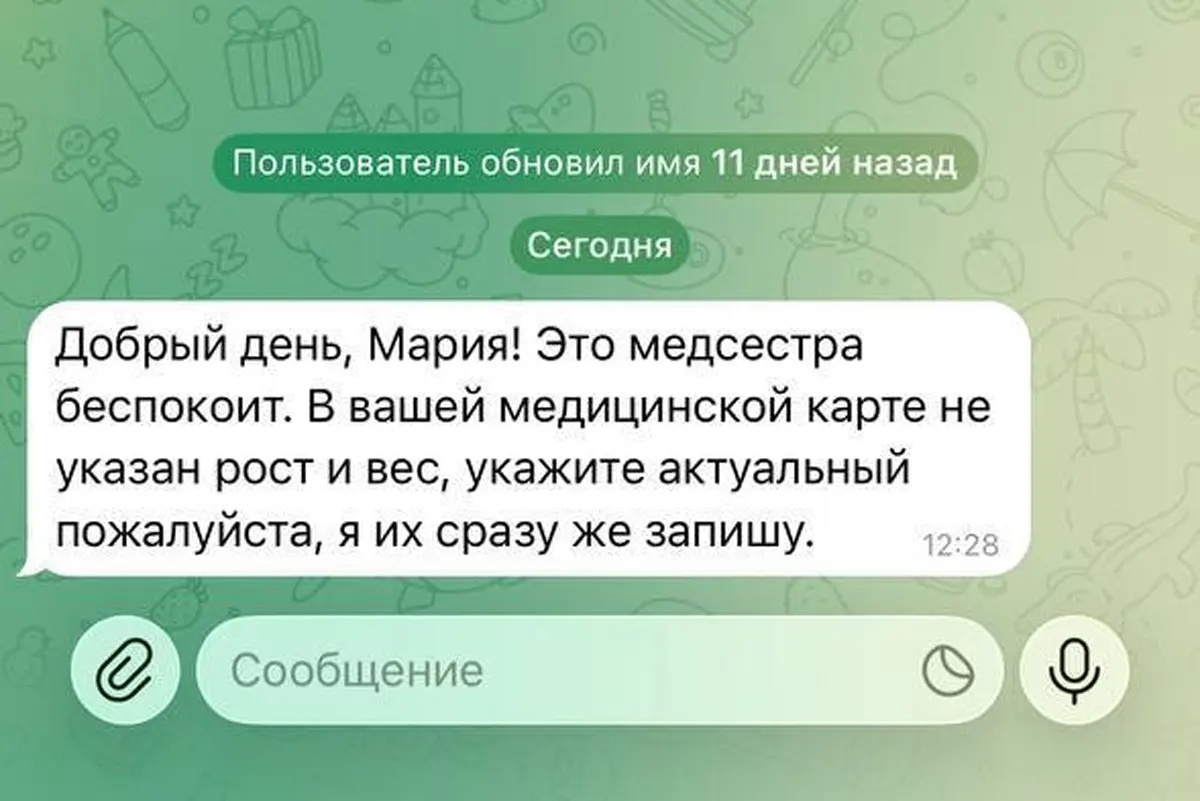

Как сообщает РИА Новости, обычно мошенники выходят на связь через мессенджеры, чаще всего через Telegram. Похожая схема также получила распространение в Белоруссии, о чём сообщают местные СМИ и ряд территориальных органов МВД страны.

На первом этапе злоумышленники представляются медицинскими работниками. Под предлогом обновления данных медицинской карты они просят сообщить возраст, рост, вес, а также пожаловаться на самочувствие. После этого лже-медик просит указать в чате номер телефона, на который якобы поступит голосовой звонок для подтверждения данных.

Затем начинается вторая фаза. В разговор вступает якобы сотрудник Госуслуг, который сообщает о попытке взлома аккаунта. Он просит назвать код из СМС, который на самом деле используется для получения доступа к учётной записи на Госуслугах или в личном кабинете онлайн-банка.

Встречаются и другие варианты развития схемы. Например, вместо сотрудника Госуслуг с жертвой может связаться лже-сотрудник правоохранительных органов. Такой сценарий особенно распространён в Белоруссии, но встречается и в России.

Как отметил депутат Госдумы Сергей Леонов, в некоторых случаях мошенники начинают атаку не с переписки, а с голосового звонка. В качестве повода может использоваться приглашение на диспансеризацию.

«Настоятельно рекомендую быть бдительными. Если вам поступил звонок от поликлиники якобы с приглашением на диспансеризацию и просьбой назвать данные паспорта и СНИЛС для этого, то кладите сразу же трубку. Ни в коем случае не называйте никакие персональные данные. Тем более не называйте никогда код из СМС якобы для подтверждения записи к врачу — это мошенники. Лучше сразу положить трубку, найти телефон поликлиники на сайте и перезвонить напрямую», — такие рекомендации дал депутат.

«Каждый код — это открытие доступа аферистам в вашу жизнь», — напомнила официальный представитель МВД России Ирина Волк.

Первые попытки использования этой схемы были зафиксированы в Ростовской области ещё в декабре. Тогда мошенники допускали много несоответствий — например, использовали номера других регионов, что вызывало подозрения у потенциальных жертв.

В конце марта злоумышленники снова активизировали эту тему. Так, 24 марта о новой волне таких атак писала газета «Тульская пресса».

Кроме того, в январе уже фиксировалось несколько волн атак, направленных на кражу аккаунтов на Госуслугах. Тогда для этого использовались телеграм-боты, а предлогами служили актуализация данных для компаний в сфере ЖКХ или акции маркетплейсов.