В среду Google объявила о том, что по соображениям безопасности Gmail скоро запретит пользователям прикреплять файлы JavaScript (.js) как вложения в электронные письма. В настоящее время существуют более двух десятков потенциально опасных типов файлов, которые не могут быть использованы в качестве вложений в Gmail, в том числе .exe, .jar, .sys, .scr, .bat, .com, .vbs и .cmd. Начиная с 13 февраля 2017 года, .js-файлы также будут добавлены в этот список.

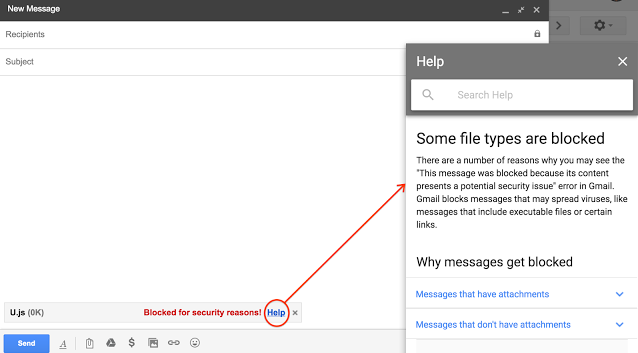

Люди, которые попытаются прикрепить этот тип файлов, увидят сообщение, информирующее их о том, что файл был заблокирован из соображений безопасности.

В тех случаях, когда пользователям необходимо отправить .js файлы по уважительным причинам, Google использовать Drive, Cloud Storage или другие услуги общего доступа к файлам.

В последнее время было замечено несколько кампаний по распространению вредоносных программ, в ходе которых злоумышленники прикрепляли JavaScript-файлы как вложения к письмам. Стоит вспомнить хотя бы кампанию по распространению шифровальщика Locky, JavaScript-файл, прикрепленный к письму, использовался в ней как загрузчик (downloader).

Вымогатели (ransomware) все чаще распространяются при помощи JavaScript-файлов, например, Ransom32, RAA. Поэтому нет ничего удивительного в том, что Google решили запретить прикреплять этот тип файлов в качестве вложений.