В последнее время авторов вымогательского ПО и шифровальщиков то и дело постигают неудачи. То вирусные аналитики за пару дней разгадают алгоритм шифрования и выпустят инструмент для расшифровки файлов.

То сами создатели малвари допустят ошибку, и в итоге их детище работает не совсем так, как было запланировано. Специалисты Trend Micro обнаружили новый яркий пример, относящийся ко второй категории фэйлов. Авторы вымогателя RANSOM_CRYPTEAR.B не только взяли за основу чужой код, но и умудрились его испортить.

В августе 2015 года турецкая команда исследователей Otku Sen опубликовала на GitHub исходный код вымогательской малвари Hidden Tear, созданной исключительно в образовательных и научных целях. Авторы Hidden Tear рассказали в своем блоге, что Hidden Tear был ловушкой для ленивых хакеров, которые вместо написания собственного вымогателя решат позаимствовать код чужого. Эксперты уверяли, что в коде Hidden Tear заложена уязвимость, которая позволит им беспрепятственно расшифровать файлы потенциальных жертв (если до такого дойдет), сообщает xakep.ru.

Компания Trend Micro сообщает, как минимум один хакер клюнул на приманку исследователей. Специалисты компании обнаружил вымогательское ПО RANSOM_CRYPTEAR.B. В декабре 2015 года авторы этого вредоноса взломали неназванный парагвайский сайт и использовали ресурс для переадресации пользователей на фальшивую страницу, якобы предлагающую скачать обновление для Adobe Flash Player. Разумеется, вместо обновления жертва скачивала и устанавливала на свой компьютер шифровальщика.

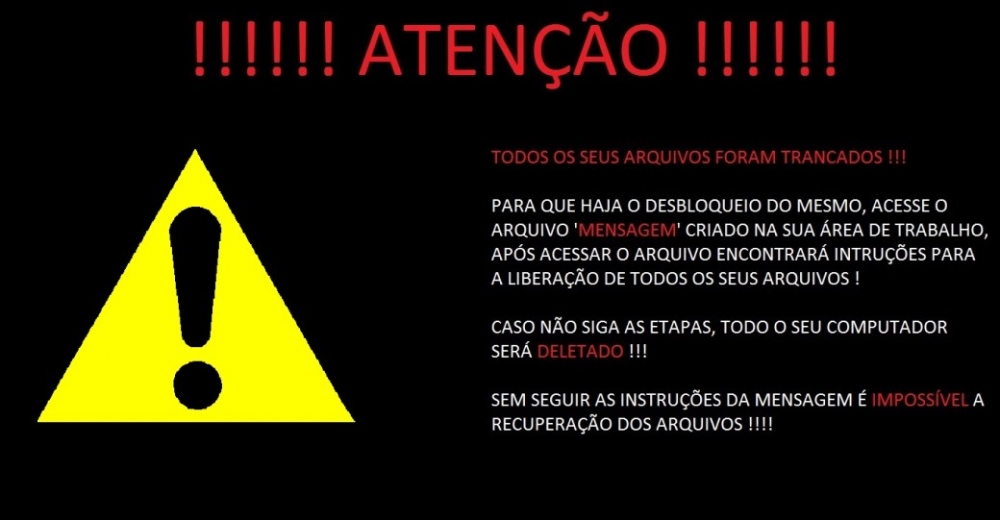

Основу кода RANSOM_CRYPTEAR.B составляет код Hidden Tear, однако хакеры, очевидно, решили внести в него некие улучшения. В частности, шифровальщик научили демонстрировать сообщение с требованием выкупа на португальском языке, заменяя угрозой обои на рабочем столе пользователя.

Еще одно изменение в коде касается ключей шифрования, и не совсем ясно – допустили ли хакеры ошибку, или поступили так намеренно. Дело в том, что теперь шифровальщик попросту выбрасывает ключ шифрования, а не отправляет его на командный сервер. Даже если исследователи из Otku Sen действительно встроили в Hidden Tear некий бэкдор, теперь он бесполезен. Расшифровать файлы, не имея ключа, попросту невозможно. Эксперты Trend Micro полагают, что виной всему халатность хакеров, и баг закрался в код случайно.

Даже если это в самом деле ошибка, а не злой умысел, мошенники вряд ли расстроятся. На их деятельность баг никоим образом не влияет: сообщение с требованием выкупа отображается корректно (хакеры требуют около $500), файлы шифруются, деньги на Bitcoin-кошелек поступают.

Комментариев от настоящих авторов малвари – команды Otku Sen пока не поступало.

Это не первый случай, когда файлы невозможно восстановить после заражения шифровальщиком. В ноябре прошлого года был замечен вымогатель Power Worm, который точно так же терял в процессе ключ шифрования, что делало восстановление данных невозможным.