омпания RSA Research провела тщательное расследование активности необычной VPN-сети, имеющей китайское происхождение. Ее назвали Terracotta. Как выяснилось, сеть использовали в качестве платформы для проведения таргетированных атак различные хакерские группы, включая хорошо известную группу Shell_Crew / Deep Panda.

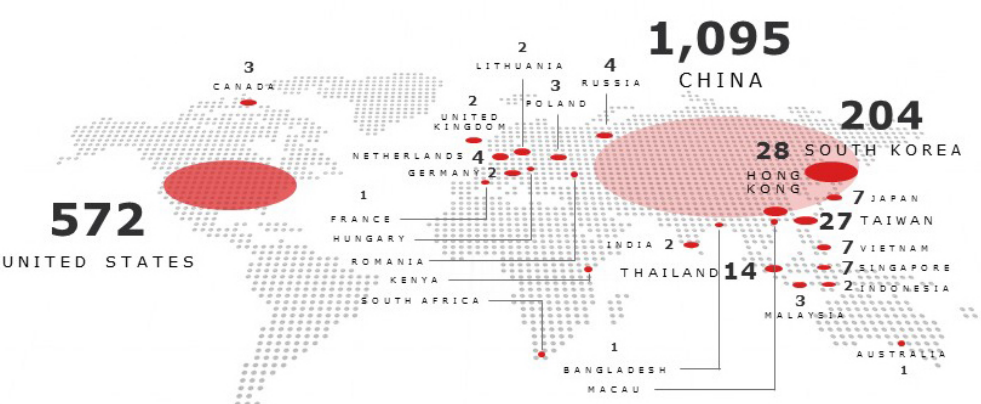

Terracotta состоит из 1500+ VPN-узлов по всему миру, которые собраны в сеть с помощью взломов недостаточно защищенных Windows-серверов обычных организаций без их ведома и разрешения. Новые жертвы добавлялись постоянно, так что сеть росла и обновлялась, пишет xakep.ru.

Многие крупные организации, потенциальные жертвы таргетированных атак, в целях защиты часто ограничивают или блокируют соединения с известными IP-адресами коммерческих VPN-сетей. В данном случае хакеры эффективно обходили эту защиту, потому что Terracotta по своей сути кардинально отличалась от коммерческих VPN-сетей.

Для потенциальной жертвы трафик с узла Terracotta казался таким же законным, как трафик от законной местной организации, хотя на самом деле у той организации уже был инфицированный сервер.

Что самое интересное, нет никаких свидетельств, что операторы сети Terracotta сами участвовали в таргетированных атаках или связаны с их участниками. Это был с виду нормальный коммерческий сервис, который рекламировался в Китае под разными брендами. Он даже предлагал услуги обхода Великого китайского файрвола и анонимизации пользователей. В Китае действует несколько таких же дешевых сервисов (у Terracotta тариф был три доллара в месяц). Полулегальный скрытный статус VPN-узлов Terracotta служил отличным прикрытием, потому что именно это требовалось участникам таргетированных атак.

Нужно признать, что и маркетинг Terracotta хорошо работал: у них были реальные клиенты, которые генерировали реальный трафик по пробитию файрвола. Этот трафик служил маскировкой для активности хакеров.

В отчете компания RSA Research опубликовала информацию, какую удалось собрать о Terracotta к настоящему моменту, включая анализ сети, анализ вредоносного кода, некоторые следы активности хакерских групп, которые участвовали в таргетированных атаках, и др.