На большей части территории России перестал работать сервис каршеринга «Делимобиль». Пользователи сообщают о проблемах с мобильным приложением и веб-сайтом сервиса: из-за сбоя не удаётся завершить аренду автомобиля. В ряде случаев машины оказались заблокированными прямо во время поездки.

Как отмечают пользователи в комментариях, дозвониться до технической поддержки также невозможно.

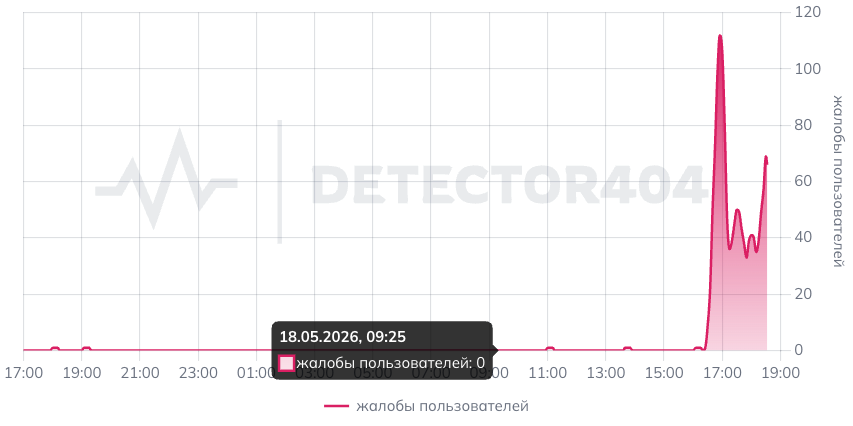

По данным сервиса Detector404, волна жалоб начала резко расти примерно с 17:00 по московскому времени.

Поступают и сообщения о блокировке автомобилей. «Не завершается аренда, не даёт закончить поездку, но машина заблокировала двери», – написал один из пользователей в комментариях на Detector404. Подобные жалобы не единичны. О случаях блокировки автомобилей в разных городах сообщают и СМИ.

Как отмечает сервис «Не работает сегодня», проблемы с работой «Делимобиля» затронули практически всю страну — от Калининграда до Анадыря. Характер жалоб в целом одинаковый: пользователи не могут открыть приложение, завершить аренду или связаться с поддержкой.