Эксперты «Лаборатории Касперского» зафиксировали случаи рассылки поддельных приглашений на популярную социальную сеть Google+. Так хакеры отреагировали на возникший ажиотаж вокруг новой социальной сети, воспользовавшись им для кражи личных данных пользователей.

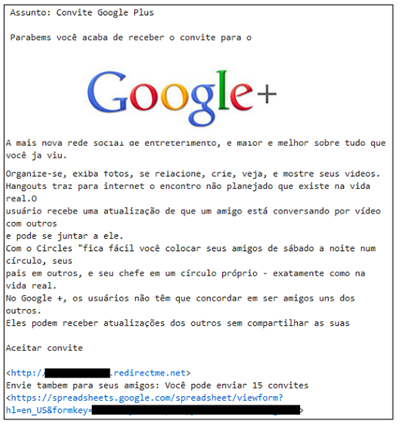

Например, вот такое сообщение получали пользователи из Португалии:

Проходя по ссылке, пользователь попадает на сайт google****.redirectme.net, с которого и запускалось скачивание распространенной троянской программы Trojan Banker, предназначенной для кражи пользовательской информации, относящейся к банковским системам, системам электронных денег и пластиковых карт, сообщаетИнформационная служба «Лаборатории Касперского».

В сообщении также содержится ссылка на документ Google Docs, которая предлагает отправить приглашение на Google+ своим друзьям. Однако на самом деле эта поддельная форма предназначена для сбора имен и почтовых адресов для дальнейшего распространения аналогичных «приглашений»:

«Злоумышленники часто играют на человеческом любопытстве и доверчивости, – говорит Фабио Ассолини, эксперт «Лаборатории Касперского». – В данном случае жертва сама переходит по зловредной ссылке, заражая свой компьютер. Если вы хотите присоединиться к сети Google+, будьте начеку и открывайте письма только от своих знакомых, с которыми вы заранее договорились о таком приглашении».