На общественное обсуждение вынесен проект приказа Минцифры, который упрощает сбор биометрических данных для людей с выраженными дефектами лица и речи, а также для полностью немых. Этот документ должен заменить приказ Минцифры № 453, принятый в мае 2023 года и регламентирующий порядок сбора биометрии.

Проект размещён на портале проектов нормативных правовых актов.

Согласно действующему приказу, при сборе биометрических данных не предусмотрено никаких исключений, в том числе при фотографировании лица и записи образцов голоса. На практике это создаёт серьёзные препятствия для людей с выраженными нарушениями речи или для полностью немых.

«Текущий сценарий регистрации биометрических данных в Единой биометрической системе (ГИС ЕБС) не позволяет корректно разместить биометрические данные физических лиц с врождёнными или приобретёнными особенностями речевой функции», — говорится в пояснительной записке к документу.

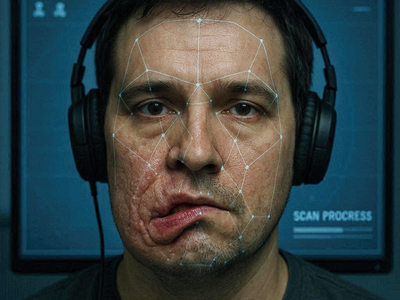

Новый приказ допускает регистрацию биометрии без записи образца голоса. Кроме того, для людей с выраженными дефектами лица — например, пигментными пятнами, шрамами, последствиями травм или аномалиями развития — предлагается разрешить сбор биометрических данных по одной модальности.

Использование биометрии уже подтвердило свою надёжность как инструмента идентификации и аутентификации. Так, согласно данным банка ВТБ, случаи хищения средств были зафиксированы лишь у 0,0025% клиентов, использующих этот способ.