Управление по организации борьбы с противоправным использованием инфокоммуникационных технологий МВД России (УБК МВД) предупредило о массовых фишинговых атаках, связанных с оплатой проезда по платным дорогам.

Как сообщил официальный телеграм-канал профильного главка МВД «Вестник киберполиции России», фишинг под видом оплаты платных дорог стал одним из наиболее распространённых сценариев атак. В частности, в зоне риска оказался Московский скоростной диаметр (МСД).

«Злоумышленники создают сайты, визуально почти неотличимые от официальных, которые индексируются в поисковых системах. После ввода реквизитов банковской карты и суммы платежа деньги списываются, однако проезд так и остаётся неоплаченным. Полученные данные карт впоследствии используются мошенниками в личных целях», — говорится в сообщении УБК МВД.

За последний месяц было заблокировано более 10 фишинговых ресурсов, внешне практически не отличимых от настоящих (например, с адресами вроде msd-avtodor-tr, msdmoss). Максимальный зафиксированный ущерб для одного пользователя составил 22 тысячи рублей.

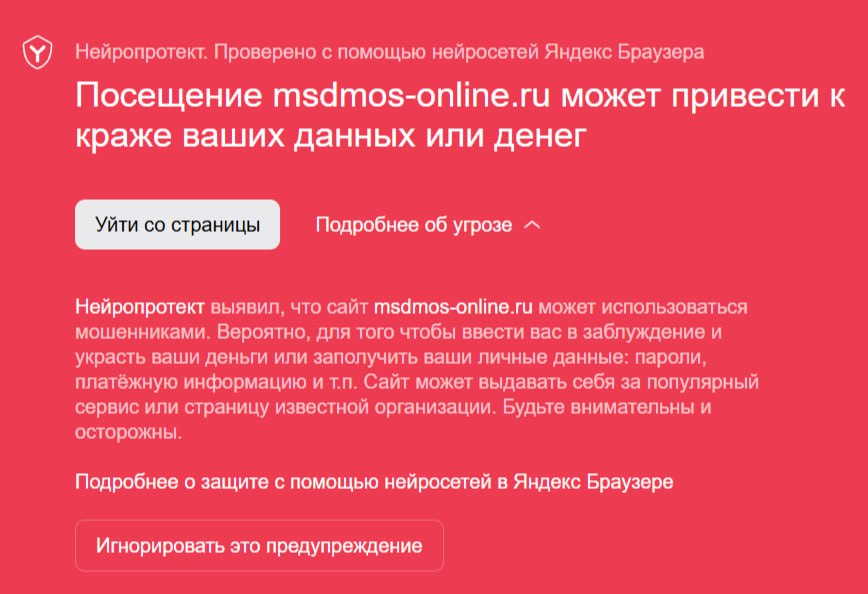

УБК МВД рекомендует не игнорировать предупреждения браузеров и защитных систем о фишинговых сайтах. Безопасную оплату проезда следует осуществлять через портал Госуслуг, приложение «Парковки России» или официальные банковские приложения.

Фишинг остаётся одной из основных киберугроз последних лет — как для частных пользователей, так и для бизнеса. Особенно опасными становятся фишинговые атаки с применением генеративного искусственного интеллекта: по своей эффективности они всё больше приближаются к целевым атакам.