Mozilla выпустила Firefox 151, в браузере заметно обновили интерфейс, усилили защиту от отслеживания и добавили несколько функций, которые действительно могут пригодиться. Главное визуальное изменение — переработанная домашняя страница Firefox Home и новый экран вкладки.

Mozilla говорит, что это подготовка к будущим функциям, которые появятся в Firefox 151 и 152: виджетам и улучшенным ярлыкам. Заодно добавили новые обои, которые можно настраивать прямо со страницы новой вкладки.

С приватностью тоже подкрутили гайки. В Firefox 151 усилили защиту от фингерпринтинга в стандартном режиме Enhanced Tracking Protection. По оценке Mozilla, объём данных, по которым сайты могут уникально идентифицировать пользователя, снизился примерно на 14% в целом и почти на 49% на macOS.

Короче, сайтам станет чуть сложнее собирать ваш цифровой портрет по кусочкам.

Ещё одна полезная штука — кнопка End Private Session. Теперь можно мгновенно стереть данные приватного просмотра, не закрывая всё окно. Для тех, кто держит приватный режим открытым постоянно, это выглядит как маленькая, но очень правильная кнопка.

Встроенный просмотрщик PDF тоже стал умнее: Firefox 151 теперь умеет объединять несколько PDF-файлов прямо в браузере. Без отдельной утилиты, без загрузки документов на мутные сайты.

Пользователи Linux получили локальные резервные копии профиля, раньше эта функция была доступна только в Windows. На macOS Firefox научился корректно вставлять URL, скопированные с iPhone через Apple Universal Clipboard, а выпадающие меню теперь выглядят ближе к нативному стилю системы.

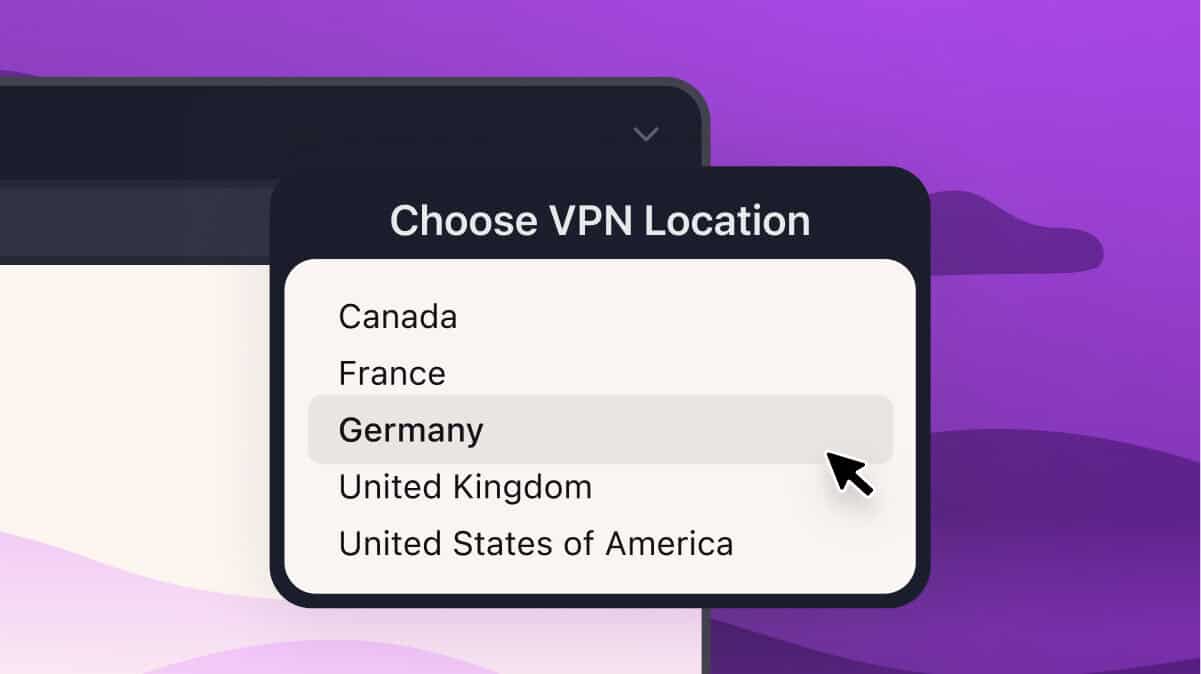

Кроме того, встроенный VPN Firefox получает ручной выбор локации: пользователи смогут выбирать конкретные страны, а не полностью полагаться на автоматическую маршрутизацию. Функция будет внедряться постепенно.

Из менее громкого, но важного: исправлены проблемы с несколькими мониторами, улучшено управление цветом изображений на macOS, увеличена строка поиска в настройках и изменено поведение разрешений геолокации в Windows.