В Сети появилась информация о том, что Минцифры якобы прорабатывает меры по контролю зарубежного интернет-трафика и использованию VPN. Обсуждается несколько идей. Среди них — мониторинг переходов пользователей на зарубежные сайты и ресурсы, доступ к которым ограничен в России, а также дальнейшее давление на VPN-сервисы.

Об этом сообщает Mash со ссылкой на документ ведомства.

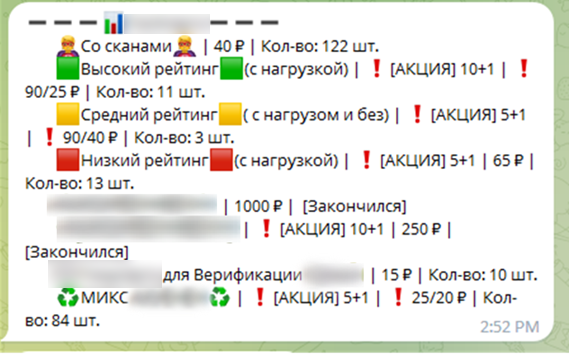

В публикации упоминается возможность введения платного доступа к такому трафику. Речь якобы идёт о сценарии, при котором за использование обходных инструментов и просмотр заблокированных ресурсов может взиматься дополнительная плата.

При этом уточняется, что подобные меры могут коснуться в первую очередь мобильного интернета. О проводном доступе, по данным Mash, пока речи не идёт.

Конкретные параметры возможных изменений, включая тарифы, не называются. В публикации подчёркивается, что проект находится на стадии проработки и окончательных решений по нему пока нет.

Официальных комментариев Минцифры по этому поводу на момент публикации не было, поэтому детали инициативы и её реальные перспективы пока остаются неясными.