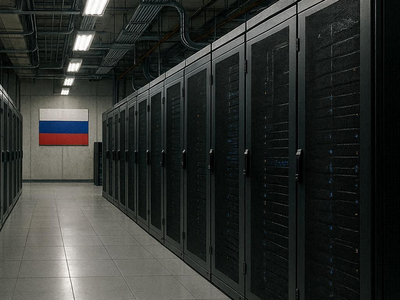

Дорожная карта развития отрасли ЦОД, разработанная Аналитическим центром при правительстве, предусматривает серьёзное упрощение согласований при прокладке коммуникаций для строительства новых объектов. Это может сократить сроки строительства до 40%, а также снизить юридические риски.

Документ оказался в распоряжении «Известий». Как говорится в дорожной карте, действующий порядок строительства центра обработки данных (ЦОД) требует получать согласие всех владельцев земельных участков и объектов инфраструктуры, через которые должны пройти коммуникации.

Отказ или уклонение от ответа даже одного из собственников может заблокировать весь проект. В результате операторы вынуждены вступать в затяжные судебные споры об установлении сервитута, перепроектировать трассы с существенным удлинением маршрута или выплачивать необоснованно завышенные компенсации, говорится в документе.

Разработчики дорожной карты предлагают внести поправки в Гражданский кодекс, которые позволят не согласовывать прокладку коммуникаций подземным способом. Прежний порядок будет действовать только в случаях, когда требуются земляные работы на поверхности, например прокладка траншей. По оценке авторов инициативы, такая мера позволит сократить временные затраты на 30–40%.

Как отметил эксперт НТИ по перспективным и новым источникам энергии Дмитрий Высокогорский, получение согласований от всех собственников занимает минимум шесть месяцев, но нередко растягивается до полутора или даже двух лет. По его словам, многие владельцы объектов используют ситуацию для давления и получения компенсаций.

«Мы всё чаще сталкиваемся с ограничениями городской инфраструктуры — перегруженностью существующих коллекторов, особенно при прокладке электрических линий, а также длительными согласованиями новых ГНБ-переходов. В этих условиях упрощение процедур может существенно ускорить ввод новых мощностей», — отметил директор по развитию и эксплуатации дата-центров РТК-ЦОД Константин Степанов.

В пресс-службе ВТБ рассказали, что чаще всего сложности возникают при прокладке каналов связи:

«Банкам, как правило, нужны каналы с резервированием, которые должны подходить к зданию с разных сторон, но возможность организации таких каналов есть не всегда из-за наличия соседей. При этом проблема может быть не только в нежелании собственников дать разрешение на прокладку кабеля, но и в том, чтобы просто найти всех собственников для получения разрешения. Наличие официального механизма для разрешения таких ситуаций точно облегчит жизнь банкам».

Генеральный директор оператора ЕСК Алхас Мирзабеков предложил использовать опыт США и Китая и создавать «инфраструктурные коридоры». Для них могут действовать ускоренная выдача разрешений, механизмы цивилизованного изъятия или использования земель, а также карты подземных коммуникаций. Действующий порядок, по его мнению, замедляет строительство новых объектов и ведёт к технологическому отставанию.

По мнению Дмитрия Высокогорского, для решения этих задач потребуется серьёзная корректировка законодательства. В частности, необходимо закрепить упрощённый режим публичного сервитута для объектов цифровой инфраструктуры, установить чёткие сроки и порядок уведомления собственников при подземной прокладке коммуникаций, а также ввести обязательную досудебную медиацию при возникновении споров.

Кроме того, предлагается создать единый реестр трасс инфраструктуры ЦОД и установить формулу расчёта компенсации собственникам, которая исключит возможность спекулятивного завышения. Например, её можно привязать к кадастровой стоимости участка и глубине залегания коммуникации. При этом важно сохранить базовые гарантии для собственников: право на информирование, разумную компенсацию и судебную защиту в случае реального ущерба.