Пока одни строят замки и добывают алмазы в Minecraft, другие подсовывают игрокам вредоносные моды. Исследователи из McAfee сообщили о масштабной кампании WeedHack, жертвами которой с начала года стали более 116 тысяч устройств по всему миру.

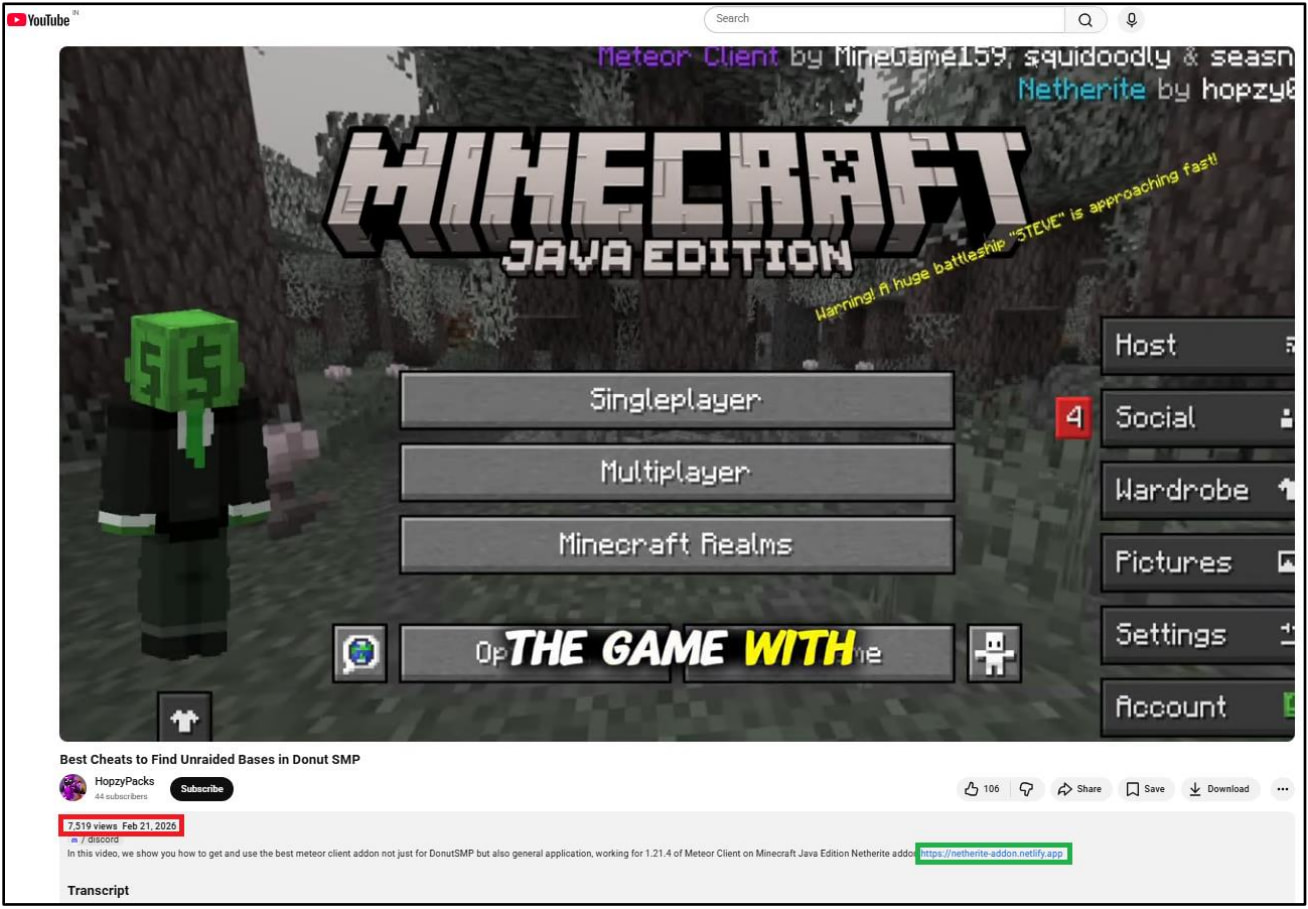

Распространяется зловред через всё, что так любят поклонники Minecraft: моды, читы, клиентские сборки и различные игровые утилиты. Для привлечения жертв злоумышленники активно используют YouTube и SEO-трюки.

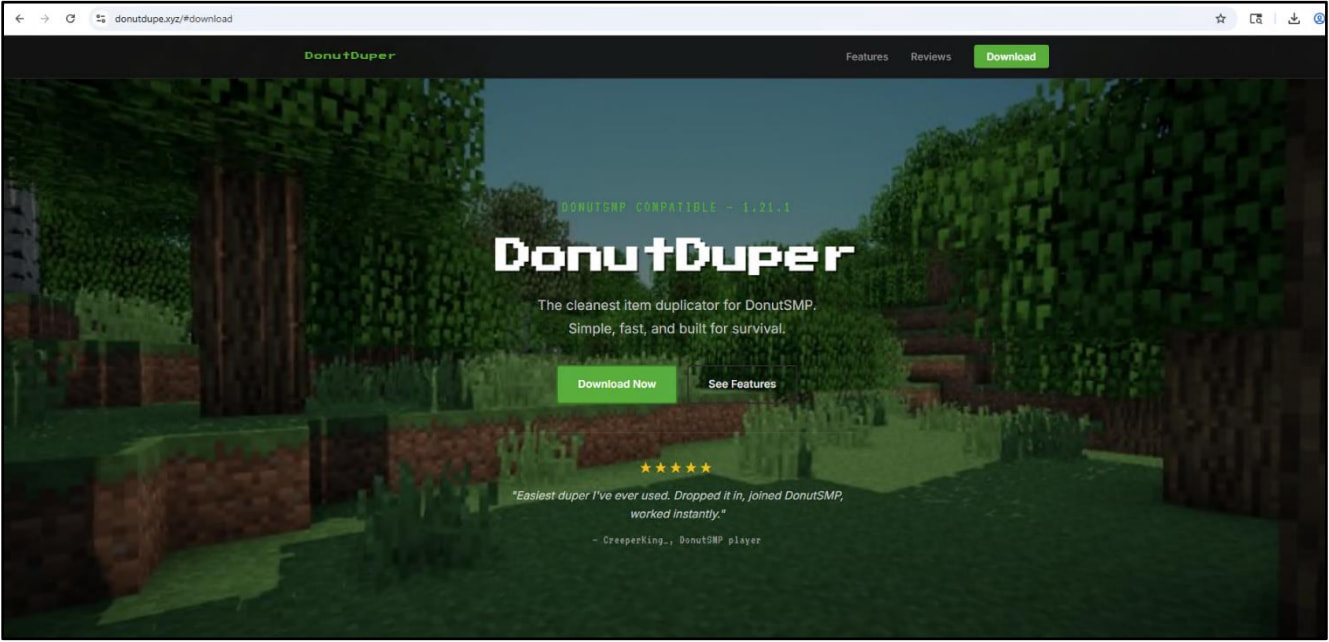

Схема проста. Пользователь ищет новый клиент или мод для Minecraft, находит красивое видео с инструкцией или сайт на первых позициях поиска, скачивает JAR-файл и вместе с ним получает инфостилер.

По данным McAfee, злоумышленники создали более 240 вредоносных ссылок и распространили свыше 3800 уникальных заражённых JAR-файлов. Некоторые ролики на YouTube с рекламой таких модов уже набрали тысячи просмотров.

Сам WeedHack работает по модели «вредонос как услуга». Более того, его базовая версия распространяется бесплатно — довольно редкий случай для подобных проектов. После регистрации злоумышленники получают доступ к панели управления с информацией о заражённых компьютерах и украденных данных.

В бесплатной версии зловред ворует игровые сессии Minecraft, сохранённые пароли, cookies из браузеров, данные криптокошельков, а также учётные записи Discord, Steam и Telegram. Дополнительно он умеет делать скриншоты заражённой системы.

За небольшую доплату возможности становятся ещё интереснее. Премиум-версия за 5 долларов в месяц или 24,99 доллара добавляет удалённое управление компьютером, кейлоггер, доступ к веб-камере, удалённую консоль и управление файлами.

По словам исследователей, большинство клиентов WeedHack — подростки и молодые пользователи, которые используют инструменты удалённого доступа для слежки и издевательств над своими жертвами.