Анкит Анубхав, ведущий исследователь компании NewSky Security, рассказал о методах эксплуатации уязвимости в знаменитом ботнете Mirai. Эта дыра позволяет обрушить C2-серверы.

По словам Анубхава, брешь актуальна для большинства вариантов Mirai. Заключается она в том, что командные серверы выходят из строя в случае, если к ним подключаются с именем пользователя, содержащим более 1025 букв «a».

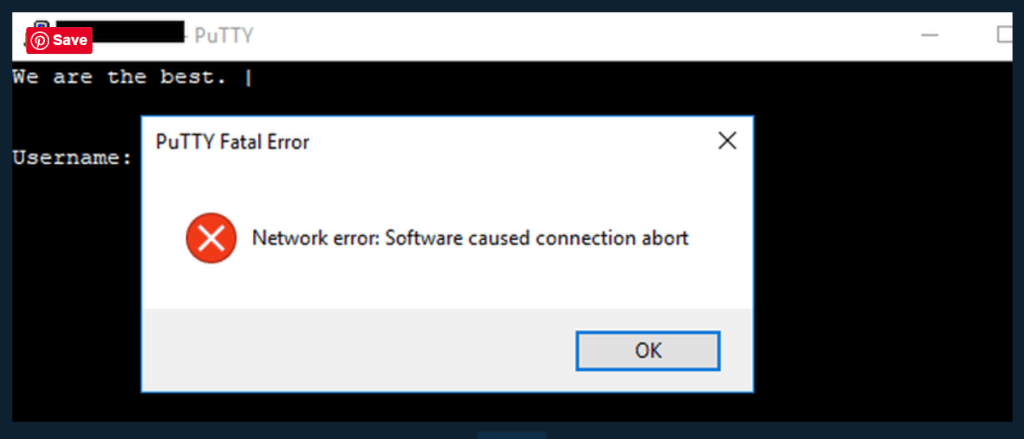

В результате утилита PuTTY выдаст следующую ошибку:

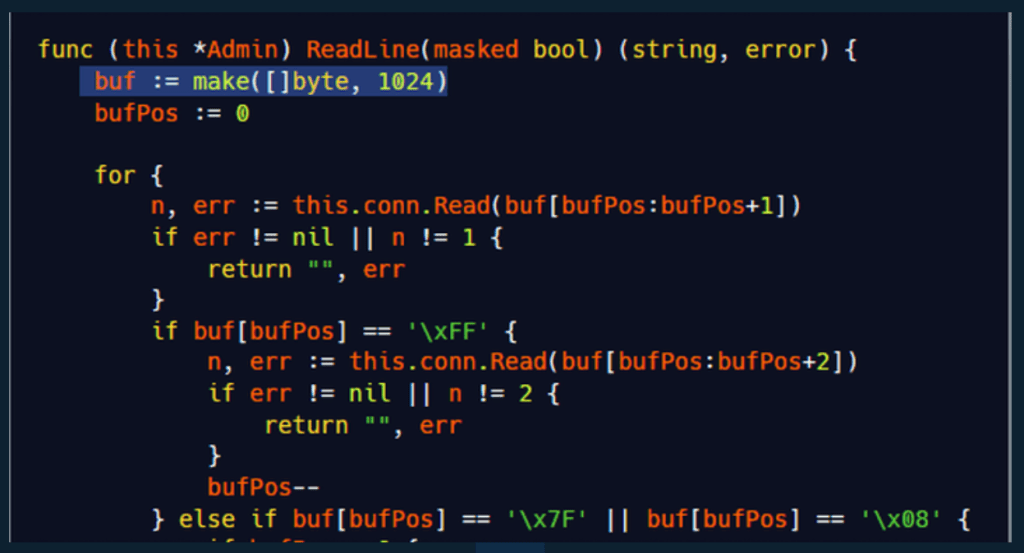

Уязвимость удалось обнаружить благодаря наличию на Github исходного кода Mirai. Эксперты обратили внимание на тот факт, что имя пользователя передается кастомной функции Readline.

Эта функция фиксирует размер буфера на длине в 1024 символов. То есть все, что будет больше 1024, выведет из строя соответствующие модули.

«Поскольку большинство IoT-ботнетов в 2019 году основаны именно на Mirai, эта уязвимость актуальна для многих вариантов бот-сетей. Более того, она уже в полной мере используется сведущими специалистами», — объясняет Анубхав.