Следующая версия популярной мобильной операционной системы с кодовым названием Android Q сделает упор на защиту конфиденциальности пользователей. На данный момент еще даже не объявили официальное имя новой версии ОС, но уже можно рассмотреть грядущие защитные функции.

О нововведениях можно судить на основе первого предварительного билда и информации, предоставленной самой Google.

Прежде всего, в новой версии Android приложениям будет запрещено получать информацию о частоте взаимодействия пользователя с определенными контактами. Напомним, что такие данные разработчики любят собирать в целях более эффективного продвижения своих сервисов.

Помимо этого, Android Q будет передавать рандомизированные MAC-адреса по умолчанию. Это защитит юзеров от попыток отследить их перемещение, которые предпринимают разработчики приложений, аналитические компании и онлайн-магазины.

Только некоторые приложения смогут получить доступ к IMEI и серийному номеру устройства.

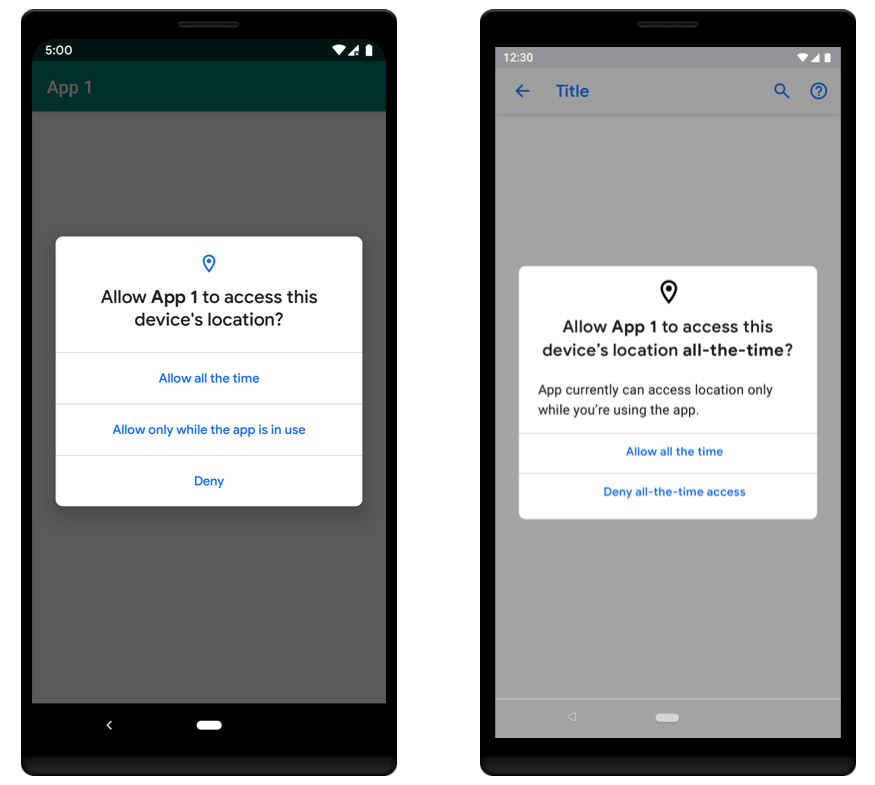

Также пользователи получат больше контроля по части управления настройками геолокации.

«Ранее у пользователя, по сути, была лишь одна настройка — разрешить или запретить определенному приложению доступ к геоданным. Начиная с версии Android Q, у пользователей появится новая опция, которая позволит разрешить приложениям доступ к геоданным только при их непосредственном использовании», — объясняет Google.

Другими словами, эта функция повторит то, что реализовано на данный момент в iOS (никакого уничижительного сравнения здесь нет, только факты).

Доступ к буферу обмена получат только те приложения, которые находятся на экране, либо приложения с возможностью ввода — клавиатуры. В Android Q также планируют ограничить количество действий, которые могут инициировать приложения, находящиеся в фоне.