Эксперт ISC Дидье Стивенс обнаружил баг в Защитнике Windows, который приводит к тому, что механизм песочницы, недавно анонсированный Microsoft, не запускается. По словам Стивенса, если выключить компьютер, а не перезагрузить, то песочница не будет активирована.

Напомним, что согласно инструкции Microsoft, для активации песочницы в Защитнике Windows необходимо установить значение переменной системного окружения MP_FORCE_USE_SANDBOX на 1. После этого надо перезагрузить машину.

«Я столкнулся с интересным багом. После установки соответствующей переменной я выключил компьютер, а потом снова включил его. Однако это не активировало песочницу. Мне пришлось именно перезагрузить машину, чтобы изменения вступили в силу», — пишет Стивенс с блоге.

«То же самое случилось в момент, когда я пытался выключить песочницу. Сведения о проблеме я передал в Microsoft. Судя по всему, исправления стоит ожидать в ближайшее время».

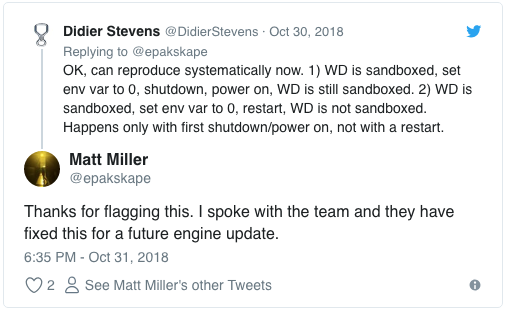

После того как исследователь сообщил о проблеме в Twitter, представители Microsoft вышли на связь, заявив, что исправление этого бага уже готово. Оно будет разослано в ближайшем обновлении антивирусного движка.

Таким образом, как пояснил Дидье, каждое изменение MP_FORCE_USE_SANDBOX требует именно перезагрузки для того, чтобы изменения вступили в силу.

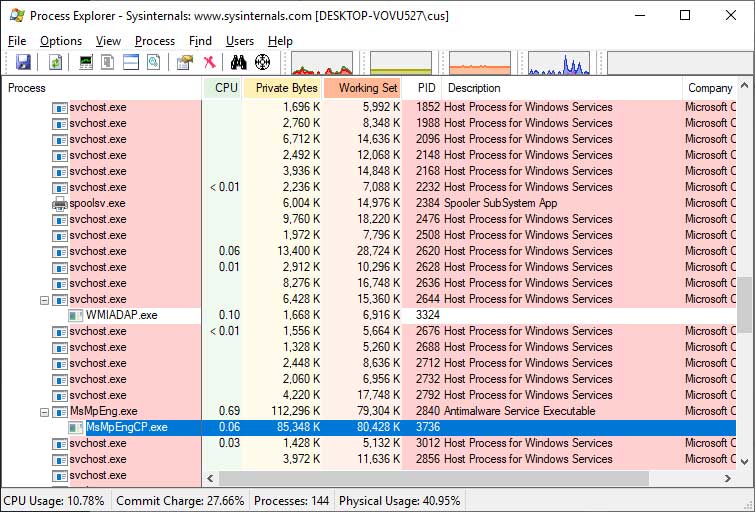

Если вы хотите убедиться, запущена ли песочница, можно воспользоваться программой Process Explorer. Найдите процесс MsMpEng.exe, у этого процесса должен быть подпроцесс с именем MsMpEng.exe:

На прошлой неделе мы писали, что встроенное антивирусное решение Защитник Windows стало первой программой такого класса, способной работать из песочницы. Идея такой реализации заключается в предотвращении утечек багов и эксплойтов из одного процесса в другой.