Патрик Уордл, знаменитый эксперт в области безопасности, раскрыл пользователям глаза на скрытые возможности популярного приложения для операционной системы macOS Adware Doctor. Оказалось, что предназначенный для блокировки рекламы софт попросту мог следить за пользователями.

Еще больше забавляет тот факт, что за приложение надо платить — разработчики хотят $4,99. Исходя из описания, Adware Doctor поможет пользователям удалить с компьютера все рекламные, и даже вредоносные программы.

Уордл пишет, что Adware Doctor может собирать полученную в системе информацию (вроде истории браузера и списка программ) в специальный ZIP-архив. После этого приложение отправляет все собранные данные на один из китайских серверов.

Все происходит в тихом режиме — пользователю не выводятся никакие запросы, его никак не оповещают. Исследователь считает, что доступ к таким данным приложение получает путем обмана пользователей.

Уордл утверждает, что связался с Apple еще месяц назад, корпорация пообещала изучить проблемное приложение, однако до сих пор нет никаких видимых изменений — Adware Doctor все так же доступен в официальном магазине приложений. Именно поэтому специалист опубликовал информацию о нем.

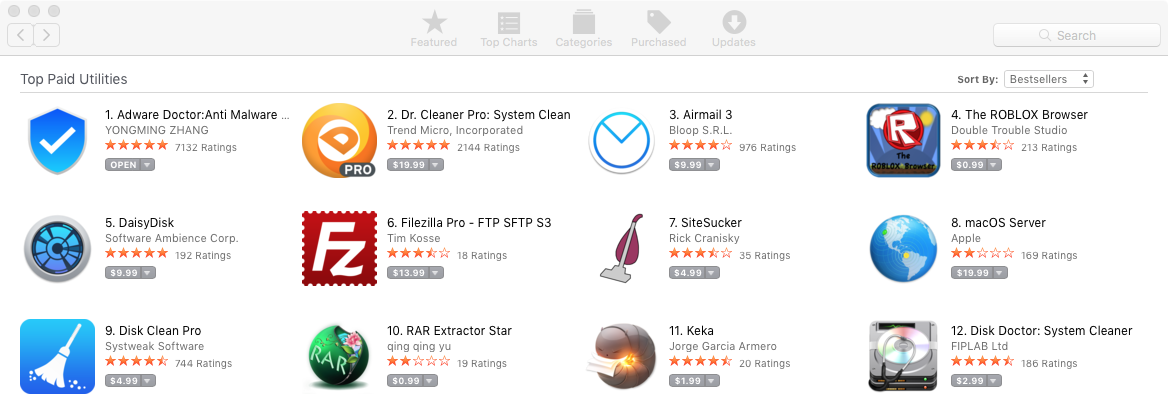

Удивительно, что в разделе платных приложений Adware Doctor занимает первое место среди самых доходных программ.