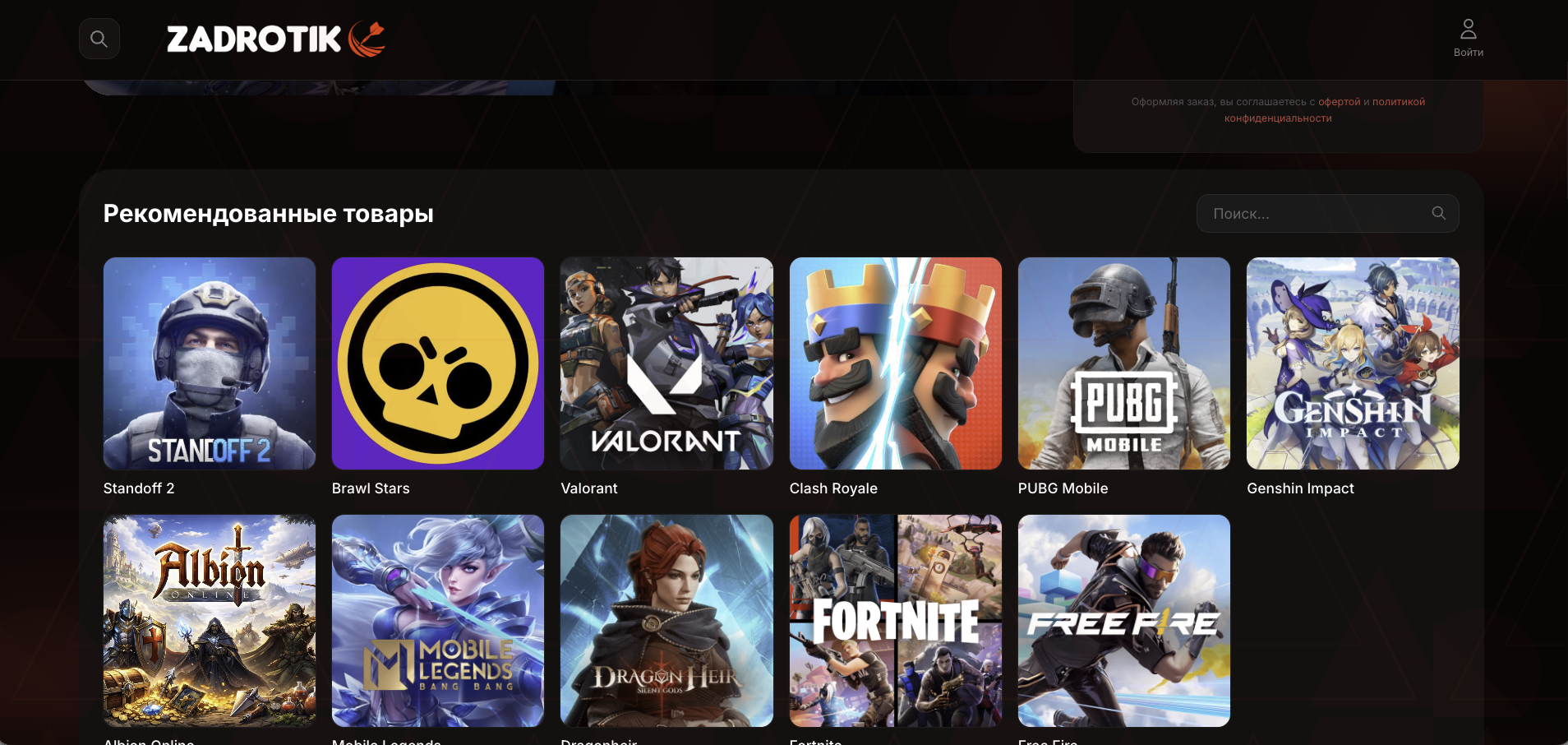

Компания F6 предупредила о мошенническом маркетплейсе Zadrotik, ориентированном на российских пользователей. Площадка специализируется на продаже игрового инвентаря и виртуальных товаров для популярных игр, а также подписок на различные онлайн-сервисы. Ресурс продолжает работать, и, по данным компании, уже есть пострадавшие.

Как сообщили в F6, на сайте пользователям предлагают приобрести якобы лицензионные ключи, внутриигровые предметы и игровую валюту для Genshin Impact, CS2, Standoff 2, Fortnite и PUBG Mobile.

Помимо игрового контента, на маркетплейсе доступны подписки на ChatGPT, Spotify, iTunes и ряд других популярных сервисов. Стоимость товаров варьируется от 1 до 500 тыс. рублей. Сайт размещён в доменной зоне .COM и на момент публикации продолжает открываться.

Ресурс активно рекламируется на различных площадках, включая социальные сети, видеохостинги, тематические форумы и игровые каналы. При этом, как отмечают в F6, мошеннический характер сайта с первого взгляда практически не заметен, несмотря на отсутствие какого-либо сходства с легальными сервисами. «Например, в оформлении магазина почти нет характерных для мошеннических сайтов орфографических ошибок. Структура сайта включает разделы “Условия использования” и “Оферта”, в которых описаны особенности взаимодействия с пользователями», — пояснили в компании.

По словам экспертов, схема работы ресурса строится на предложении промокода на первую покупку с ограниченным сроком действия. Перед оплатой пользователю предлагают указать адрес электронной почты для получения цифрового товара, а также выбрать способ оплаты — банковской картой, через QR-код или криптовалютой.

Однако, как подчёркивают в F6, вне зависимости от выбранного способа оплаты данные платёжных средств оказываются скомпрометированы, а покупатель теряет деньги, не получив обещанный товар. При обращении в техническую поддержку «сотрудники» сервиса ссылаются на техническую ошибку и предлагают повторить платёж. По оценкам компании, средний чек пострадавших пользователей составил 2 397 рублей.