Специалисты по безопасности после нескольких попыток сумели взломать холодильник Samsung и выманить у него учетные данные от аккаунта Gmail. Холодильник модели RF28HMELBSR сильно сопротивлялся, но шансов у него было мало, ведь компания-производитель не позаботилась о правильной проверке сертификата SSL при установке защищенного соединения с сервером Google.

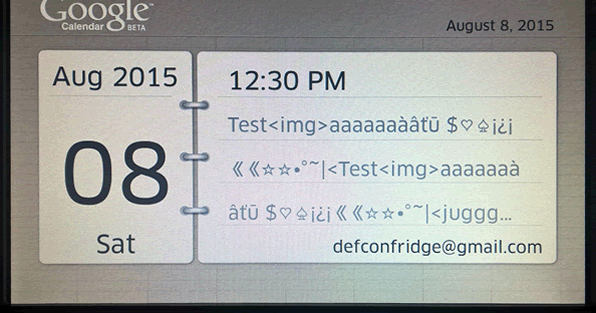

Взлом холодильника осуществлен хакерами из компании Pen Test Partners во время пентестерского конкурса на конференции Defcon. Подключенный к интернету холодильник авторизуется на сайте Google Calendar, чтобы показывать хозяину информацию о текущих делах на встроенном экране.

Бытовой прибор работает точно так же, как любое другое устройство с установленной программой для Google Calendar.

Хотя в холодильнике реализована поддержка SSL, но проверка сертификата де-факто не осуществляется, что делает возможным проведение атаки MiTM. Устройство подключается к сети по Wi-Fi, так что теоретически провести атаку можно из-за пределов квартиры, от соседей или с улицы, передает xakep.ru.

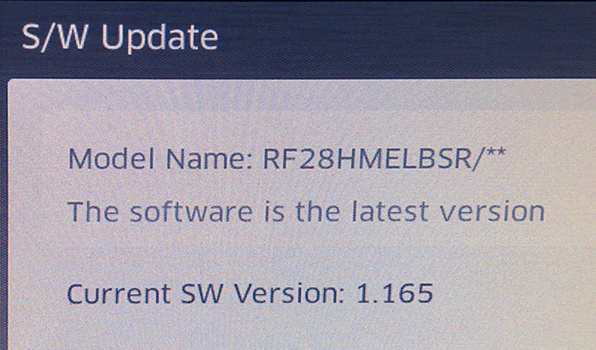

Просканировав порты, хакеры нашли два сервиса на портах 4444 (SSL) и 8888. Первый из них используется встроенным мобильным приложением, которое извлекает сертификат из локального хранилища. Правда, им так и не удалось подобрать пароль для него. Также безуспешной оказалась попытка заменить прошивку холодильника через поддельное обновление.

Тем не менее, MiTM-атака признана успешной, поскольку холодильник все-таки выдал учётные данные от аккаунта Google.