«Лаборатория Касперского» представила новое кроссплатформенное решение для обеспечения безопасности детей в Интернете – Kaspersky Safe Kids. Новый продукт доступен в виде бесплатного приложения с набором дополнительных платных опций и призван помочь родителям лучше понять виртуальную жизнь своих детей и охватить их заботой не только в реальном, но и в цифровом мире.

Помимо регулирования времени, проведенного в Сети, и ограничения приложений и сайтов, которыми пользуется ребенок, Kaspersky Safe Kids позволяет взрослым понять, с кем их дети общаются в соцсетях и по телефону и где в текущий момент находятся.

Как показывают регулярные опросы*, в России около половины родителей (45%) уверены, что их дети сегодня гораздо больше узнают о жизни из Интернета, нежели из своего опыта в физической реальности. При этом 22% из них признались, что не могут контролировать то, что ребенок видит или делает в Сети. А 40% родителей переживают из-за растущего числа интернет-угроз, с которыми могут столкнуться их дети.

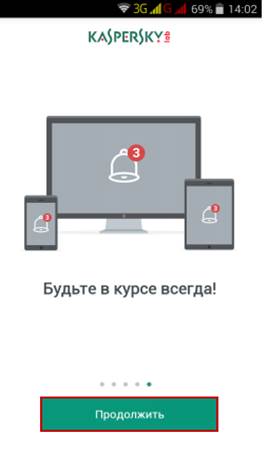

Kaspersky Safe Kids совместим со всеми популярными операционными системами: Windows, Mac, Android и iOS – и, таким образом, дает возможность обеспечить всестороннюю защиту ребенка вне зависимости от того, каким набором устройств он пользуется. В отличие от доступных ранее решений, функции Kaspersky Safe Kids не ограничиваются лишь контролем времени, контента и действий юного пользователя в Сети.

При помощи нового продукта родители могут отслеживать звонки и SMS (без отображения самого текста сообщения и содержания звонков), которые поступают на смартфон их ребенка. При этом если они хотят контролировать общение своего чада с неблагонадежными друзьями, то они могут отметить в настройках их контакты – и в случае, если кто-либо из них будет пытаться связаться с ребенком, родителям будет приходить уведомление.

Также Kaspersky Safe Kids содержит специальную функцию контроля расположения, которая позволяет родителям узнавать, где находится их ребенок в настоящий момент. Кроме того, с ее помощью они могут устанавливать геолокационный периметр, в котором, как ожидается, ребенок будет находиться в определенный период времени, – и если он его покинет, родителям придет уведомление.

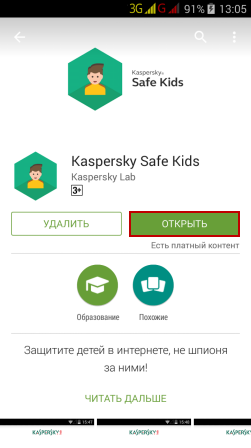

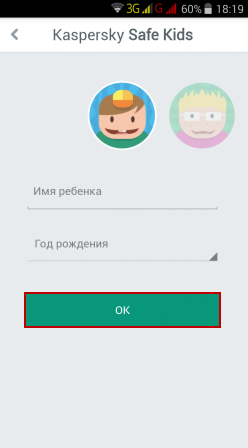

Для того чтобы начать пользоваться решением, достаточно зарегистрироваться на портале My Kaspersky, создать профиль ребенка и скачать приложение для нужной платформы. Управление защитным продуктом, включая настройку индивидуальных правил, также осуществляется на этом портале. И здесь же родителям будет видеть всю статистику о цифровой активности ребенка.

«Мы рады дать пользователям инструмент, который поможет предотвратить неприятные последствия использования ребенком цифровых устройств и Интернета, причем даже в том случае, если он более сведущ в технологиях, чем родители. Kaspersky Safe Kids, созданный с учетом особенностей поведения юных пользователей, позволяет им безопасно открывать для себя кибермир и расширяет границы родительской заботы. Подобные решения дают родителям возможность своевременно защитить своего ребенка без ограничения его свободы, они помогают поддерживать детско-родительский диалог», – поясняет Александр Ерофеев, директор по маркетингу «Лаборатории Касперского».

Полученная с помощью Kaspersky Safe Kids информация дает родителям возможность общаться с ребенком более предметно, исправлять возможные ошибки или вовремя вступаться, чтобы помочь и защитить. Эксперты «Лаборатории Касперского» уверены, что защита ребенка в Сети требует системного подхода, и, помимо использования технологических решений, родителям стоит обучать своих детей правилам цифровой безопасности и, конечно же, обсуждать с ними все приятные и неприятные случаи, произошедшие в Сети.