Вирусы-вымогатели, которые шифруют файлы пользователей, требуя денег за расшифровку, терроризируют Интернет уже не первый год. Однако в нынешнем октябре они разбушевались не на шутку – очевидно, совершив новый эволюционный скачок в области автоматизации.

В начале месяца массовому заражению криптолокером подверглись сотрудники крупнейшей австралийской вещательной компании ABC, а и также почтовые и другие государственные службы страны. В середине месяца более 100 тыс. американцев были заражены вирусом-шифровальщиком через рекламные баннеры, крутившиеся в роликах на YouTube.

Ну а в последние дни октября случилась активизация опасного шифровальщика в российском сегменте Интернета. Пользователи получают по почте вредоносный файл, который представляет собой обфусцированный JavaScript размером 2.5 кб (MD5 ea834605f6bee2d4680aae0936655a30). При запуске троян загружает из Интернета и запускает дополнительные компоненты.

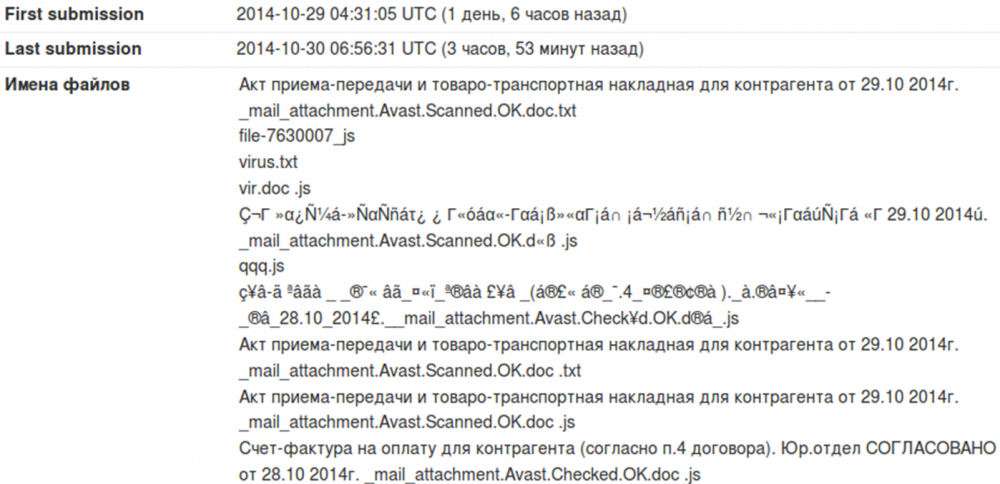

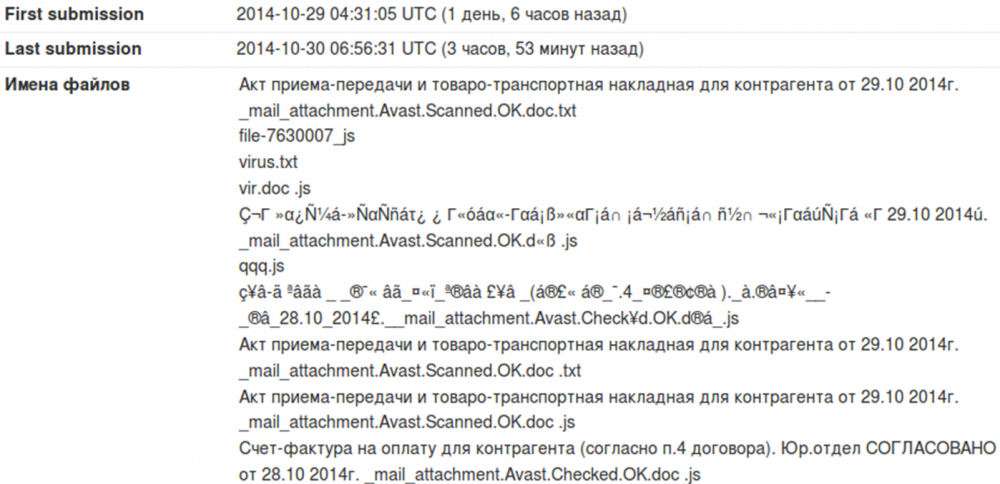

Описание вируса присутствует на Virustotal, там же в комментариях приводится и деобфусцированная версия скрипта. Можно заметить, что файл неоднократно загружался на ресурс 29 и 30 октября 2014 г.

А вот как выглядят имена зараженных файлов, приходящих в почте – в основном они изображают деловые документы, причём якобы проверенные антивирусом (Avast.Scanned.OK)

После того, как пользователь откроет приложенный файл и запустит вредоносный скрипт, его информируют о том, что его документы, фото, базы данных, а также другие важные файлы «были зашифрованы с использованием криптостойкого алгоритма RSA-1024».

Далее пользователю предлагается подробная инструкция по спасению своих цифровых активов, которая сводится к следующему набору действий:

1. Ваши файлы зашифрованы. Отправьте нам письмо с KEY и UNIQUE в течение суток.

2. Нашли KEY.PRIVATE и UNIQUE.KEY на своем ПК, взяли пару зашифрованных файлов - отправили на почту paycrypt@gmail.com

3. Через некоторое время получаете ответ с гарантиями, инструкцией и стоимостью. Посетите наш Twitter. Посмотрите, что все получают ключи.

4. После оплаты получаете ключ дешифрования, ПО и инструкцию по дешифрованию.

Наиболее интересным в этой инструкции является пункт 3, в котором указан Twitter-аккаунт, публично разглашающий информацию об адресах электронной почты жертв атак (http://twitter.com/keybtc). Это не только позволяет продолжать монетизацию (например, с помощью рассылки спама на адреса жертв, часть из которых указывало служебные адреса электронной почты), но может и нанести существенный вред репутации пострадавших.

В частности, некоторые исследователи уже занялись анализом списка жертв – среди них оказалось много IT-компаний, включая и такие, которые сами занимаются информационной безопасностью.

Как и в большинстве атак по электронной почте, в данном случае использовались версии вредоносного ПО, которое в момент атаки не детектировалось большинством антивирусов. В связи с этим эксперты Positive Technologies советуют не открывать письма с непонятными вложениями - даже от знакомых адресатов. А на инфраструктурном уровне, в дополнение к антивирусным решениям, рекомендуется применять специализированные песочницы для проверки входящей почты, а также ограничить получение почтовых вложений, содержащих исполняемый код, в том числе в архивах.