Разработчики моделей искусственного интеллекта (ИИ) Claude, ChatGPT и Gemini активно выявляют пользователей из неподдерживаемых регионов, включая Россию, и блокируют им доступ. При этом чем крупнее проект, тем выше риск столкнуться с ограничениями.

Недавно стало известно о масштабной блокировке российских пользователей компанией Anthropic, которой принадлежит ИИ-модель Claude. По данным СМИ, она затронула сотни людей и компаний. При этом удалялись все данные и аналитика, хотя деньги за подписки возвращались.

Как отметил директор по экспериментальным продуктам MWS AI, входящей в МТС Web Services, Сергей Пономаренко в беседе с РИА Новости, зарубежные разработчики продолжат применять такую практику в отношении россиян. По его оценке, под наиболее серьёзной угрозой находятся крупные проекты, по которым есть признаки корпоративного использования. Это связано с соблюдением санкционных ограничений, введённых властями США ещё в 2024 году.

«Американские компании-разработчики ИИ Anthropic, OpenAI и Google активно применяют инструменты выявления пользователей из неподдерживаемого региона и будут дальше совершенствовать их, поэтому россиян ждут новые волны блокировок в Claude, ChatGPT и Gemini», — предупредил Сергей Пономаренко.

По его словам, ограничения вводятся постепенно. Российские IP-адреса долгое время могли помечаться в базах, которыми пользуются зарубежные компании, как европейские, однако со временем такие данные уточняются. В результате сетевые адреса начинают определяться как российские, после чего к ним применяются ограничения.

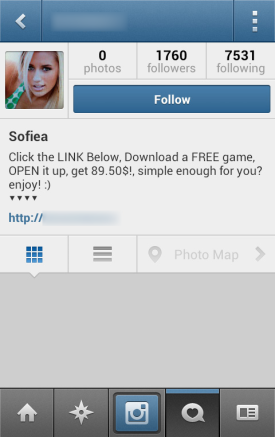

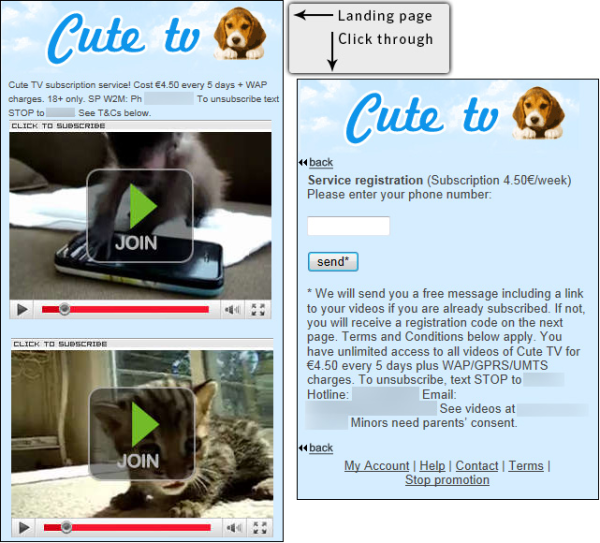

Использование прокси и VPN зарубежные компании также могут отслеживать. «Подозрение могут вызвать постоянные входы из разных стран за короткое время, использование известных VPN или прокси, слишком большое количество запросов, массовое создание аккаунтов, а также попытки обойти блокировки или фильтры безопасности», — пояснил эксперт.

Часто сомнительные учётные записи сначала отправляют на проверку и не блокируют полностью. Доступ к ним могут восстановить после обращения в техническую поддержку. Однако при удалении аккаунта уничтожаются все данные. При этом сами диалоги владельцы ИИ-моделей могут сохранять, что создаёт дополнительные риски утечки информации.