Security Vision сообщила о выходе обновлённой версии продукта Security Vision КИИ. Решение предназначено для автоматизации процессов, связанных с выполнением требований законодательства по защите критической информационной инфраструктуры.

Одно из ключевых изменений касается процесса категорирования объектов КИИ.

В систему добавлены типовые отраслевые перечни объектов, а также обновлены критерии значимости с учётом изменений в постановлении Правительства РФ № 127 (в редакции от 7 ноября 2025 года). Приведена в актуальный вид и форма сведений о результатах категорирования.

Отдельное внимание уделено расчёту экономической значимости. Теперь он автоматизирован в соответствии с рекомендациями ФСТЭК России. В расчёт включаются такие показатели, как ущерб субъекту КИИ, ущерб бюджету РФ и возможное прекращение финансовых операций.

Система не только определяет значение критерия для присвоения категории значимости, но и формирует экономические показатели, которые автоматически попадают в раздел обоснования.

Также реализована автоматическая оценка состояния технической защиты — на основе методики ФСТЭК от 11 ноября 2025 года. Продукт рассчитывает показатели по отдельным группам и определяет итоговый уровень защищённости объекта.

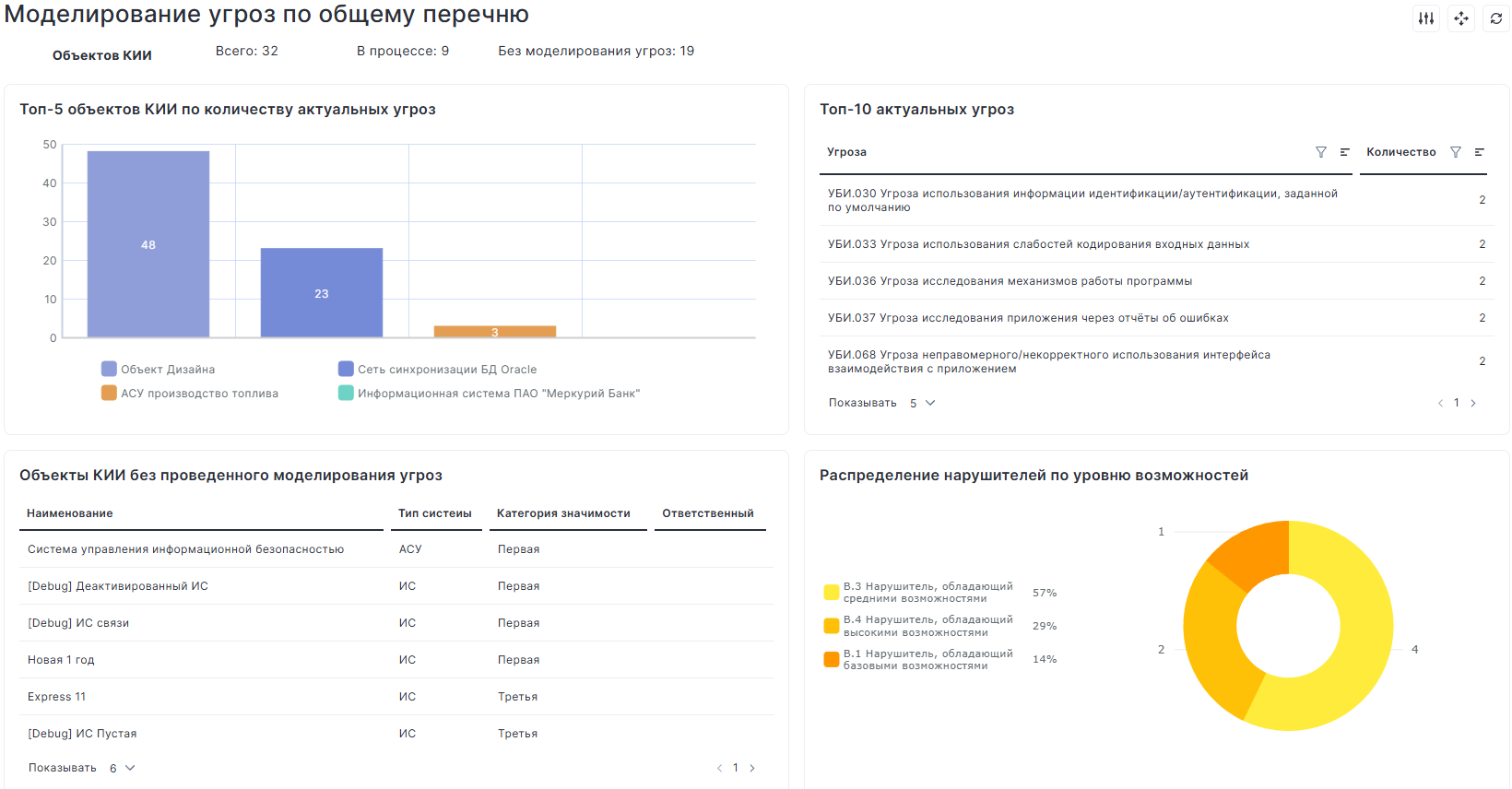

Расширен функционал моделирования угроз. Помимо прежнего подхода, теперь доступна оценка по общему перечню угроз из банка данных ФСТЭК с применением актуальной методики оценки угроз безопасности информации. В процессе моделирования система автоматически выстраивает возможные сценарии реализации угроз — с учётом тактик и техник — и определяет способы их реализации. Пользователь может выбрать подходящую методику моделирования.

В части отчётности добавлены отчёты по угрозам, нейтрализованным мерами защиты, а также перечень угроз, признанных неактуальными, с указанием причин. Для моделирования по общему перечню предусмотрен отдельный дашборд.

Обновлённая версия ориентирована на упрощение процедур категорирования, расчётов и подготовки отчётности для организаций, подпадающих под требования законодательства о КИИ.