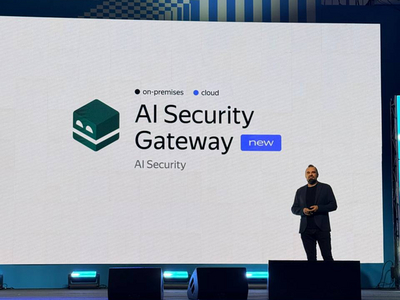

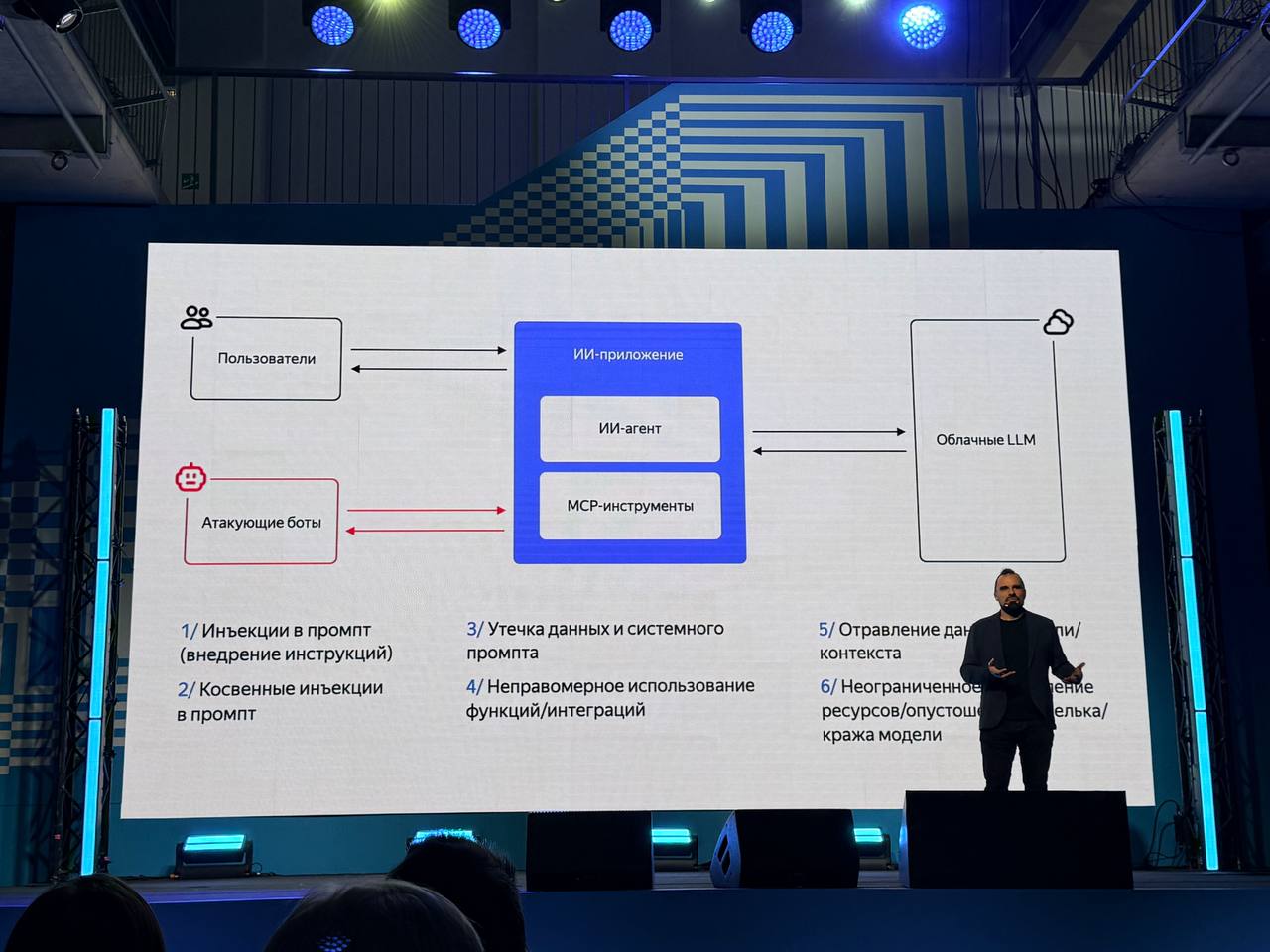

Yandex B2B Tech вместе с SolidLab представила новый продукт для защиты ИИ-приложений — SolidWall AI Security Gateway. Решение должно помочь компаниям защитить цифровые сервисы на базе искусственного интеллекта от киберугроз, атак и утечек данных. Новый продукт работает как своего рода защитный шлюз между внешней сетью и ИИ-приложением.

Он отслеживает, какие данные отправляются в ИИ-систему, и помогает безопаснее использовать такие решения в бизнес-процессах.

В компании отмечают, что SolidWall AI Security Gateway рассчитан на защиту от распространённых угроз для ИИ по классификации OWASP, а также от массовых DDoS-атак, в том числе тех, где для обхода защитных механизмов применяются нейросети.

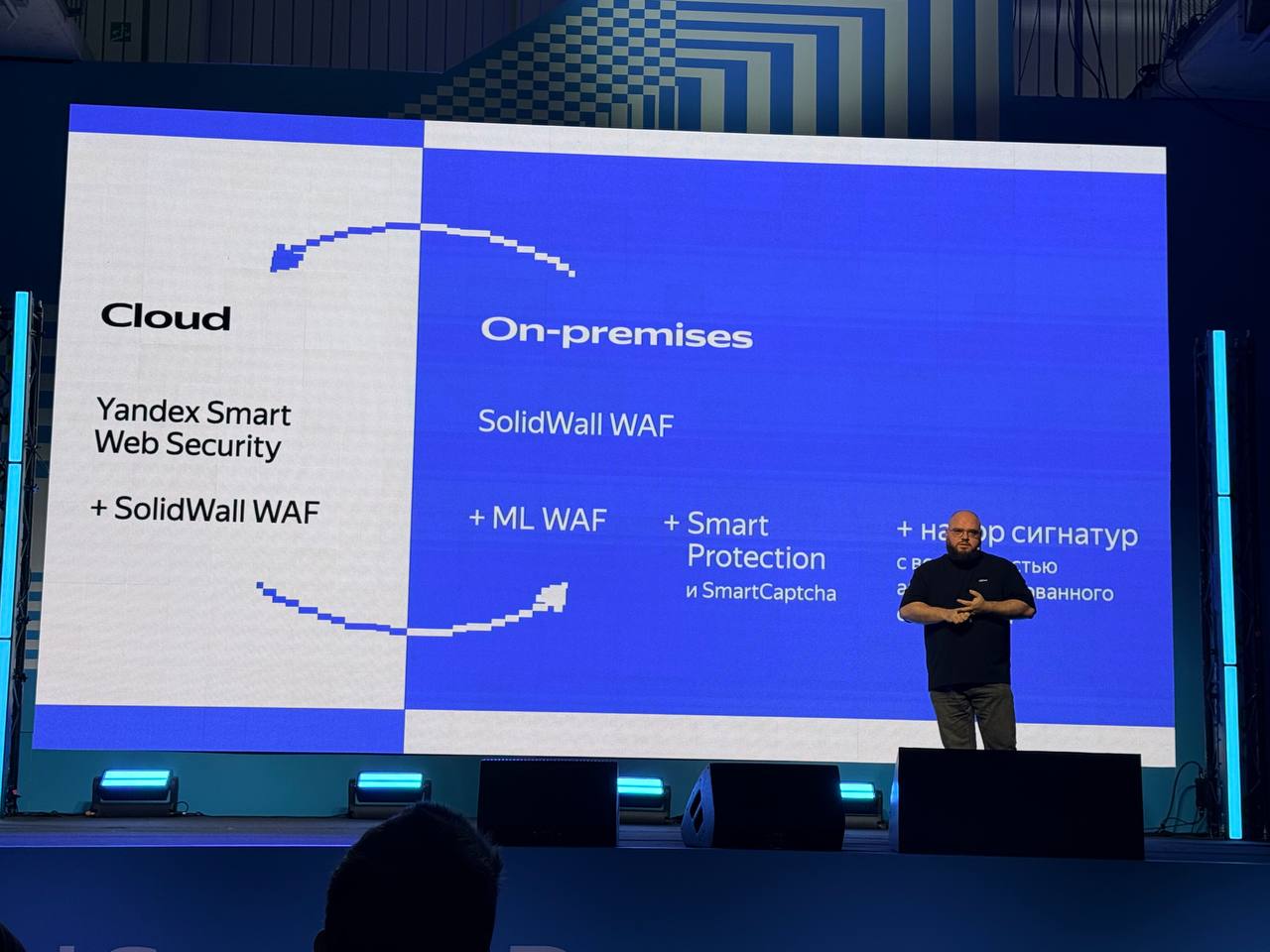

Решение создано на базе технологий Яндекса с учётом экспертизы SolidLab. Развернуть его можно как в инфраструктуре заказчика, так и по облачной модели.

Запуск выглядит вполне своевременным. По данным Gartner, в 2025 году 29% организаций столкнулись с атаками на инфраструктуру корпоративных ИИ-приложений, а ещё 32% — с атаками непосредственно на сами такие приложения. На этом фоне защита ИИ-сервисов постепенно превращается в отдельное направление информационной безопасности.

Как отметил директор по информационной безопасности Yandex Cloud Евгений Сидоров, SolidWall AI Security Gateway стал первым продуктом в рамках совместного предприятия с SolidLab. По его словам, в дальнейшем партнёры намерены выводить на рынок и другие ИБ-решения, делая подход к кибербезопасности более технологичным и гибким. Отдельный акцент компания делает именно на защите ИИ-систем: от консалтинга по безопасному применению ИИ до разработки практических инструментов защиты.

Одновременно Yandex B2B Tech обновила и другие продукты в своём ИБ-портфеле. Так, сервис Yandex Smart Web Security теперь получил защиту от DDoS-атак на уровнях L3 и L4 на базе собственной технологии Яндекса. Кроме того, в него встроили новый модуль SolidWall WAF, который сочетает негативную и позитивную модели защиты, анализирует поведение пользователей для выявления ботов и проводит инвентаризацию API.

Изменения затронули и сервис Security Deck. В нём появился модуль Vulnerability Management, предназначенный для управления уязвимостями на всех этапах жизненного цикла приложения — от разработки до эксплуатации. Модуль будет централизованно сканировать как приложения в хранилищах артефактов, так и уже работающие сервисы. Найденные угрозы автоматически сортируются по критичности, что должно упростить управление рисками в инфраструктуре.