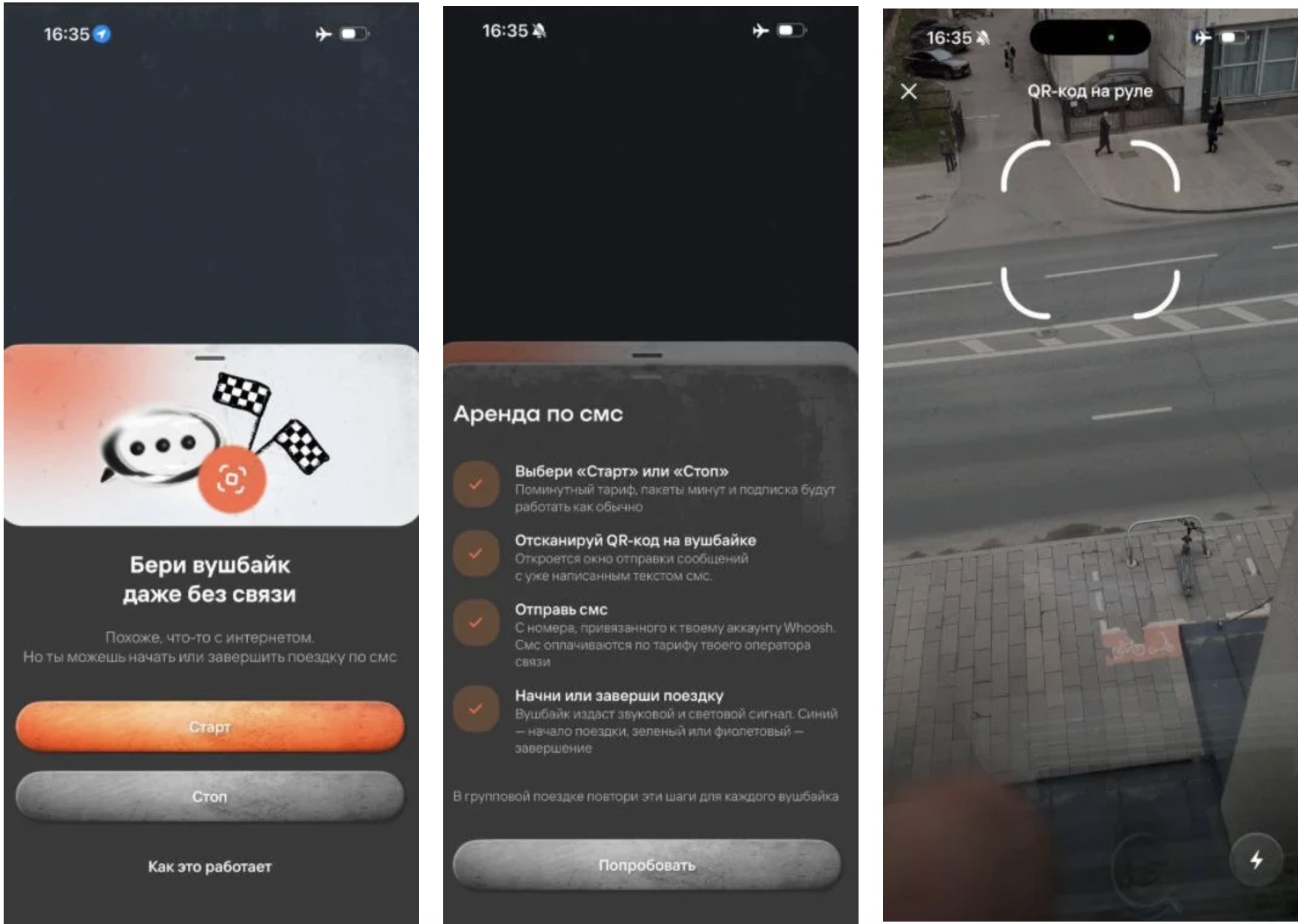

Сервис аренды электросамокатов Whoosh рассказал, в каких российских городах пользователи чаще всего сталкивались со сбоями мобильного интернета. Для этого компания посмотрела на статистику поездок, которые запускались через СМС, то есть без доступа к мобильной сети.

По данным Whoosh, с 30 марта по 19 апреля число таких поездок выросло в шесть раз по сравнению с первыми тремя неделями после запуска функции.

Больше всего СМС-стартов зафиксировали в Москве, Санкт-Петербурге и Краснодаре. В компании считают, что именно в этих городах пользователи чаще сталкивались с пропажей мобильного интернета.

Пики пришлись на 2 и 13 апреля. В эти дни количество СМС-поездок было в 2–2,2 раза выше среднего дневного уровня.

При этом в Whoosh называют проблему ограниченной. Большинство пользователей завершали поездки уже через приложение, когда связь снова появлялась. Это может говорить о том, что отключения были точечными и недолгими.