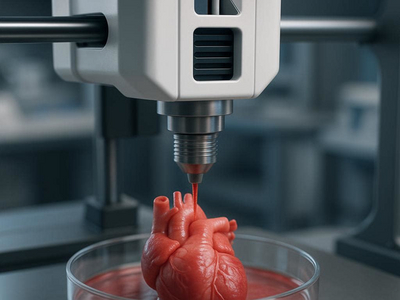

В России официально появился первый национальный стандарт, который регулирует сферу 3D-биопечати эквивалентов тканей и органов. ГОСТ уже утверждён приказом Росстандарта и вступит в силу с 1 сентября 2026 года. Для отрасли это история означает переход на более системный уровень.

Речь идёт о документе ГОСТ Р 72595–2026 «Трёхмерная биопечать эквивалентов тканей и органов. Базовые принципы. Термины и определения».

Его разработали учёные НИТУ МИСИС вместе с экспертами Ассоциации «Технологическая Платформа БиоТех2030» и лаборатории «3Д Биопринтинг Солюшенс».

Новый стандарт должен навести порядок в очень сложной и быстро растущей области. До сих пор 3D-биопечать в России в основном развивалась в рамках отдельных научных проектов и исследовательских команд. Теперь у этого направления появляется общая терминология, единые базовые принципы и нормативная основа, на которую можно опираться и в науке, и в прикладной работе.

А это важно не только для самих исследователей. Такие документы нужны, чтобы ускорять переход технологий из лаборатории в реальную практику — например, в регенеративную медицину, тестирование лекарств и разработку персонализированных решений для пациентов. Плюс стандартизация обычно помогает с воспроизводимостью результатов: когда все говорят на одном профессиональном языке, сравнивать разработки и двигаться дальше становится проще.

В МИСИС подчёркивают, что утверждение ГОСТа стало важным этапом для становления биопечати как полноценного направления в России. В университете напоминают, что именно там был создан 3D-биопринтер, с помощью которого в декабре 2023 года провели первую в мире операцию с биопечатью in situ, а в октябре 2025 года впервые применили разработанный исследователями метод биопечати хрящей.

Участники проекта говорят и о более широкой задаче: стандарты в таких сферах создают своего рода «инфраструктуру доверия». То есть помогают закрепить единые подходы, методы контроля качества и общие правила игры — а без этого ни масштабирование, ни серьёзное внедрение новых технологий обычно не работают.