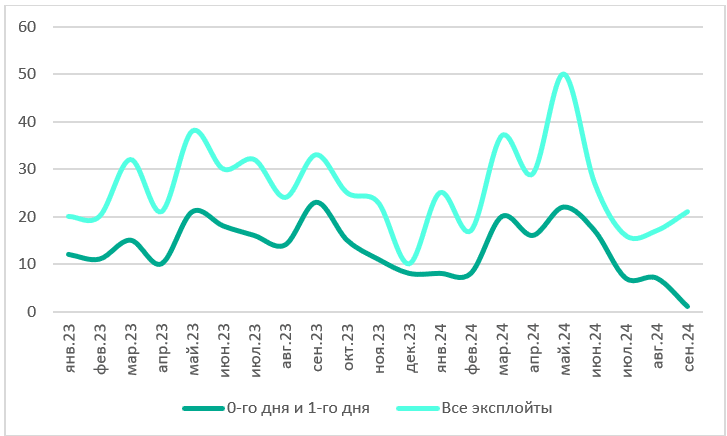

В период с января 2023 года по сентябрь 2024-го эксперты «Лаборатории Касперского» обнаружили в даркнете и теневых телеграм-каналах 547 объявлений о купле и продаже эксплойтов. Как оказалось, 51% из них нацелен на уязвимости нулевого и первого дня.

Последние фигурируют в иноязычных публикация как one-day и N-day, так как при наличии патча на его применение на местах обычно уходит более одного дня.

Наибольшим спросом пользуются эксплойты к уязвимостям RCE и LPE (локального повышения привилегий). За первые в среднем просят $100 тыс., за вторые — $60 тысяч.

«Пики активности на рынке эксплойтов непредсказуемы, и их сложно привязать к конкретным событиям, — отметила Анна Павловская, старший аналитик в команде Kaspersky Digital Footprint Intelligence. — Интересно, что в мае в даркнете был продан один из самых дорогих эксплойтов за анализируемый период, предположительно для уязвимости нулевого дня в Microsoft Outlook; цена составила почти два миллиона долларов США».

Дорогие покупки такого рода могут себе позволить только злоумышленники, не стесненные в ресурсах — такие как APT-группы, занимающиеся шпионажем в пользу какого-либо государства. В будущем году, по прогнозам Kaspersky, такие ОПГ расширят использование ИИ-технологий для автоматизации сбора информации о целях, создания вредоносных скриптов и управления резидентными зловредами.